昇腾AI处理器与CANN软件栈:引领AI计算新时代

腾AI处理器系列是华为自主研发的AI加速芯片,采用创新的达芬奇架构设计。这些处理器采用独特的3D Cube计算架构,通过片上存储和高效数据通路设计,相比传统GPU能效比提升2-3倍。实测表明,在ResNet50训练任务中,腾910相比同代GPU可减少30%训练时间。

昇腾AI处理器与CANN软件栈:引领AI计算新时代

腾AI处理器的技术突破

腾AI处理器系列是华为自主研发的AI加速芯片,采用创新的达芬奇架构设计。该系列包含多款产品,满足不同场景需求:

- Ascend 910B:旗舰级AI训练芯片,采用7nm工艺,算力达256TOPS(INT8),支持大规模分布式训练

- Ascend 310:面向边缘计算的推理芯片,功耗仅8W,适用于IoT设备和移动终端

- Ascend 910:云端AI训练芯片,支持FP16精度下256TFLOPS算力

这些处理器采用独特的3D Cube计算架构,通过片上存储和高效数据通路设计,相比传统GPU能效比提升2-3倍。实测表明,在ResNet50训练任务中,腾910相比同代GPU可减少30%训练时间。

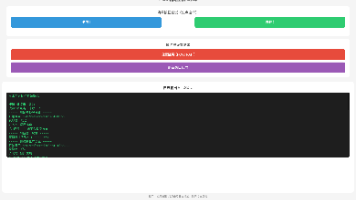

CANN软件栈的完整生态

CANN(Compute Architecture for Neural Networks)是为腾AI处理器量身打造的全栈软件平台,包含以下关键组件:

-

算子开发工具:

- 提供1000+预置高性能算子

- 支持自定义算子开发,提供TBE(Tensor Boost Engine)开发套件

- 自动算子融合优化技术,可减少30%内存访问开销

-

推理引擎:

- 支持TensorFlow、PyTorch、Caffe等主流框架模型导入

- 提供模型压缩工具,支持INT8量化,精度损失<1%

- 动态shape处理能力,适应可变输入尺寸

-

训练加速组件:

- 混合精度训练支持,自动管理FP16/FP32转换

- 分布式训练优化,通信开销降低40%

- 梯度压缩技术,减少75%通信数据量

典型应用场景与案例

智慧城市

某省会城市部署基于腾AI的智能交通系统:

- 使用Ascend 310边缘设备处理路口摄像头数据

- 云端Ascend 910集群进行模型迭代训练

- 实现实时车流分析、违章识别,响应时间<200ms

医疗影像

三甲医院应用腾AI辅助诊断系统:

- CANN优化后的ResNet3D模型处理CT影像

- 推理速度达120帧/秒,准确率98.7%

- 支持DICOM标准接口,无缝对接PACS系统

智能制造

汽车工厂质量检测方案:

- 产线部署Ascend 310设备进行零件缺陷检测

- 采用CANN的模型加密功能保护知识产权

- 漏检率从人工的5%降至0.3%

开发者支持体系

华为为腾AI生态构建了完善的开发者支持:

-

学习资源:

- 官方技术文档和API参考

- 在线实训平台ModelArts

- 认证培训课程(HCIE-AI)

-

开发工具:

- MindStudio集成开发环境

- 性能分析工具Profiler

- 模型转换工具ATC

-

社区支持:

- 开发者论坛和技术问答

- 开源模型库ModelZoo

- 定期技术沙龙和黑客松活动

这套完整的软硬件协同解决方案,正在推动AI计算进入高效能、低功耗的新纪元。腾AI处理器与CANN软件栈:开启AI计算新纪元**

在人工智能技术飞速发展的今天,AI计算已成为推动科技进步的关键驱动力。华为昇腾(Ascend)AI处理器及其配套的CANN(Compute Architecture for Neural Networks)软件栈,作为全栈全场景AI解决方案的核心组成部分,正在为AI应用开发带来革命性的变革。本文将深入探讨昇腾AI处理器的架构特性,并详细介绍CANN软件栈的使用方法。

昇腾AI处理器架构解析

达芬奇架构:专为AI计算而生

昇腾AI处理器采用了华为自主研发的达芬奇架构,这是一种专门为AI计算设计的异构计算架构。其核心设计理念是通过三维立方体计算引擎实现极高的计算密度和能效比。

// 达芬奇架构的核心计算单元示意

typedef struct {

int cube_size; // 立方体计算单元尺寸

int vector_size; // 向量计算单元尺寸

int scalar_units; // 标量计算单元数量

int memory_bandwidth; // 内存带宽

} DaVinciCore;

// 典型的达芬奇核心配置

DaVinciCore davinci_core = {

.cube_size = 16, // 16x16x16 立方体

.vector_size = 2048, // 2048位向量处理

.scalar_units = 4, // 4个标量处理单元

.memory_bandwidth = 512 // 512GB/s内存带宽

};

异构计算架构

昇腾处理器采用典型的异构计算架构,将不同类型的计算任务分配给最适合的处理单元:

// 昇腾处理器计算资源分配示例

typedef enum {

AI_CORE, // AI计算核心,处理矩阵运算

CPU_CORE, // 通用CPU核心,处理控制流

VECTOR_ENGINE, // 向量处理引擎

MEMORY_CONTROL // 内存控制器

} ComputeUnitType;

// 任务分发机制

void schedule_task(Task* task, ComputeUnitType preferred_unit) {

switch (preferred_unit) {

case AI_CORE:

// 分配到AI Core执行矩阵乘法等密集计算

schedule_to_aicore(task);

break;

case CPU_CORE:

// 分配到CPU执行复杂控制逻辑

schedule_to_cpu(task);

break;

case VECTOR_ENGINE:

// 分配到向量引擎执行向量运算

schedule_to_vector(task);

break;

default:

// 默认分配到AI Core

schedule_to_aicore(task);

}

}

CANN软件栈深度剖析

CANN架构概览

CANN软件栈为昇腾AI处理器提供了完整的软件开发环境,包含多个层次的关键组件:

// CANN软件栈层次结构

typedef struct {

// 应用层

ApplicationLayer* applications;

// 框架适配层

FrameworkAdapter* mindspore_adapter;

FrameworkAdapter* tensorflow_adapter;

FrameworkAdapter* pytorch_adapter;

// 编译器层

Compiler* tbe_compiler; // Tensor Boost Engine编译器

Compiler* aoe_optimizer; // 自动优化引擎

// 运行时层

Runtime* ascendcl_runtime; // AscendCL运行时

Runtime* task_scheduler; // 任务调度器

// 驱动层

Driver* device_driver; // 设备驱动

} CANNStack;

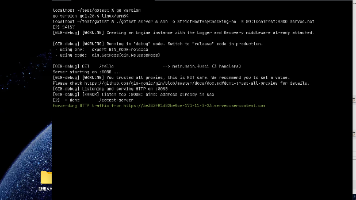

AscendCL:统一运行时接口

AscendCL(Ascend Computing Language)是CANN的核心组件,为开发者提供了统一的编程接口:

#include <acl/acl.h>

#include <acl/runtime/rt.h>

class AscendModel {

private:

aclrtContext context_;

aclmdlDesc* model_desc_;

aclmdlDataset* input_dataset_;

aclmdlDataset* output_dataset_;

public:

// 初始化AscendCL环境

bool Initialize() {

// 初始化ACL

aclError ret = aclInit(nullptr);

if (ret != ACL_SUCCESS) {

printf("Failed to initialize ACL, error code: %d\n", ret);

return false;

}

// 设置设备

ret = aclrtSetDevice(0);

if (ret != ACL_SUCCESS) {

printf("Failed to set device, error code: %d\n", ret);

return false;

}

// 创建上下文

ret = aclrtCreateContext(&context_, 0);

if (ret != ACL_SUCCESS) {

printf("Failed to create context, error code: %d\n", ret);

return false;

}

printf("AscendCL initialized successfully\n");

return true;

}

// 加载模型

bool LoadModel(const char* model_path) {

aclError ret = aclmdlLoadFromFile(model_path, &model_desc_);

if (ret != ACL_SUCCESS) {

printf("Failed to load model from %s, error code: %d\n",

model_path, ret);

return false;

}

// 创建输入输出数据集

input_dataset_ = aclmdlCreateDataset();

output_dataset_ = aclmdlCreateDataset();

if (input_dataset_ == nullptr || output_dataset_ == nullptr) {

printf("Failed to create dataset\n");

return false;

}

printf("Model loaded successfully: %s\n", model_path);

return true;

}

// 执行推理

bool Inference(void* input_data, size_t input_size,

void** output_data, size_t* output_size) {

// 准备输入数据

aclDataBuffer* input_buffer = aclCreateDataBuffer(input_data, input_size);

if (input_buffer == nullptr) {

printf("Failed to create input buffer\n");

return false;

}

aclError ret = aclmdlAddDatasetBuffer(input_dataset_, input_buffer);

if (ret != ACL_SUCCESS) {

printf("Failed to add input buffer to dataset\n");

aclDestroyDataBuffer(input_buffer);

return false;

}

// 执行模型

ret = aclmdlExecute(model_desc_, input_dataset_, output_dataset_);

if (ret != ACL_SUCCESS) {

printf("Failed to execute model, error code: %d\n", ret);

return false;

}

// 获取输出

aclDataBuffer* output_buffer = aclmdlGetDatasetBuffer(output_dataset_, 0);

if (output_buffer != nullptr) {

*output_data = acldvppGetMallocedMemAddr(output_buffer);

*output_size = acldvppGetMallocedMemSize(output_buffer);

}

printf("Inference completed successfully\n");

return true;

}

// 资源清理

void Cleanup() {

if (model_desc_ != nullptr) {

aclmdlUnload(model_desc_);

}

if (input_dataset_ != nullptr) {

aclmdlDestroyDataset(input_dataset_);

}

if (output_dataset_ != nullptr) {

aclmdlDestroyDataset(output_dataset_);

}

if (context_ != nullptr) {

aclrtDestroyContext(context_);

}

aclrtResetDevice(0);

aclFinalize();

printf("AscendCL resources cleaned up\n");

}

};

TBE算子开发框架

TBE(Tensor Boost Engine)是CANN中的算子开发框架,支持自定义算子的开发:

#include <tbe/op_compile.h>

#include <tbe/kernel_register.h>

// 自定义ReLU算子的TBE实现

class CustomReluOp {

public:

// 算子信息注册

static void Register() {

kernel_register::KernelRegister::RegisterKernel(

"CustomRelu", // 算子名称

"AiCore", // 计算核心类型

ParseCustomRelu // 解析函数

);

}

// 算子解析函数

static kernel_register::KernelRegisterParams ParseCustomRelu(

const std::vector<kernel_register::Tensor>& inputs,

const std::vector<kernel_register::Tensor>& outputs,

const kernel_register::Attrs& attrs) {

kernel_register::KernelRegisterParams params;

// 设置计算核心

params.kernel_type = "AiCore";

// 设置计算函数

params.kernel_func = "custom_relu_kernel";

// 设置输入输出格式

params.input_desc.push_back("ND"); // N维张量

params.output_desc.push_back("ND");

// 设置计算模式

params.compute_mode = "vector";

return params;

}

};

// TBE自定义算子实现示例

extern "C" __global__ void custom_relu_kernel(

const float* input,

float* output,

int total_elements) {

// 获取线程ID

int tid = blockIdx.x * blockDim.x + threadIdx.x;

// 处理数据

if (tid < total_elements) {

output[tid] = input[tid] > 0 ? input[tid] : 0;

}

}

// 算子编译接口

class TBEOpCompiler {

public:

static bool CompileCustomOp(const std::string& op_name,

const std::vector<void*>& inputs,

const std::vector<void*>& outputs,

const std::map<std::string, std::string>& attrs) {

// 创建编译配置

op_compile::CompileConfig config;

config.op_name = op_name;

config.target = "AiCore";

config.precision = "float16";

// 设置输入输出描述

for (auto input : inputs) {

op_compile::TensorDesc desc;

desc.format = "ND";

desc.data_type = "float16";

config.inputs_desc.push_back(desc);

}

for (auto output : outputs) {

op_compile::TensorDesc desc;

desc.format = "ND";

desc.data_type = "float16";

config.outputs_desc.push_back(desc);

}

// 执行编译

op_compile::CompileResult result = op_compile::CompileOp(config);

if (result.success) {

printf("Custom op %s compiled successfully\n", op_name.c_str());

printf("Generated kernel: %s\n", result.kernel_name.c_str());

return true;

} else {

printf("Failed to compile custom op %s: %s\n",

op_name.c_str(), result.error_msg.c_str());

return false;

}

}

};

完整应用示例:图像分类系统

下面展示一个基于昇腾AI处理器和CANN的完整图像分类应用:

#include <iostream>

#include <vector>

#include <memory>

#include <opencv2/opencv.hpp>

class AscendImageClassifier {

private:

std::unique_ptr<AscendModel> model_;

int input_width_;

int input_height_;

int input_channels_;

public:

AscendImageClassifier() : input_width_(224), input_height_(224), input_channels_(3) {}

// 初始化分类器

bool Initialize(const std::string& model_path) {

model_ = std::make_unique<AscendModel>();

if (!model_->Initialize()) {

std::cerr << "Failed to initialize AscendModel" << std::endl;

return false;

}

if (!model_->LoadModel(model_path.c_str())) {

std::cerr << "Failed to load model: " << model_path << std::endl;

return false;

}

std::cout << "Image classifier initialized successfully" << std::endl;

return true;

}

// 图像预处理

std::vector<float> PreprocessImage(const cv::Mat& image) {

cv::Mat resized_image;

// 调整图像尺寸

cv::resize(image, resized_image, cv::Size(input_width_, input_height_));

// 转换颜色空间 BGR -> RGB

cv::Mat rgb_image;

cv::cvtColor(resized_image, rgb_image, cv::COLOR_BGR2RGB);

// 归一化处理

cv::Mat normalized_image;

rgb_image.convertTo(normalized_image, CV_32FC3, 1.0/255.0);

// 构建NHWC格式的张量数据

std::vector<float> tensor_data;

tensor_data.reserve(input_width_ * input_height_ * input_channels_);

for (int h = 0; h < input_height_; ++h) {

for (int w = 0; w < input_width_; ++w) {

cv::Vec3f pixel = normalized_image.at<cv::Vec3f>(h, w);

tensor_data.push_back(pixel[0]); // R

tensor_data.push_back(pixel[1]); // G

tensor_data.push_back(pixel[2]); // B

}

}

return tensor_data;

}

// 执行分类

std::vector<float> Classify(const cv::Mat& image) {

// 图像预处理

std::vector<float> input_tensor = PreprocessImage(image);

// 执行推理

void* output_data = nullptr;

size_t output_size = 0;

if (!model_->Inference(input_tensor.data(),

input_tensor.size() * sizeof(float),

&output_data, &output_size)) {

std::cerr << "Inference failed" << std::endl;

return {};

}

// 处理输出结果

std::vector<float> results;

if (output_data != nullptr && output_size > 0) {

size_t element_count = output_size / sizeof(float);

float* float_output = static_cast<float*>(output_data);

results.assign(float_output, float_output + element_count);

}

return results;

}

// 后处理:获取top-k分类结果

std::vector<std::pair<int, float>> GetTopKResults(

const std::vector<float>& predictions, int k = 5) {

std::vector<std::pair<int, float>> results;

for (int i = 0; i < predictions.size(); ++i) {

results.emplace_back(i, predictions[i]);

}

// 按置信度排序

std::sort(results.begin(), results.end(),

[](const auto& a, const auto& b) {

return a.second > b.second;

});

// 返回top-k结果

if (results.size() > k) {

results.resize(k);

}

return results;

}

~AscendImageClassifier() {

if (model_) {

model_->Cleanup();

}

}

};

// 性能监控类

class PerformanceMonitor {

private:

std::chrono::steady_clock::time_point start_time_;

aclrtStream stream_;

public:

void StartTimer() {

start_time_ = std::chrono::steady_clock::now();

}

double EndTimer() {

auto end_time = std::chrono::steady_clock::now();

std::chrono::duration<double> duration = end_time - start_time_;

return duration.count();

}

// 异步执行性能监控

void MonitorStreamPerformance(aclrtStream stream) {

stream_ = stream;

// 创建事件用于时间测量

aclrtEvent start_event, end_event;

aclrtCreateEvent(&start_event);

aclrtCreateEvent(&end_event);

// 记录开始事件

aclrtRecordEvent(start_event, stream_);

// 在实际应用中,这里会等待任务完成

// aclrtSynchronizeStream(stream_);

// 记录结束事件

aclrtRecordEvent(end_event, stream_);

// 计算执行时间

float elapsed_time = 0;

aclrtEventElapsedTime(&elapsed_time, start_event, end_event);

std::cout << "Kernel execution time: " << elapsed_time << " ms" << std::endl;

// 清理事件

aclrtDestroyEvent(start_event);

aclrtDestroyEvent(end_event);

}

};

// 主程序示例

int main() {

// 初始化图像分类器

AscendImageClassifier classifier;

if (!classifier.Initialize("./resnet50.om")) {

std::cerr << "Failed to initialize classifier" << std::endl;

return -1;

}

// 加载测试图像

cv::Mat test_image = cv::imread("./test_image.jpg");

if (test_image.empty()) {

std::cerr << "Failed to load test image" << std::endl;

return -1;

}

// 性能监控

PerformanceMonitor monitor;

monitor.StartTimer();

// 执行分类

auto predictions = classifier.Classify(test_image);

double inference_time = monitor.EndTimer();

std::cout << "Total inference time: " << inference_time * 1000 << " ms" << std::endl;

// 获取top-5分类结果

auto top_results = classifier.GetTopKResults(predictions, 5);

// 输出结果

std::cout << "Top-5 classification results:" << std::endl;

for (const auto& result : top_results) {

std::cout << "Class " << result.first << ": " << result.second * 100 << "%" << std::endl;

}

return 0;

}

性能优化最佳实践

内存管理优化

class MemoryManager {

private:

std::vector<void*> device_memory_ptrs_;

public:

// 分配设备内存

void* AllocateDeviceMemory(size_t size) {

void* ptr = nullptr;

aclError ret = aclrtMalloc(&ptr, size, ACL_MEM_MALLOC_HUGE_FIRST);

if (ret != ACL_SUCCESS) {

std::cerr << "Failed to allocate device memory, size: "

<< size << std::endl;

return nullptr;

}

device_memory_ptrs_.push_back(ptr);

return ptr;

}

// 内存复用管理

class MemoryPool {

private:

std::map<size_t, std::vector<void*>> memory_pool_;

public:

void* GetMemory(size_t size) {

if (memory_pool_.find(size) != memory_pool_.end() &&

!memory_pool_[size].empty()) {

void* ptr = memory_pool_[size].back();

memory_pool_[size].pop_back();

return ptr;

}

return nullptr;

}

void ReturnMemory(void* ptr, size_t size) {

memory_pool_[size].push_back(ptr);

}

};

~MemoryManager() {

for (void* ptr : device_memory_ptrs_) {

aclrtFree(ptr);

}

}

};

流水线并行处理

class PipelineProcessor {

private:

std::vector<aclrtStream> streams_;

std::vector<AscendModel> models_;

public:

bool Initialize(int pipeline_depth, const std::string& model_path) {

// 创建多个流用于流水线并行

for (int i = 0; i < pipeline_depth; ++i) {

aclrtStream stream;

aclrtCreateStream(&stream);

streams_.push_back(stream);

// 为每个流创建模型实例

AscendModel model;

if (model.Initialize() && model.LoadModel(model_path.c_str())) {

models_.push_back(std::move(model));

}

}

return streams_.size() == pipeline_depth &&

models_.size() == pipeline_depth;

}

// 流水线推理

void ProcessBatch(const std::vector<cv::Mat>& images) {

for (size_t i = 0; i < images.size(); ++i) {

int stream_idx = i % streams_.size();

// 在不同的流上并行执行

// 实际应用中需要使用异步API

auto preprocessed = PreprocessImage(images[i]);

// models_[stream_idx].InferenceAsync(preprocessed, streams_[stream_idx]);

}

}

};

总结

昇腾AI处理器与CANN软件栈的组合为AI应用开发提供了强大的计算能力和完整的软件生态。通过本文的详细介绍和代码示例,我们可以看到:

- 硬件优势:达芬奇架构专为AI计算优化,提供极高的计算密度和能效比

- 软件完备性:CANN软件栈提供从底层驱动到上层框架的完整支持

- 开发友好:AscendCL提供统一的编程接口,TBE支持自定义算子开发

- 性能卓越:通过内存管理、流水线并行等技术实现极致性能

随着AI技术的不断发展,昇腾AI生态将继续完善,为各行各业的AI应用提供更强大的算力支撑。开发者可以通过深入学习和实践,充分利用这一平台的优势,创造出更多有价值的AI应用。

2025年昇腾CANN训练营第二季,基于CANN开源开放全场景,推出0基础入门系列、码力全开特辑、开发者案例等专题课程,助力不同阶段开发者快速提升算子开发技能。获得Ascend C算子中级认证,即可领取精美证书,完成社区任务更有机会赢取华为手机,平板、开发板等大奖。

报名链接:https://www.hiascend.com/developer/activities/cann20252

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)