为什么说CUDA是NVIDIA的护城河

换个角度,就是AMD、华为昇腾的这些算立卡销量不如NVIDIA?为什么用户更想选择NVIDIA?或者说NVIDIA相比当初的竞争对手做对了什么?CUDA 的优势,本质是它用,形成了几乎无法短期复制的行业标准与路径依赖,用户如果要更换到其他竞品需要成本,短期内效果可能也会打折扣。

换个角度,就是AMD、华为昇腾的这些算立卡销量不如NVIDIA?为什么用户更想选择NVIDIA?或者说NVIDIA相比当初的竞争对手做对了什么?

CUDA 的优势,本质是它用先发优势 + 开发者锁定 + 全栈生态 + 软硬件深度绑定,形成了几乎无法短期复制的行业标准与路径依赖,用户如果要更换到其他竞品需要成本,短期内效果可能也会打折扣。

首先,先发优势

英伟达是如何一步步把CUDA生态最大的,遇到了哪些困难,为什么其他巨头不行?

1、研究通用计算和AI计算领域最早

早在 90 年代,英伟达 CEO 黄仁勋(Jensen)就预见到了并行化的潜力。他解释了当时图形架构的竞争,以及英伟达如何通过专用芯片提高性能,最终形成了如今的多线程机器。

2007 :英伟达推出 CUDA,早于 AMD ROCm、华为昇腾等竞品近 10 年,率先把 GPU 从图形渲染拓展到通用计算

CUDA 1.0 发布,支持 C 语言编程,为开发者提供了一个新的计算平台

2008年:CUDA 2.0 引入了对 C++ 的部分支持,并增加了更多的库和工具 2010年:CUDA 3.0 引入了 Fermi 架构的 GPU,提供了更好的双精度性能和更多的内存带宽 2012年:CUDA 4.0 引入了 Kepler 架构的 GPU,提供了更高的能效和更好的并行处理能力 2014年:CUDA 5.0 引入了 Maxwell 架构的 GPU,进一步提升了能效和性能 ...

2022年:CUDA 12.0 发布,支持 NVIDIA Hopper 架构和 Grace CPU,进一步提升了 HPC 和深度学习任务的性能

2、先有鸡还是先有蛋?

通用GPU计算的市场需求并不旺盛。没有开发者,就没有应用;没有应用,就卖不出芯片。英伟达需要在这个“冷启动”阶段,持续投入巨资,赌一个不确定的未来。

一开始参与CUDA研发的人员不多,不少人认为在GPU增加这些功能是鸡肋

CUDA最初由一个仅12人的小型团队推动,其中包括架构师Stephen、Nader和Carter等核心成员。该项目在公司内部面临巨大阻力——图形团队担心CUDA会占用芯片资源,影响游戏性能测试得分,甚至导致“3D Mark得分低了10%”。

持之以恒的免费赞助和人才培养

英伟达大力资助全球高校的CUDA课程和研究项目,让一代学生和研究人员在最关键的成长期就习惯了CUDA。这些人毕业后进入工业界,自然地将CUDA带入了工业界,形成了强大的用户粘性。

具体策略如下:

跟国内互联网公司策略基本雷同,用免费提升用户黏性,吸引用户参与,靠的就是以下四把斧

-

免费授权:CUDA被预装在所有英伟达GPU中,并向开发者免费开放,极大降低了使用门槛

-

高校合作:公司建立基金会支持高校设立CUDA研究中心,推动并行计算课程进入教学体系,培养早期开发者群体

-

工具链建设:推出CUDA Toolkit,集成调试器、优化器以及cuBLAS、cuDNN等高性能库,使开发者无需深入硬件细节即可高效开发

-

社区运营:通过GTC大会、在线论坛和技术文档,建立起活跃的开发者社区,形成正向反馈循环

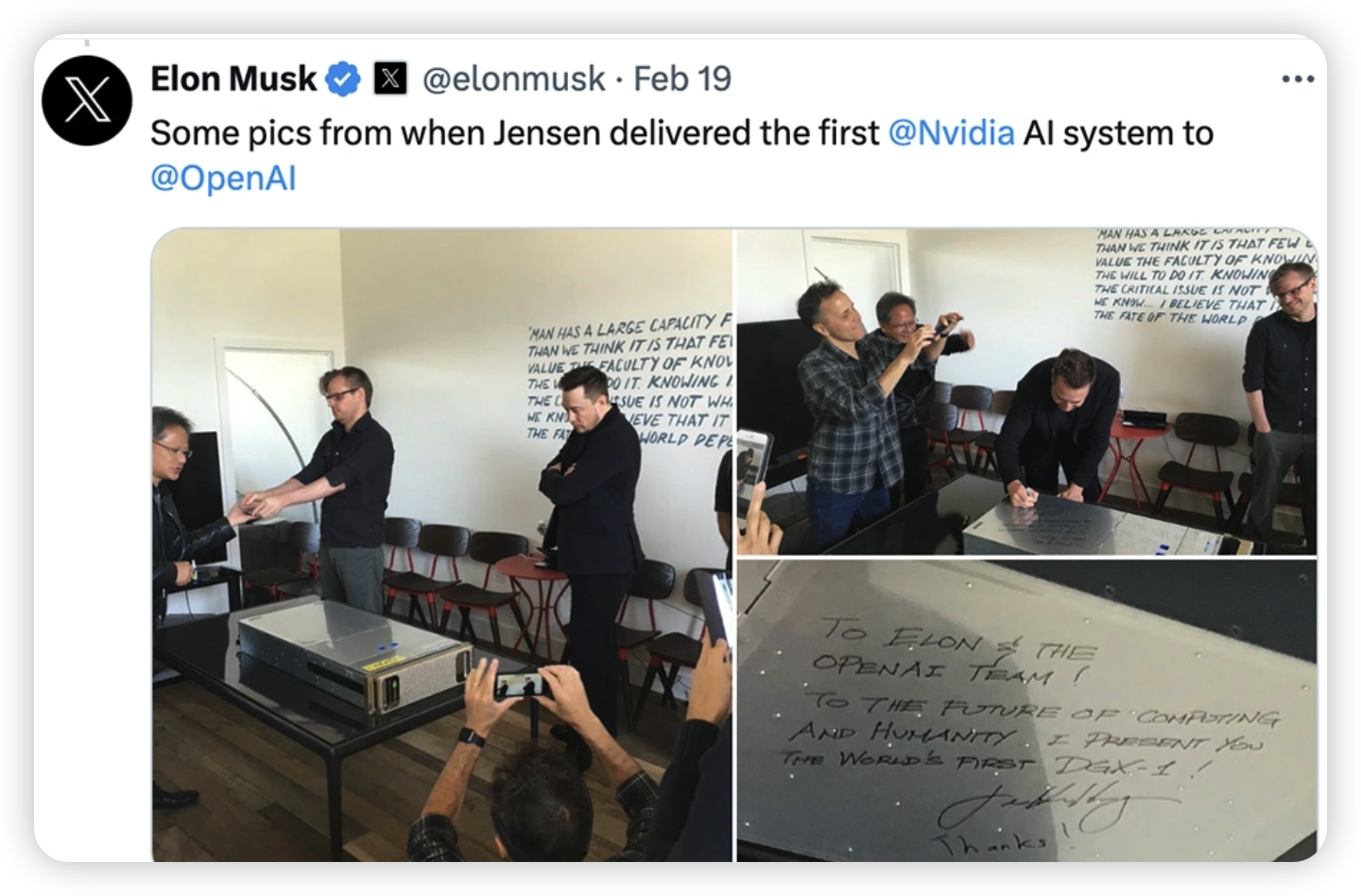

2016年,英伟达向OpenAI捐赠首台DGX-1超级计算机,进一步巩固了其在AI基础设施中的核心地位

此外,马斯克特意转发了强调马斯克和Ilya Sutskever(OpenAI联合创始人、首席科学家)为当时身为“非营利”组织的OpenAI接收英伟达硬件的推文。网友调侃说那时候Ilya还有头发。

CUDA在发布后长达近十年的时间里并未获得广泛认可,甚至被视为“成本中心”,导致公司一度亏损。华尔街直到2016年前后才真正认可其价值

3、后来者的麻烦

后来者追赶很多时候也是无奈,用户已经在用CUDA,后续要更换其他品牌。为了减少迁移成本,后来者需要做一些兼容好保证能丝滑过渡迁移。

多数后来者选择兼容CUDA路线,通过翻译层让CUDA代码跑在自己的硬件上。但这本质上是“用别人的方言”,不仅面临法律风险,更关键的是有超过20%的性能损耗,永远无法达到最优。

4、竞争对手AMD和英特尔在做什么?

AMD当初不够重视,更多只是尝试:

-

AMD在CUDA初期主要通过其Radeon系列GPU与英伟达竞争,但缺乏统一的并行计算编程模型

-

2008年,AMD推出Stream平台,作为其对CUDA的早期回应,旨在支持通用计算(GPGPU),但其生态建设滞后,工具链和开发者支持远不如CUDA成熟

-

2015年,AMD发布ROCm(Radeon Open Compute),这是一个开源的GPU计算平台,试图通过开放标准吸引开发者,但此时CUDA已积累大量代码和用户,ROCm的追赶之路漫长

英特尔重点在CPU领域:

-

英特尔在CUDA初期主要依靠其Xeon CPU和Intel Xeon Phi协处理器(如Knights Corner)进行并行计算,而非直接挑战GPU架构

-

其GPU产品线(如Intel HD Graphics)在消费级市场表现平平,数据中心级GPU研发滞后,未能形成对CUDA的实质性威胁

-

直到2010年代后期,英特尔才开始大力投入专用AI加速器(如Gaudi系列),在CUDA初期阶段影响力有限

谷歌、亚马逊、微软:尚未自研芯片,依赖英伟达供应GPU算力

其次、生态规模

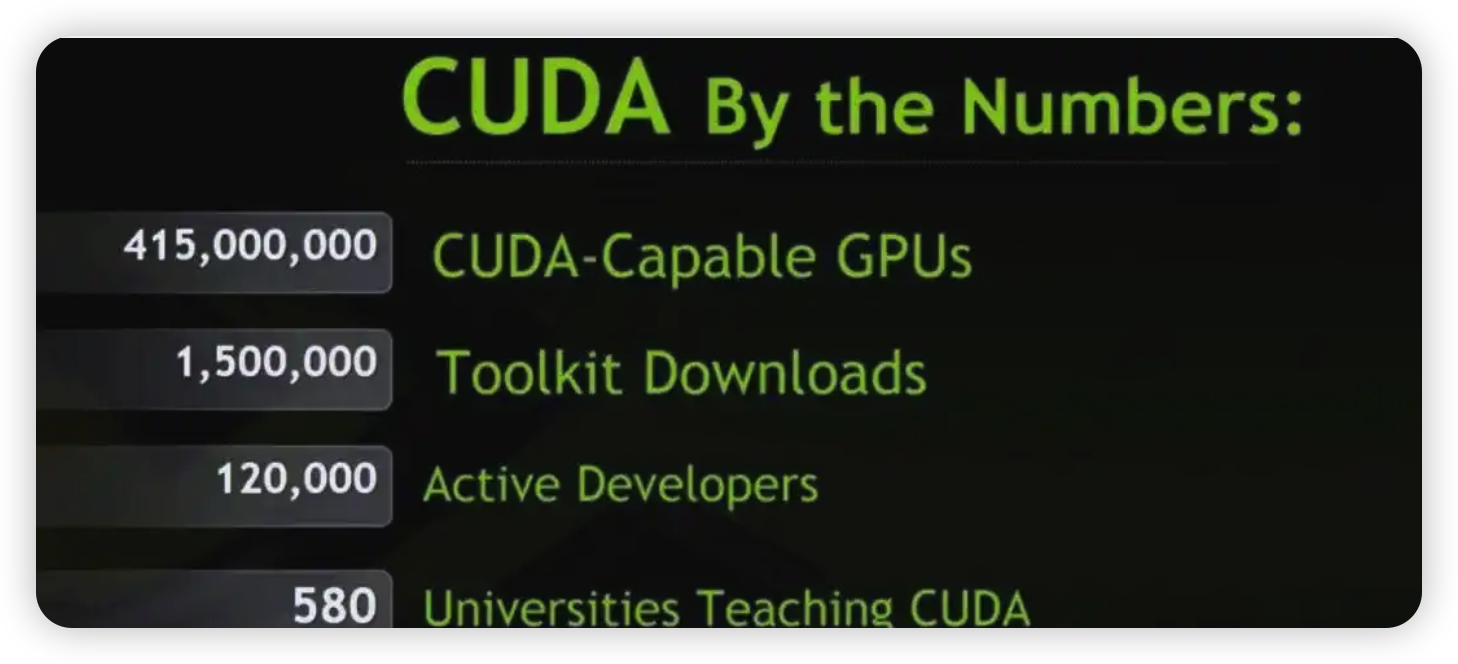

用一些数字回答:

开发者规模:CUDA生态已拥有超过 500万 开发者,涵盖个人与企业,其中企业用户达4万家,仅从事生成式AI开发的企业就占1600家

市场渗透:全球 95%以上 的AI开发者使用CUDA生态进行开发,其工具链和加速库已成为AI研究与应用的基础设施

生态覆盖:CUDA提供超过 300个开发者库、支持 250多个原生框架,并加速了 3500多个应用程序,涵盖AI、科学计算、医学影像、气候模拟等多个关键领域

市场占有率:在AI训练芯片市场,CUDA的份额超过 90%,主流AI框架如PyTorch、TensorFlow等均深度集成并优先优化CUDA,形成事实上的行业标准

罗马不是一日建成的,但一但建成,长期积累形成的强大网络效应和极高的迁移壁垒不是挑战者短期可以取代的。生态伙伴本身也是利益参与方,通过合作获取商业价值,也会是CUDA技术栈的拥护者

截至2023年,全球CUDA开发者数量已超过400万,其中中国占比高达37%

然后,软硬件深度绑定

创始人定位和相关措施:

几年之前 CEO 黄仁勋曾经说过,“英伟达不再是一家硬件公司,而是一家软件公司”。

黄仁勋明确表示:“我们不是芯片公司,而是一家AI基础设施公司。”

英伟达是不是一家软件公司?

其核心竞争力与商业模式早已从 “卖芯片” 转向 “卖软件生态与服务”

-

英伟达推出的Omniverse平台用于3D仿真与数字孪生,完全由软件驱动

-

推出Blackwell架构等新一代芯片时,同步发布配套的算法框架与系统级软件

-

与西门子等工业巨头合作,将NVIDIA的AI软件集成进全球制造流程

-

发布NVIDIA cuLitho计算光刻库,用GPU加速芯片制造过程,反向赋能半导体产业

-

从 GPU 到 DPU、NVLink、DGX 超算,均由软件栈(CUDA、TensorRT、NeMo 等) 统一调度与优化

-

推出NVIDIA AI Enterprise企业级订阅服务,提供端到端 AI 软件栈、支持与安全,软件订阅收入持续增长

构建硬件与软件的“命运共同体”式协同

英伟达的策略是“发现需求→硬件加速→软件封装”的闭环。例如,Tensor Core、光线追踪核心、光线排序硬件等,都是为特定计算任务设计的专用电路。这些硬件的极致性能,只有通过CUDA及其上层API(如OptiX、TensorRT)才能被完全激活和利用。竞争对手的硬件即使在理论性能上接近,也难以复现这种软硬件协同优化带来的实际性能优势。

英伟达是一家软件公司?还是一家硬件公司?留言区聊一聊

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)