ModelEngine智能体编排平台:系统特性与技术亮点深度解析

华为开源ModelEngine全流程AI开发工具链 2025年3月,华为开源ModelEngine工具链,提供从数据处理到模型部署的全流程AI开发支持。 1. 数据使能 支持多模态数据清洗(文本、图像等) 提供QA对生成、知识库管理能力,加速语料生产 2. 模型使能 一键式模型训练与微调(支持LoRA等) 兼容昇腾NPU,开放模型格式(如safetensors) 提供评测、部署及管理工具 3. 应

文章目录

引言

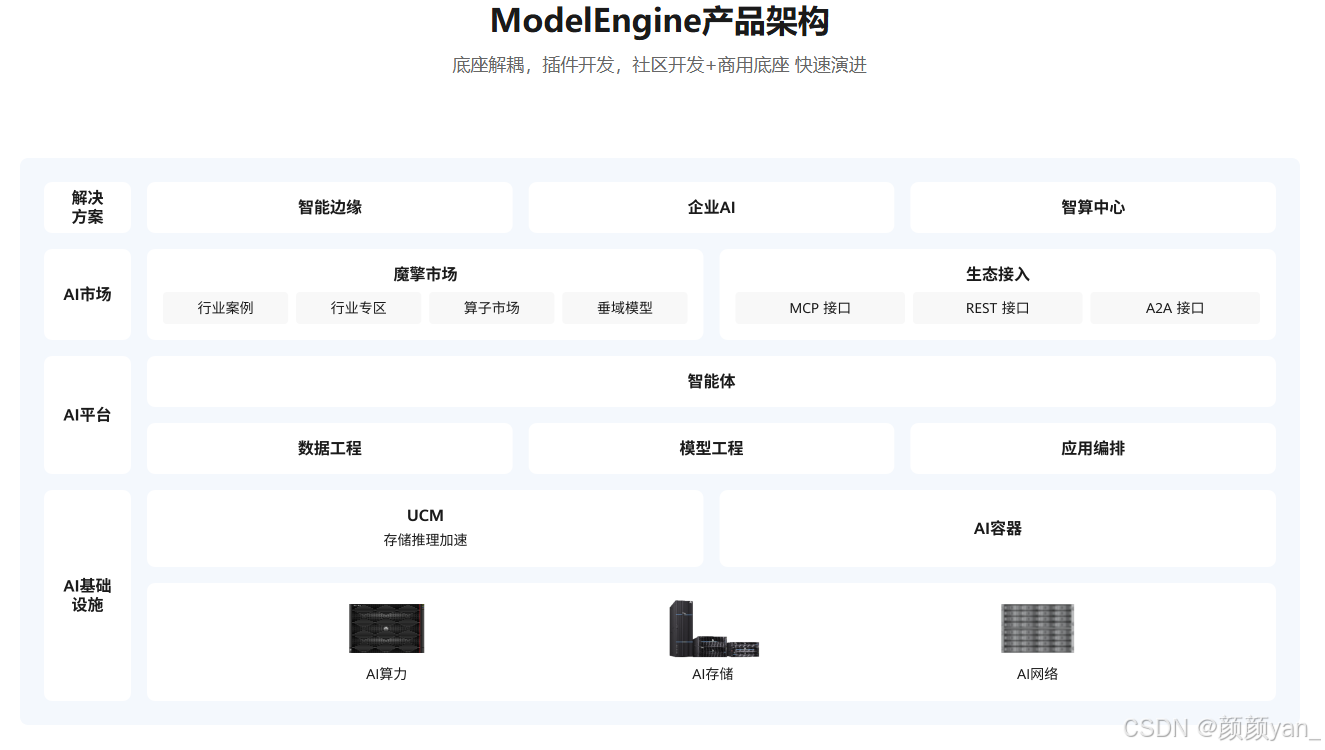

2025年3月,华为正式开源ModelEngine全流程AI开发工具链,并在魔擎社区(modelengine-ai.net)面向全球开发者开放。ModelEngine提供从数据处理、知识生成,到模型微调和部署,以及RAG(Retrieval Augmented Generation)应用开发的AI训推全流程工具链,致力于缩短从数据到模型、从数据到AI应用的落地周期。

平台围绕数据使能、模型使能、应用使能三大核心模块,提供低代码编排、灵活的执行调度、高性能数据总线等技术,为数据开发工程师、模型开发工程师、应用开发工程师提供高效易用、开放灵活、开箱即用、轻量的全流程AI开发体验。

一、数据使能:高质量语料生产引擎

1.1 核心能力概述

数据使能模块是用于文本、图像、文档等各类型数据处理的工具链,提供数据清洗、数据评估、QA对生成、知识生成等关键能力,为大模型训练和RAG应用提供语料和知识。该模块能够将语料生成时间从月级缩短到天级,大幅提升数据工程效率。

1.2 应用场景

| 场景类型 | 解决方案 | 目标 |

|---|---|---|

| 大模型训练场景 | 提供数据处理工具链,解决高质量数据处理困难的问题 | 解决数据处理困难,提升数据质量 |

| 缓解数据量不足的痛点,辅助模型训练提效 | 增加数据量,提升模型训练效率 | |

| 大模型推理场景 | 提供知识库管理能力,解决行业用户领域知识生成与更新的需求 | 帮助行业用户生成和更新领域知识 |

| 帮助用户更加有效落地大模型应用 | 提升大模型在实际应用中的效果 |

1.3 关键技术特性

内置数据清洗算子, 支持多模态数据清洗,覆盖格式包括:

- 文本类型:PDF、DOC、DOCX、Markdown、MD、TXT、Html、XML、JSON

- 图像类型:PNG、JPG、BMP、JPEG

# 数据清洗算子示例

from modelengine.data import DataCleaner

cleaner = DataCleaner()

# 支持批量处理多种格式

cleaned_data = cleaner.process_batch([

{'type': 'pdf', 'path': 'document.pdf'},

{'type': 'docx', 'path': 'report.docx'},

{'type': 'image', 'path': 'chart.png'}

])

二、模型使能:一键式训推工具链

2.1 核心功能定位

模型使能是面向模型微调和模型推理的工具链,降低模型训练和推理门槛,提供一键式操作能力。

2.2 主要应用场景

| 模块类别 | 功能描述 |

|---|---|

| 模型训练 | 提供模型训练工具链 基于界面化配置方式,降低模型训练和微调难度 |

| 模型部署 | 提供模型评测、模型仓库、模型服务等能力 支持大模型部署、上线和版本管理 |

| 模型管理 | 支持模型权重管理、模型量化 提供训练后 checkpoints 的归档能力 |

| 模型评测 | 基于第三方或自定义评测数据,对模型进行精度与性能评测 |

2.3 关键能力

# 模型训练配置示例

model_training:

base_model: "Llama-2-7b"

training_mode: "lora" # 支持LoRA微调

dataset: "custom_qa_pairs"

hyperparameters:

learning_rate: 2e-5

batch_size: 16

epochs: 3

hardware:

accelerator: "ascend_npu" # 支持昇腾NPU

output:

format: "safetensors" # 开放模型格式

checkpoint_interval: 500

关键特性:

-

提供训练引擎和推理引擎

- 支持开发者模型选型/评测、模型训练、模型管理和模型推理

- 提供无代码操作、一键精调能力

-

提供OpenAI标准推理接口

- 一键部署模型

- 兼容主流AI应用框架

-

开放硬件生态

- 支持昇腾NPU

- 开放模型生态,支持safetensors格式模型权重

三、应用使能:低代码RAG应用开发

3.1 核心定位

应用使能为AI应用提供一站式开发、调试和部署的工具,帮助快速构建高准确率的AI应用。

3.2 应用场景

| 模块类别 | 功能描述 |

|---|---|

| 应用开发 | - 提供完整的应用编排框架与丰富的内置插件 - 支持用户快速创建 AI 应用 |

| 应用调试 | - 提供黑盒与白盒两种调试方式 - 支持用户快速定位问题 |

| 应用部署 | - 支持已调试应用的一键快速部署 - 提供公共 URL 与北向 API 两种访问方式 |

3.3 技术特性

| 模块类别 | 功能描述 |

|---|---|

| 面向开发者的开发框架 | - 一站式 AI 应用开发、调试与部署框架 - 支持私域安全部署 |

| 面向普通用户的零代码编排 | - 零代码、可视化 RAG 应用编排框架 - 大幅降低 AI 应用开发门槛 |

| 低代码编排能力 | ModelEngine 开源版本提供: - 低代码编排 - RAG 框架 - 自定义插件能力 |

# RAG应用编排示例

from modelengine.app import RAGApplication

app = RAGApplication(

name="企业知识问答助手",

model="gpt-4",

knowledge_bases=["company_docs", "product_manuals"]

)

# 低代码配置检索策略

app.configure_retrieval(

strategy="hybrid", # 混合检索

top_k=5,

rerank=True

)

# 自定义插件集成

app.add_plugin("custom_validator", validate_answer)

# 一键部署

app.deploy(mode="private", port=8080)

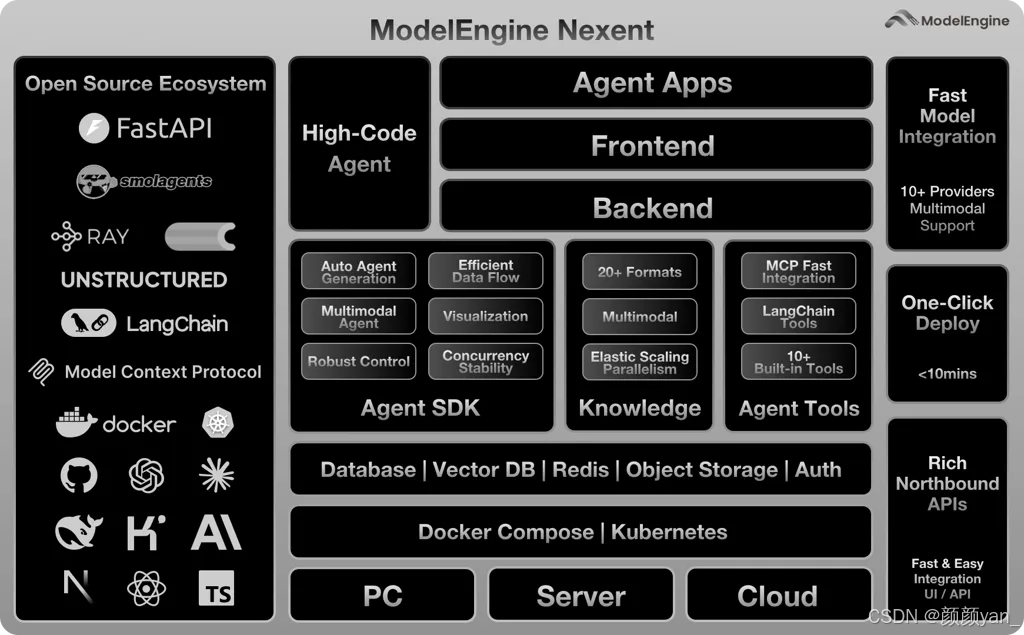

四、Nexent智能体框架:零代码智能体生成

4.1 Nexent核心理念

Nexent是ModelEngine生态中的智能体开发框架,已在GitHub开源(ModelEngine-Group/nexent)。其核心理念是:无需编排,无需复杂拖拽,使用纯语言开发任意智能体。

“One prompt. Endless reach.” (一个提示词,无限可能)

4.2 核心功能特性

1. 智能体提示词自动生成

将自然语言转化为可运行的提示词。Nexent自动选择合适的工具,并为每个请求规划最佳执行路径。

2. 可扩展数据处理引擎

- 支持20+种数据格式处理

- 快速OCR和表格结构提取

- 从单进程到大批量流水线的平滑扩展

3. 个人级知识库

- 实时导入文件并自动摘要

- 智能体可以即时访问个人和全局知识

- 智能体了解每个知识库能提供什么信息

4. 互联网知识搜索

- 连接5+种网络搜索提供商

- 智能体可以混合使用最新互联网信息和私有数据

5. 知识级可追溯性

- 提供来自网络和知识库来源的精确引用

- 使每个事实都可验证

6. 多模态理解与对话

- 支持语音、文本、文件或图像输入

- Nexent理解语音、文本和图片,甚至可以按需生成新图像

7. MCP工具生态系统

- 支持插入或构建遵循MCP规范的Python插件

- 无需触碰核心代码即可交换模型、工具和链

4.3 快速部署

Nexent提供Docker Compose快速启动方案:

# 系统要求

# CPU: 2核心

# RAM: 6 GiB

# 软件: Docker & Docker Compose

git clone https://github.com/ModelEngine-Group/nexent.git

cd nexent/docker

cp .env.example .env # 填写必要配置

bash deploy.sh

# 启动后访问 http://localhost:3000

五、技术优势

| 模块 | 功能描述 |

|---|---|

| ** 全流程覆盖** | - 数据层:数据清洗、质量评估、QA对生成 - 模型层:训练、微调、部署、评测 - 应用层:RAG框架、低代码编排、智能体开发 |

| 开箱即用 | - 内置丰富的数据处理算子 - 预置模型训练模板 - 提供完整的应用框架 |

| 开放生态 | - 支持开放的数据格式和模型格式 - 兼容主流 AI 框架(LangChain、LlamaIndex 等) - 支持多种硬件平台(昇腾 NPU 等) |

| 降本增效 | - 语料生成时间从月缩短到天 - 一键式模型训练和部署 - 零代码智能体开发 |

结语

ModelEngine作为华为开源的全流程AI开发工具链,通过数据使能、模型使能、应用使能三大核心能力,为AI应用开发提供了完整的解决方案。结合Nexent智能体框架的零代码开发范式和MCP工具生态的开放性,ModelEngine正在构建一个健康、活跃的AI开发者社区。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)