DeepSeek-V4-PRO 昇腾910B多机多卡级联及大EP架构部署实操方案(含4台服务器+RoCE交换机+全闪存储)

一、方案概述

1.1 文档目的

本文档针对DeepSeek-V4-PRO模型,提供昇腾910B多机多卡级联(分布式部署)及大EP(Extended Processing)架构的标准化部署实操流程,覆盖2台及以上服务器(重点补充4台服务器场景)、RoCE交换机配套配置、外接全闪存储实操,涵盖环境准备、架构配置、模型部署、功能验证、故障处理全环节,为技术实施人员提供可落地的操作指导,确保部署过程平稳高效,充分发挥多机多卡级联的算力优势、大EP架构的性能提升作用,以及RoCE交换机、全闪存储的硬件支撑作用,满足生产环境高并发、高吞吐量、高可靠性的推理需求。

1.2 适用范围

本方案适用于基于昇腾910B NPU服务器、部署DeepSeek-V4-PRO模型的场景,涵盖2台及以上服务器(重点适配4台单机8卡昇腾910B服务器)的多机多卡级联部署,配套RoCE交换机高速互联、外接全闪存储扩展存储能力,以及大EP架构的配置与优化,面向技术实施、运维及相关对接人员,要求实施人员具备昇腾环境操作、Linux系统管理、分布式部署、网络设备配置、存储设备操作基础经验。

1.3 核心前提

1. 硬件环境:2台及以上(重点4台)昇腾910B单机8卡服务器(推荐同型号、同配置),配套1台RoCE交换机(支持RoCE v2协议,带宽≥100Gbps),1台外接全闪存储(容量≥1.2TB,支持iSCSI协议,读写速度≥1GB/s);服务器间通过RoCE交换机实现高速互联,所有服务器剩余本地存储空间≥300GB(用于存放日志、临时文件),全闪存储用于存放模型权重及核心数据;每台服务器、RoCE交换机、全闪存储电源、散热正常。

2. 软件环境:所有服务器统一安装CANN套件(≥8.0.5,推荐8.0.5版本,确保多机兼容性)、昇腾驱动(匹配CANN版本),Python版本≥3.10.x(推荐3.10.16),操作系统统一为EulerOS 2.0 SP10或Ubuntu 20.04 LTS;RoCE交换机支持固件升级,全闪存储支持iSCSI协议配置。

3. 权限与网络:所有服务器具备root或sudo高权限,服务器与RoCE交换机、全闪存储网络通畅(无防火墙拦截、端口限制),服务器间实现SSH免密登录;RoCE交换机配置静态IP,与服务器处于同一网段;全闪存储配置静态IP,可被所有服务器访问;所有设备可访问ModelScope、清华PyPI源(用于下载模型权重及依赖)。

4. 架构说明:多机多卡级联采用“张量并行+流水线并行”混合并行策略,4台服务器协同实现分布式推理;RoCE交换机负责优化服务器间数据传输,降低通信延迟;全闪存储提供高并发、高吞吐的存储支撑,统一存放模型权重,避免多机同步模型的繁琐操作;大EP架构通过扩展处理单元、优化任务调度,进一步提升模型推理的并行效率和吞吐量,四者结合适配DeepSeek-V4-PRO的大参数量、高并发需求。

二、前期准备(全设备统一执行/配置)

2.1 硬件检查与确认(服务器+RoCE交换机+全闪存储)

1. 服务器硬件检查:每台服务器执行以下命令,确保所有NPU卡状态为Normal,无故障提示;同时检查RoCE网卡状态,确保正常识别。

|

bash

# 查看NPU状态(需8张卡均为Normal)

npu-smi info

# 检查NPU温度、功耗(避免硬件过热)

npu-smi info --query-gpu=temperature.gpu,power.draw --format=csv

# 检查RoCE网卡状态(确保网卡正常识别,替换ethX为实际RoCE网卡名称)

ip addr show ethX

# 验证RoCE网卡驱动(确保驱动正常加载)

lspci | grep -i roce |

2. RoCE交换机检查与基础配置:登录RoCE交换机,检查设备状态,配置基础网络参数,确保与服务器互联互通。

|

bash

# 1. 登录RoCE交换机(通过Console口或SSH登录,默认账号密码参考交换机说明书)

ssh admin@RoCE交换机IP(如192.168.1.1)

# 2. 检查交换机状态(确保无硬件故障、端口正常)

display device

display interface brief

# 3. 配置交换机静态IP(与服务器同一网段,如192.168.1.1/24)

system-view

interface Vlanif 1

ip address 192.168.1.1 255.255.255.0

quit

# 4. 开启RoCE v2协议(关键配置,优化多机通信延迟)

system-view

roce enable

roce version v2

# 5. 配置交换机端口(将连接服务器RoCE网卡的端口设为 trunk 模式,开启高速率)

interface Eth-Trunk 1

port link-type trunk

port trunk allow-pass vlan 1

speed 100000 # 配置100Gbps速率(根据交换机型号调整)

quit

# 6. 保存配置(避免重启丢失)

save

# 7. 验证交换机端口状态(连接服务器后,确保端口UP)

display interface Eth-Trunk 1 |

3. 全闪存储检查与基础配置:登录全闪存储管理界面,检查存储状态,配置iSCSI协议,创建共享存储目录,确保可被所有服务器访问。

|

bash

# 1. 登录全闪存储管理界面(通过浏览器访问存储IP,如192.168.1.2,默认账号密码参考说明书)

# 2. 基础配置(图形化界面操作,核心步骤)

# 2.1 配置静态IP(与服务器、RoCE交换机同一网段,如192.168.1.2/24)

# 2.2 开启iSCSI协议(存储管理 > 协议配置 > iSCSI,启用iSCSI服务)

# 2.3 创建存储池(存储管理 > 存储池,选择全闪盘,创建存储池,容量≥1.2TB)

# 2.4 创建iSCSI LUN(存储管理 > LUN,创建LUN,大小≥1TB,关联存储池)

# 2.5 创建iSCSI目标器(存储管理 > iSCSI > 目标器,绑定LUN,设置目标器名称,如iqn.2026-04:ds-v4-pro-storage)

# 2.6 配置访问控制(允许所有服务器IP访问,或添加服务器IP白名单)

# 3. 验证存储状态(查看存储池、LUN状态,确保无故障)

# 命令行验证(可选,登录存储后台)

show storage-pool status

show iscsi target status |

4. 设备间互联验证:确保服务器与RoCE交换机、全闪存储网络通畅,无延迟、无丢包。

|

bash

# 1. 服务器 ping RoCE交换机(确保网络通畅,延迟≤1ms)

ping 192.168.1.1 -c 10

# 2. 服务器 ping 全闪存储(确保网络通畅,延迟≤5ms)

ping 192.168.1.2 -c 10

# 3. 测试服务器与RoCE交换机的带宽(需安装iperf3,主节点执行)

iperf3 -c 192.168.1.1 -t 30 # 带宽需≥100Gbps

# 4. 测试服务器与全闪存储的读写速度(后续挂载后测试) |

5. 存储空间检查:确保每台服务器本地剩余空间≥300GB,全闪存储LUN剩余空间≥1TB(用于存放模型权重)。

|

bash

# 查看服务器本地/data目录剩余空间

df -h | grep /data

# 查看全闪存储LUN剩余空间(登录存储管理界面或后台)

show lun capacity |

2.2 软件环境统一配置(所有服务器)

1. 统一CANN版本(若未安装或版本不统一):所有服务器执行以下步骤,升级至CANN 8.0.5版本(参考昇腾官方安装包,对应服务器架构)。

|

bash

# 1. 卸载原有低版本CANN(若存在)

sudo /usr/local/Ascend/ascend-toolkit/latest/uninstall.sh

# 2. 下载CANN 8.0.5安装包(昇腾官网获取,上传至所有服务器)

# 3. 赋予安装包执行权限

chmod +x Ascend-cann-toolkit_8.0.5_linux-aarch64.run

# 4. 安装CANN 8.0.5(所有服务器安装路径一致)

sudo ./Ascend-cann-toolkit_8.0.5_linux-aarch64.run --run-as=root --install-path=/usr/local/Ascend

# 5. 配置环境变量(永久生效)

echo "source /usr/local/Ascend/ascend-toolkit/latest/set_env.sh" >> ~/.bashrc

source ~/.bashrc

# 6. 验证CANN版本

cat /usr/local/Ascend/version.txt 2>/dev/null || echo "CANN安装失败" |

2. 统一Python版本:所有服务器升级Python至3.10.x,确保版本一致。

|

bash

# EulerOS系统

sudo yum install -y python3.10 python3.10-pip

# Ubuntu系统

sudo apt install -y python3.10 python3.10-pip

# 验证Python版本

python3 --version # 需输出Python 3.10.x |

3. 安装基础工具与RoCE、iSCSI相关依赖:所有服务器安装部署所需工具,确保RoCE通信、全闪存储挂载正常。

|

bash

# EulerOS系统

sudo yum install -y wget curl git iperf3 openssh-server iscsi-initiator-utils libibverbs-devel

# Ubuntu系统

sudo apt install -y wget curl git iperf3 openssh-server open-iscsi libibverbs-dev

# 启动SSH服务(确保多机免密登录)

sudo systemctl start sshd

sudo systemctl enable sshd

# 启动iSCSI服务(用于挂载全闪存储)

sudo systemctl start iscsid

sudo systemctl enable iscsid

# 验证RoCE相关依赖(确保RoCE通信正常)

ibv_devinfo # 输出RoCE网卡信息即为正常 |

2.3 多机免密登录配置(主节点操作)

主节点需实现与所有从节点的SSH免密登录,避免部署过程中频繁输入密码,提升效率(4台服务器场景:1台主节点,3台从节点)。

|

bash

# 1. 主节点生成SSH密钥(无需设置密码,直接回车)

ssh-keygen -t rsa

# 2. 将公钥分发至所有从节点(替换xxx.xxx.xxx.xxx为从节点IP,root为用户名,共3台)

ssh-copy-id root@192.168.1.11 # 从节点1

ssh-copy-id root@192.168.1.12 # 从节点2

ssh-copy-id root@192.168.1.13 # 从节点3

# 3. 验证免密登录(无密码即可登录即为成功,分别验证3台从节点)

ssh root@192.168.1.11

exit

ssh root@192.168.1.12

exit

ssh root@192.168.1.13

exit |

2.4 全闪存储挂载(所有服务器执行)

所有服务器挂载外接全闪存储的iSCSI LUN,统一挂载路径,用于存放DeepSeek-V4-PRO模型权重,实现多机共享模型,避免重复下载和同步。

|

bash

# 1. 发现全闪存储iSCSI目标器(替换全闪存储IP:192.168.1.2)

iscsiadm -m discovery -t st -p 192.168.1.2

# 2. 登录iSCSI目标器(替换目标器名称,与全闪存储配置一致,如iqn.2026-04:ds-v4-pro-storage)

iscsiadm -m node -T iqn.2026-04:ds-v4-pro-storage -p 192.168.1.2 -l

# 3. 查看挂载的iSCSI设备(确认设备名称,如/dev/sdb)

lsblk

# 4. 格式化设备(仅主节点执行,避免多机重复格式化)

# 主节点执行:

mkfs.xfs /dev/sdb # 格式化为xfs格式,适配大文件存储

# 从节点无需执行格式化,直接挂载

# 5. 创建挂载目录(所有服务器路径统一)

mkdir -p /data/storage/ds-v4-pro

chmod 777 /data/storage/ds-v4-pro

# 6. 挂载全闪存储(所有服务器执行)

mount /dev/sdb /data/storage/ds-v4-pro

# 7. 配置永久挂载(避免重启后失效,所有服务器执行)

echo "/dev/sdb /data/storage/ds-v4-pro xfs defaults 0 0" >> /etc/fstab

# 8. 验证挂载(所有服务器执行,确保挂载成功,空间正常)

df -h | grep /data/storage/ds-v4-pro |

2.5 核心依赖安装(所有服务器统一执行)

安装DeepSeek-V4-PRO部署所需核心依赖,确保版本严格匹配,避免兼容性问题(推荐使用虚拟环境隔离,避免与其他项目冲突)。

|

bash

# 1. 安装虚拟环境工具

pip3 install virtualenv -i https://pypi.tuna.tsinghua.edu.cn/simple

# 2. 创建DeepSeek-V4-PRO专属虚拟环境(所有服务器路径一致)

virtualenv /root/ds-v4-pro-env

# 3. 激活虚拟环境(后续所有操作均在此环境中执行)

source /root/ds-v4-pro-env/bin/activate

# 4. 设置pip源(加速下载)

pip config set global.index-url https://pypi.tuna.tsinghua.edu.cn/simple

# 5. 安装昇腾定制版vLLM(核心依赖,支持多机多卡级联及大EP架构)

pip install vllm-ascend==0.15.0 # 版本需≥0.15.0,支持大EP优化

# 6. 安装核心依赖(版本严格匹配)

pip install transformers==4.40.0 sentencepiece==0.1.99 accelerate==0.30.0 numpy==1.26.4

# 7. 安装接口服务依赖(用于模型推理接口暴露)

pip install fastapi==0.109.2 uvicorn==0.27.1 requests==2.31.0

# 8. 安装昇腾定制版PyTorch(适配CANN 8.0.5及多机多卡)

pip install torch==2.3.0 torch-npu==2.3.0 -f https://download.openmmlab.com/mmcv/dist/ascend/torch2.3.0/index.html

# 9. 安装ModelScope(用于下载DeepSeek-V4-PRO模型权重)

pip install modelscope==1.11.0

# 10. 安装多机通信依赖(支持多机级联,适配RoCE交换机)

pip install mpi4py==3.1.4 pyverbs==0.19.0 # pyverbs用于优化RoCE通信 |

2.6 模型权重下载(主节点执行,共享至全闪存储)

DeepSeek-V4-PRO模型权重较大,仅在主节点下载,直接保存至全闪存储挂载目录,所有服务器可共享访问,无需多机同步,提升部署效率。

|

bash

# 1. 激活虚拟环境

source /root/ds-v4-pro-env/bin/activate

# 2. 创建模型存储目录(全闪存储挂载路径下,所有服务器可共享)

mkdir -p /data/storage/ds-v4-pro/DeepSeek-V4-PRO

chmod 777 /data/storage/ds-v4-pro/DeepSeek-V4-PRO

# 3. 从ModelScope下载DeepSeek-V4-PRO权重(昇腾适配版)

modelscope download --model vllm-ascend/DeepSeek-V4-PRO --local-dir /data/storage/ds-v4-pro/DeepSeek-V4-PRO

# 4. 验证权重文件完整性(确保核心文件齐全)

ls /data/storage/ds-v4-pro/DeepSeek-V4-PRO | grep -E "config.json|model.safetensors|tokenizer.json"

# 5. 所有从节点验证共享访问(从节点执行,确保可正常读取模型文件)

ls /data/storage/ds-v4-pro/DeepSeek-V4-PRO | grep -E "config.json|model.safetensors" |

三、多机多卡级联配置(核心步骤,4台服务器场景)

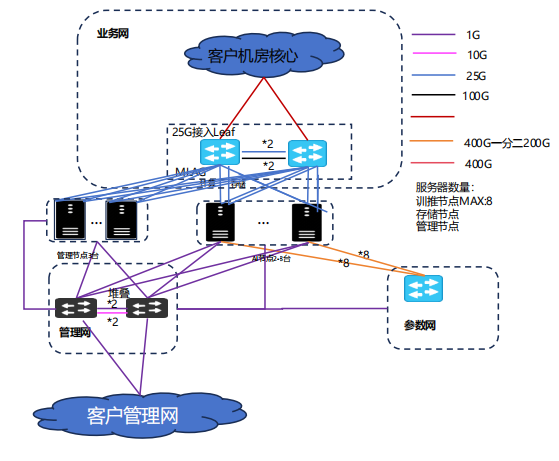

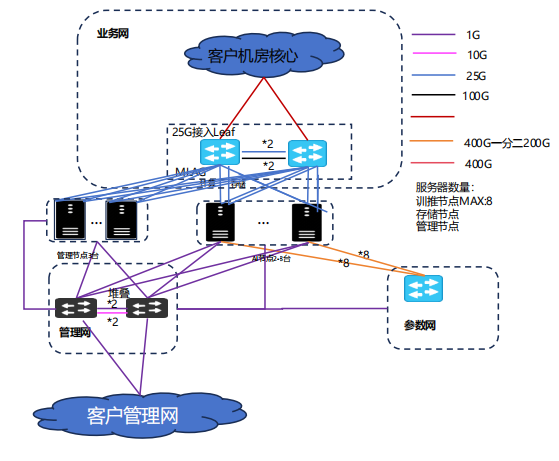

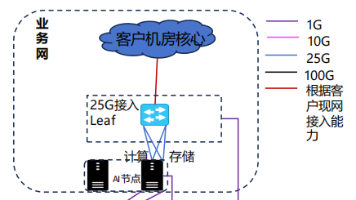

3.1 级联架构规划(4台单机8卡服务器+RoCE交换机+全闪存储)

以4台昇腾910B单机8卡服务器(1台主节点+3台从节点)、1台RoCE交换机、1台全闪存储为例,规划并行策略、节点分配、端口及路径,充分利用硬件资源:

1. 并行策略:采用“张量并行(Tensor Parallelism)+ 流水线并行(Pipeline Parallelism)”混合并行,单节点内8张NPU卡采用张量并行(充分利用单节点算力),4台服务器间采用流水线并行(通过RoCE交换机实现高速通信,降低延迟),总并行度32(4台×8卡),适配DeepSeek-V4-PRO大参数量推理需求。

2. 节点分配:

- 主节点(IP:192.168.1.10):8张NPU卡,承担主进程调度、模型部分层的计算,同时负责接口暴露、全闪存储挂载管理;

- 从节点1(IP:192.168.1.11):8张NPU卡,承担模型部分层的计算,与主节点、其他从节点协同完成推理;

- 从节点2(IP:192.168.1.12):8张NPU卡,功能同从节点1;

- 从节点3(IP:192.168.1.13):8张NPU卡,功能同从节点1;

- RoCE交换机(IP:192.168.1.1):负责4台服务器间的数据传输,优化通信延迟,确保多机协同高效;

- 全闪存储(IP:192.168.1.2):挂载至所有服务器,统一存放模型权重,实现多机共享。

3. 端口规划:

- 主节点:暴露推理接口端口(8000),供外部调用;

- 所有节点:内部通信端口(29500-29510,默认无需修改,确保无端口冲突),用于多机间协同计算;

- RoCE交换机:默认通信端口(无需额外配置,确保与服务器RoCE网卡端口互通);

- 全闪存储:iSCSI协议端口(3260,默认,确保无防火墙拦截)。

4. 路径规划:所有节点模型路径、虚拟环境路径、日志路径、启动脚本路径完全一致,具体如下:

- 虚拟环境路径:/root/ds-v4-pro-env;

- 模型路径(全闪存储共享):/data/storage/ds-v4-pro/DeepSeek-V4-PRO;

- 日志路径:/data/logs/ds-v4-pro;

- 启动脚本路径:/root/ds-v4-pro-start.sh。

3.2 多机通信配置(所有节点执行,适配RoCE交换机)

配置多机间通信参数,结合RoCE交换机优化通信性能,确保主从节点能够正常通信,支持分布式张量并行和流水线并行,降低通信延迟。

|

bash

# 1. 配置环境变量(永久生效,适配多机通信、RoCE优化及大EP架构)

echo "export ASCEND_GLOBAL_WORKSPACE_SIZE=8192" >> ~/.bashrc # 增大工作空间,适配大EP

echo "export PYTORCH_NPU_ALLOC_CONF=expandable_segments:True" >> ~/.bashrc

echo "export ASCEND_GLOBAL_LOG_LEVEL=3" >> ~/.bashrc

echo "export OMP_NUM_THREADS=32" >> ~/.bashrc # 适配多机多卡,提升CPU利用率

echo "export ASCEND_ENABLE_MOE_OPTIMIZE=1" >> ~/.bashrc # 开启MoE优化(DeepSeek-V4-PRO支持MoE)

echo "export ASCEND_NPU_LAUNCH_MODE=0" >> ~/.bashrc

echo "export MASTER_ADDR=192.168.1.10" >> ~/.bashrc # 主节点IP,所有节点统一配置

echo "export MASTER_PORT=29500" >> ~/.bashrc # 主节点通信端口,所有节点统一配置

echo "export WORLD_SIZE=32" >> ~/.bashrc # 总GPU数量(4台×8卡=32,固定配置)

echo "export NCCL_SOCKET_IFNAME=ethX" >> ~/.bashrc # 替换ethX为RoCE网卡名称,优化通信

echo "export NCCL_IB_DISABLE=0" >> ~/.bashrc # 启用IB/RoCE通信

echo "export NCCL_IB_HCA=mlx5_0" >> ~/.bashrc # 适配RoCE网卡,根据实际网卡调整

# 2. 立即生效环境变量

source ~/.bashrc

# 3. 验证RoCE通信配置(所有节点执行,确保RoCE正常工作)

ib_send_bw -i ethX -d mlx5_0 192.168.1.10 # 主节点与从节点互测,无报错即为正常 |

3.3 级联启动脚本编写(主节点执行)

编写4台服务器多机多卡级联启动脚本,统一调度主从节点,配置并行参数、模型路径(全闪存储路径)、接口参数等,适配RoCE交换机通信,脚本路径统一为/root/ds-v4-pro-start.sh。

|

bash

#!/bin/bash

# DeepSeek-V4-PRO 4台昇腾910B多机多卡级联启动脚本(主节点执行,适配RoCE交换机+全闪存储)

# 激活虚拟环境

source /root/ds-v4-pro-env/bin/activate

# 定义节点IP列表(主节点在前,3台从节点在后,固定4台)

NODES=("192.168.1.10" "192.168.1.11" "192.168.1.12" "192.168.1.13")

# 每个节点的GPU数量(单台8卡,无需修改)

GPUS_PER_NODE=8

# 总GPU数量(4台×8卡=32,固定)

TOTAL_GPUS=${#NODES[@]}×$GPUS_PER_NODE

# 启动多机多卡级联服务(前台调试,无异常后改为后台启动,适配RoCE通信)

mpirun -np $TOTAL_GPUS \

--allow-run-as-root \

--host ${NODES[*]} \

--map-by node \

--mca btl_tcp_if_include 192.168.1.0/24 \ # 适配本地网段,避免通信异常

--mca btl_openib_allow_ib 1 \ # 启用RoCE通信优化

vllm serve /data/storage/ds-v4-pro/DeepSeek-V4-PRO \ # 模型路径(全闪存储共享)

--tensor-parallel-size $GPUS_PER_NODE \ # 单节点张量并行数(8卡)

--pipeline-parallel-size ${#NODES[@]} \ # 流水线并行数(4台节点)

--max-model-len 16384 \ # 适配DeepSeek-V4-PRO长文本推理

--npu-memory-utilization 0.8 \ # 显存利用率,4台级联建议0.75-0.85

--port 8000 \ # 主节点推理接口端口

--host 0.0.0.0 \ # 允许外部访问

--enable-moe-optimization \ # 开启MoE优化

--disable-log-requests # 关闭请求日志(生产环境可开启) |

脚本权限配置:

|

bash

chmod +x /root/ds-v4-pro-start.sh |

3.4 多机级联启动与验证(主节点执行)

1. 前台调试启动:先以前台模式启动,验证主从节点通信(适配RoCE交换机)、全闪存储访问、服务启动情况,无报错再切换至后台常驻。

|

bash

/root/ds-v4-pro-start.sh |

启动成功标志:所有节点日志输出“Started server process [xxxx]”“Uvicorn running on http://0.0.0.0:8000”,无“通信超时”“算子报错”“显存溢出”“存储访问失败”等信息;RoCE交换机日志无丢包、延迟过高提示;主节点可正常访问全闪存储模型文件。

2. 后台常驻启动(生产环境):修改启动脚本,添加nohup命令,将日志输出至指定目录,确保服务后台稳定运行。

|

bash

# 1. 创建日志目录(所有节点统一路径,本地存储,避免占用全闪存储)

mkdir -p /data/logs/ds-v4-pro

chmod 777 /data/logs/ds-v4-pro

# 2. 后台启动脚本(主节点执行)

nohup /root/ds-v4-pro-start.sh > /data/logs/ds-v4-pro/run.log 2>&1 &

# 3. 验证服务启动成功(主节点查看进程)

ps -ef | grep vllm | grep -v grep

# 4. 查看日志,确认无异常(重点查看RoCE通信、全闪存储访问情况)

tail -f /data/logs/ds-v4-pro/run.log |

3. 多机通信+RoCE+全闪存储联合验证:在主节点执行curl命令,验证模型推理功能正常,且4台服务器协同工作、RoCE通信正常、全闪存储读取正常。

|

bash

curl http://192.168.1.10:8000/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "DeepSeek-V4-PRO",

"messages": [

{"role": "user", "content": "详细介绍昇腾910B多机多卡级联(4台)+RoCE交换机+全闪存储的部署优势"}

],

"temperature": 0.7,

"max_tokens": 1024,

"top_p": 0.9

}' |

验证要点:

- 响应速度≤2s,输出内容准确流畅,无报错信息;

- 所有从节点查看日志,确认从节点参与计算(日志有“forward pass”相关输出);

- RoCE交换机查看端口状态,确认无丢包、延迟≤1ms;

- 主从节点查看全闪存储挂载状态,确认模型文件可正常读取。

四、大EP架构配置(优化提升,适配4台服务器场景)

4.1 大EP架构说明

大EP(Extended Processing)架构是昇腾910B针对大参数量模型优化的一种扩展处理模式,通过扩展处理单元、优化任务调度和数据传输,减少多机多卡间的通信开销,提升模型推理的吞吐量和并发能力,尤其适配DeepSeek-V4-PRO这类大参数量、高并发需求的模型;结合4台服务器+RoCE交换机的硬件配置,大EP架构可进一步优化流水线并行效率,降低通信延迟,提升整体推理性能。

大EP架构配置需基于多机多卡级联基础,无需额外硬件改造,仅通过软件参数配置即可启用,适配全闪存储的共享存储模式。

4.2 大EP架构参数配置(所有节点执行)

修改环境变量,添加大EP架构相关配置,优化任务调度和通信效率,适配4台服务器的并行策略,所有节点配置需完全一致。

|

bash

# 1. 添加大EP架构环境变量(永久生效)

echo "export ASCEND_ENABLE_EXTENDED_PROCESSING=1" >> ~/.bashrc # 开启大EP架构

echo "export ASCEND_EP_PARALLEL_LEVEL=4" >> ~/.bashrc # EP并行级别(与节点数一致,4节点设为4)

echo "export ASCEND_EP_TASK_SCHEDULE_MODE=1" >> ~/.bashrc # 任务调度模式(1为优化模式)

echo "export ASCEND_EP_DATA_TRANSFER_OPTIMIZE=1" >> ~/.bashrc # 开启数据传输优化(适配RoCE)

# 2. 生效环境变量

source ~/.bashrc |

4.3 大EP架构启动与优化(主节点执行)

1. 修改多机级联启动脚本,添加大EP相关启动参数,优化推理性能,适配4台服务器+RoCE交换机配置:

|

bash

# 编辑启动脚本

vim /root/ds-v4-pro-start.sh

# 在vllm serve命令后添加以下参数

--enable-extended-processing \ # 开启大EP优化

--ep-parallel-level 4 \ # 与ASCEND_EP_PARALLEL_LEVEL一致(4节点)

--ep-task-schedule-mode 1 |

2. 重启服务,使大EP配置生效:

|

bash

# 停止原有服务

ps -ef | grep vllm | grep -v grep | awk '{print $2}' | xargs kill -9

# 后台重启服务

nohup /root/ds-v4-pro-start.sh > /data/logs/ds-v4-pro/run.log 2>&1 &

# 查看日志,确认大EP架构启用成功(日志含“Extended Processing enabled”)

tail -f /data/logs/ds-v4-pro/run.log |

3. 大EP架构性能优化建议(适配4台服务器+RoCE+全闪存储):

(1)EP并行级别固定为4,与服务器节点数一致,不可修改;

(2)若出现RoCE通信延迟过高,可调整ASCEND_EP_DATA_TRANSFER_OPTIMIZE=2,进一步优化数据传输,同时检查RoCE交换机端口速率和配置;

(3)显存压力较大时,可降低npu-memory-utilization至0.75,同时开启显存碎片整理(添加--enable-memory-fragmentation-reduction参数);

(4)高并发场景下,可调整--max-num-batched-tokens参数(推荐设为16384),提升批处理效率,充分利用4台服务器的算力;

(5)全闪存储读写优化:若模型读取速度较慢,可调整全闪存储缓存策略(在存储管理界面开启读写缓存),同时检查iSCSI挂载参数,确保无性能瓶颈。

五、功能验证与性能测试(4台服务器+RoCE+全闪存储场景)

5.1 基础功能验证

1. 接口调用验证:主节点执行curl命令,验证模型推理、多轮对话、长文本处理等核心功能正常,同时验证全闪存储读取、RoCE通信正常。

|

bash

# 多轮对话验证

curl http://192.168.1.10:8000/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "DeepSeek-V4-PRO",

"messages": [

{"role": "user", "content": "什么是昇腾910B多机多卡级联(4台)+RoCE交换机+全闪存储的部署模式?"},

{"role": "assistant", "content": "该部署模式是指将4台昇腾910B单机8卡服务器通过RoCE交换机实现高速互联,外接全闪存储提供共享存储,协同完成DeepSeek-V4-PRO模型推理任务的分布式部署方式,RoCE交换机降低多机通信延迟,全闪存储实现模型权重共享,4台服务器通过混合并行策略充分发挥算力优势,适配高并发、大参数量模型的推理需求。"},

{"role": "user", "content": "它与2台服务器部署相比,优势在哪里?"}

],

"temperature": 0.7,

"max_tokens": 1024,

"top_p": 0.9

}' |

2. 故障转移验证(可选):手动停止某一台从节点的vllm进程,验证主节点是否能自动调整任务分配,服务不中断(需开启容错机制,添加--enable-fault-tolerance参数);同时验证全闪存储仍可被其他节点正常访问,RoCE交换机自动调整通信路径。

3. RoCE通信与全闪存储单独验证:

|

bash

# RoCE通信验证(主节点与所有从节点互测带宽)

iperf3 -c 192.168.1.11 -t 10 # 主节点测从节点1

iperf3 -c 192.168.1.12 -t 10 # 主节点测从节点2

iperf3 -c 192.168.1.13 -t 10 # 主节点测从节点3

# 全闪存储读写验证(所有节点执行,测试读写速度)

dd if=/dev/zero of=/data/storage/ds-v4-pro/test.file bs=1G count=1 oflag=direct # 写测试

dd if=/data/storage/ds-v4-pro/test.file of=/dev/null bs=1G count=1 iflag=direct # 读测试

rm -rf /data/storage/ds-v4-pro/test.file # 删除测试文件 |

5.2 性能测试

针对4台服务器+RoCE交换机+全闪存储+大EP架构,测试核心性能指标,确保满足生产环境需求,测试工具推荐使用ab、locust等。

|

bash

# 1. 并发性能测试(模拟50-60并发请求,测试吞吐量,适配4台服务器算力)

ab -n 200 -c 50 -T application/json -p request.json http://192.168.1.10:8000/v1/chat/completions

# (request.json为请求体文件,内容与上述curl命令的-d参数一致)

# 2. 显存与CPU占用测试(主从节点均执行)

# 查看NPU显存占用(单卡应低于55GB)

npu-smi info --query-gpu=memory.used,memory.total --format=csv

# 查看CPU占用率

top -p $(ps -ef | grep vllm | grep -v grep | awk '{print $2}')

# 3. 响应速度测试(统计首包响应时间和平均响应时间)

curl -w "首包响应时间: %{time_starttransfer}s\n总响应时间: %{time_total}s\n" -H "Content-Type: application/json" -d @request.json http://192.168.1.10:8000/v1/chat/completions

# 4. RoCE通信延迟测试(主节点执行)

ping 192.168.1.11 -c 10 | grep avg # 延迟应≤1ms

ping 192.168.1.12 -c 10 | grep avg

ping 192.168.1.13 -c 10 | grep avg

# 5. 全闪存储读写性能测试(主节点执行)

fio --name=read_test --filename=/data/storage/ds-v4-pro/test.fio --rw=read --bs=1G --size=10G --direct=1 --iodepth=8 --group_reporting

fio --name=write_test --filename=/data/storage/ds-v4-pro/test.fio --rw=write --bs=1G --size=10G --direct=1 --iodepth=8 --group_reporting

rm -rf /data/storage/ds-v4-pro/test.fio |

性能达标标准(4台8卡+RoCE+全闪存储+大EP架构):

(1)并发能力:支持50-60并发请求,无报错、无卡顿;

(2)响应速度:首包响应时间≤1.5s,平均响应时间≤4s;

(3)显存占用:单卡显存占用≤55GB,无显存溢出;

(4)吞吐量:≥80 token/s(单并发),并发越高,吞吐量提升越明显;

(5)RoCE通信:延迟≤1ms,带宽≥100Gbps,无丢包;

(6)全闪存储:读速度≥1GB/s,写速度≥800MB/s,无读写异常。

六、全流程注意事项(新增RoCE交换机、全闪存储相关)

6.1 部署前注意事项

1. 硬件一致性:所有4台服务器需为同型号、同配置的昇腾910B服务器,RoCE网卡型号一致;RoCE交换机带宽≥100Gbps,支持RoCE v2协议;全闪存储支持iSCSI协议,容量≥1.2TB,避免硬件差异导致通信或存储异常。

2. 软件版本统一:所有服务器的CANN、昇腾驱动、Python、核心依赖版本必须完全一致;RoCE交换机固件版本需支持RoCE v2协议;全闪存储固件版本需支持iSCSI协议优化,否则会出现兼容性问题。

3. 网络检查:确保服务器、RoCE交换机、全闪存储处于同一网段,无防火墙拦截通信端口(29500-29510、8000、3260等);RoCE交换机端口与服务器RoCE网卡端口速率匹配(均设为100Gbps);测试网络延迟和带宽,确保满足部署要求。

4. 存储检查:全闪存储需提前创建存储池、LUN、iSCSI目标器,确保存储空间充足;验证所有服务器可正常发现并登录iSCSI目标器,避免存储挂载失败。

5. 备份准备:部署前备份所有服务器的环境配置、启动脚本,备份RoCE交换机、全闪存储的配置文件,避免操作失误导致环境或设备损坏。

6. 权限确认:所有服务器必须具备root/sudo权限;RoCE交换机、全闪存储需具备管理员权限,便于配置网络和存储参数。

6.2 部署中注意事项

1. 路径统一:所有服务器的虚拟环境路径、模型路径(全闪存储挂载路径)、日志路径、启动脚本路径必须完全一致,否则会导致多机级联失败或存储访问异常。

2. 环境变量配置:所有节点的环境变量(尤其是MASTER_ADDR、MASTER_PORT、WORLD_SIZE、RoCE相关配置)必须统一;大EP架构的EP并行级别需与服务器节点数(4台)一致,避免通信异常。

3. 启动顺序:先配置RoCE交换机、全闪存储,再配置所有服务器的软件环境、挂载全闪存储,最后在主节点执行启动脚本,不可单独启动某一台节点。

4. 报错处理:

- 通信超时:检查服务器间网络、SSH免密登录,RoCE交换机配置及端口状态;

- 算子报错:检查CANN版本及依赖版本;

- 显存溢出:降低显存利用率或调整并行策略;

- 存储访问失败:检查全闪存储挂载状态、iSCSI服务、存储配置;

- RoCE通信异常:检查RoCE网卡驱动、环境变量配置、交换机端口速率。

5. 前台调试:建议先以前台模式启动,确认无异常后再切换至后台常驻,便于排查启动过程中的问题(重点排查RoCE通信、全闪存储访问问题)。

6.3 部署后注意事项

1. 性能监控:接入Prometheus + Grafana监控所有节点的NPU显存、CPU、内存占用,RoCE交换机的端口状态、延迟、带宽,全闪存储的读写速度、空间占用,设置告警阈值,及时发现异常。

2. 日志管理:定期清理服务器日志目录(/data/logs/ds-v4-pro),避免占用过多本地存储空间;定期备份RoCE交换机、全闪存储的日志,便于故障排查。

3. 权限管控:限制全闪存储挂载目录、模型目录、日志目录、启动脚本的访问权限,仅授权用户可读写;限制RoCE交换机、全闪存储的管理员权限,避免误操作。

4. 版本固化:锁定核心依赖版本、RoCE交换机固件版本、全闪存储固件版本,避免后续升级导致兼容性问题,若需升级,需先在测试环境验证。

5. 冗余备份:部署后7天内,保留模型权重(全闪存储内备份)、环境配置、设备配置的备份,若出现服务异常,可快速回滚;定期备份全闪存储内的模型权重,避免数据丢失。

6. 定期维护:每周检查一次服务器硬件状态、RoCE交换机端口状态、全闪存储状态;每月测试一次RoCE通信带宽、全闪存储读写速度;每季度升级一次核心依赖和设备固件(需测试验证)。

6.4 常见故障排查(新增RoCE、全闪存储相关)

1. 多机通信失败:检查MASTER_ADDR、MASTER_PORT配置是否正确,服务器间SSH免密登录是否正常;检查RoCE交换机配置、端口状态,RoCE网卡驱动是否正常,环境变量中RoCE相关配置是否正确。

2. 启动时报“MoE operator not found”:检查ASCEND_ENABLE_MOE_OPTIMIZE环境变量是否设为1,vllm-ascend版本是否≥0.15.0。

3. 显存溢出(OOM error):检查所有节点的vllm进程是否完全停止,降低npu-memory-utilization参数,缩短max-model-len,或调整并行策略。

4. 大EP架构启用失败:检查ASCEND_ENABLE_EXTENDED_PROCESSING环境变量是否设为1,EP并行级别是否与节点数(4台)一致。

5. 响应速度慢、吞吐量低:检查RoCE通信延迟是否过高,大EP配置是否优化,并行参数是否合理;检查全闪存储读写速度,是否存在存储瓶颈;可调整OMP_NUM_THREADS、max-num-batched-tokens参数。

6. 服务崩溃:查看日志排查具体报错,若为依赖冲突,重新安装指定版本依赖;若为硬件故障,检查NPU状态、服务器散热;若为RoCE通信异常,重启RoCE交换机;若为存储异常,检查全闪存储状态。

7. 全闪存储挂载失败/读写异常:检查iSCSI服务是否正常运行,iSCSI目标器。

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)