2026年大模型技术全景演进:核心突破、落地范式与未来深水区

全栈国产化方案,从底层的昇腾 / 海光/后摩/此芯等算力芯片,到中间层的飞腾 / 鲲鹏服务器、麒麟操作系统,再到框架层的 MindSpore/PaddlePaddle 深度学习框架,再到模型层的国产开源 / 商用大模型,最后到应用层的行业场景解决方案,实现了全链路的自主可控,完全满足企业的等保 2.0、数据安全、合规管理的要求,已经成为政府与央企 AI 应用落地的首选方案。尽管大模型的训练与推理成

2026 年,大模型行业正式告别了 “参数军备竞赛” 的野蛮生长期,进入了技术深耕 + 价值落地的成熟拐点。从 2023 年通用大模型的爆发,到 2024-2025 年垂类大模型的遍地开花,再到 2026 年全栈技术的边端化成熟、企业级规模化落地的全面铺开,大模型已经从一个 “技术概念” 真正变成了驱动千行百业数字化转型的核心生产力。

AI的快速演进和发展,我们不再需要争论 “大模型是不是泡沫”,而是要直面三个核心问题:2026 年大模型技术到底有哪些真正的突破性进展?哪些技术已经从论文走向边端化落地?未来的技术深水区在哪里,我们该如何布局?

本文将基于 2026 年国内大模型行业的最新实践,从核心技术突破、边端化落地范式、现存挑战与未来预判四个维度进行拆解。

一、2026 年大模型核心技术的突破性进展

2026年的大模型技术,不再是单一维度的参数规模升级,而是架构创新、工程化优化、场景适配、安全合规四大方向的协同突破,核心是解决 “好用、低成本、可落地、高可控” 四大核心痛点。

1. 基座架构:从 Transformer 一统天下,到混合架构的边端化落地

过去三年,Transformer 架构始终是大模型的绝对主流,但长上下文效率低、算力开销大的原生痛点,始终制约着其在边端场景的规模化落地。2026 年,架构层面最大的变化,是Transformer 与状态空间模型(SSM)的混合架构完成了从论文到边端化的全面跃迁,成为行业基座模型的新标配。

SSM 架构的成熟化应用:以 Mamba2 为代表的 SSM 架构,解决了初代 Mamba 的训练不稳定、长上下文语义丢失问题,在时序数据、长文档、视频流等场景,实现了线性复杂度的推理与训练。在能源场站时序监测、高速公路长时序视频分析等边端场景,纯 SSM 架构的推理速度是同规模 Transformer 的 8-10 倍,显存占用降低 70%,完美适配实时性要求高的边缘场景。

Transformer+SSM 混合架构成为主流:头部厂商均推出了混合架构基座 —— 注意力层负责短上下文语义理解与指令遵循,SSM 层负责长上下文建模与时序信息处理,兼顾了通用能力与效率。比如国内主流的部分开源混合模型,在 128K 上下文窗口下,推理速度比纯 Transformer 模型提升 3 倍,内存占用降低 50%,同时保持了 95% 以上的通用能力,成为企业二次开发的首选基座。

稀疏激活架构的边端化成熟:MoE(混合专家模型)彻底告别了 “参数虚标、利用率低” 的困境,通过专家路由优化、动态专家激活、负载均衡算法的迭代,实现了 “激活参数规模不变,总参数规模提升 10 倍” 的能力跃升。2026 年国内主流的千亿级 MoE 模型,激活参数仅 30B 左右,训练与推理成本与 30B 稠密模型持平,但通用能力与垂类适配能力远超同规模稠密模型,成为能源、交通、制造等行业垂类大模型的核心基座。

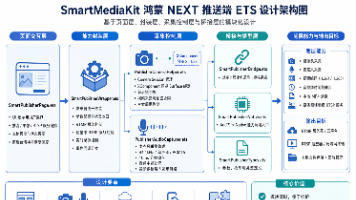

2. 推理优化:从 “极致压缩” 到 “全链路效率最优”,国产化适配成为核心赛道

推理优化始终是大模型落地的核心环节,2026 年的推理技术,已经从单一的量化压缩,升级为模型架构 - 算子优化 - 算力调度 - 硬件适配的全链路优化,同时国产算力的推理适配完成了从 “可用” 到 “好用” 的全面跨越。

KV 缓存技术的革命性迭代:针对长上下文推理的核心瓶颈 KV 缓存,2026 年出现了两大成熟方案:一是动态稀疏 KV 缓存,通过注意力权重的动态筛选,仅保留核心语义的 KV 向量,在 128K 长文档场景下,缓存内存占用降低 70%,推理精度损失小于 1%;二是量化感知的 KV 压缩,结合 4bit/2bit 量化与结构化压缩,在国产 NPU 上实现了无损压缩,完美适配企业合同审核、合规文档分析等长文本场景。

投机解码的边端化进阶:初代投机解码的准确率低、加速比有限的问题被彻底解决,多步自洽投机解码成为行业标配,通过小模型的多步预生成 + 大模型的一致性校验,在无损精度的前提下,实现了 2-4 倍的推理加速,同时适配了国产算力平台,解决了之前投机解码在国产芯片上适配难的问题。

国产算力的全链路推理优化:2026 年,针对昇腾、海光、寒武纪、后摩等国产算力平台的算子优化、图编译、推理框架已经完全成熟,头部厂商实现了 “一次开发,多硬件适配” 的跨平台推理方案。在省属企业等强合规场景,全栈国产化的推理方案已经成为标配,边端模型在国产芯片上的推理性能,已经达到同级别英伟达 GPU 的 85% 以上,完全满足企业级落地需求。

端侧推理的无损落地:针对边缘巡检、智能终端等场景,2bit/1.5bit 量化技术实现了边端化落地,在精度损失小于 2% 的前提下,可在端侧芯片上实现实时推理,端云协同的部署范式彻底成熟,完美适配能源场站无人巡检、高速公路路况识别等边缘场景。

3. 微调技术:从 “算法 demo” 到 “边端化生产流水线”

2026 年,大模型微调技术彻底告别了 “调参炼丹” 的作坊式模式,形成了标准化、自动化、低成本的边端化微调范式,解决了垂类场景适配的核心痛点。

低成本对齐技术的全面成熟:RLHF 的高成本、高复杂度问题被彻底解决,DPO/IPO/RLOO等直接偏好优化算法成为行业标配,对齐成本降低 90% 以上,同时对齐效果远超传统 RLHF。针对企业合规、安全生产等强管控场景,轻量化对齐技术可实现 “行业合规规则” 的快速注入,模型输出的合规率提升至 99.9% 以上。

领域自适应微调的自动化体系:针对行业垂类场景,形成了 “数据清洗 - 数据格式化 - 微调策略选择 - 效果评估 - 模型迭代” 的全自动化流水线。Auto-Tuning 框架可基于行业数据的特点,自动选择最优的微调方案(全参数微调 / LoRA/QLoRA/ 适配器微调),自动调优超参数,自动完成效果评估,将垂类模型的微调周期从月级压缩至天级,完美适配省属企业多板块、多场景的模型适配需求。

持续学习技术的边端化突破:针对模型落地后的迭代需求,灾难性遗忘问题得到了有效解决。通过增量微调、多任务提示学习、专家适配器隔离等技术,实现了模型的持续迭代,在新增行业场景能力的同时,不损失原有通用能力与指令遵循能力,解决了企业模型 “越迭代越难用” 的核心痛点。

4. 多模态大模型:从 “图文拼接” 到 “原生统一表征” 的全场景渗透

2026 年,多模态大模型彻底告别了 “文本基座 + 视觉编码器” 的拼接模式,原生统一多模态架构成为主流,实现了文本、图像、视频、音频、时序传感器数据的统一表征与跨模态理解,成为边端场景落地的核心抓手。

统一多模态基座的成熟化:头部厂商推出的原生多模态模型,通过统一的 Transformer/SSM 混合架构,实现了所有模态的统一编码与解码,跨模态理解能力实现了质的跃升。在边端巡检场景,可同时融合红外热成像、设备声音、传感器时序数据、现场视频,实现设备缺陷的精准识别与根因分析,综合识别准确率超过 98%,远超单模态模型。

边端级多模态生成技术的落地:视频生成技术突破了长时序一致性的瓶颈,可生成 10 分钟以上的高一致性边端仿真视频、培训视频;3D 生成技术与边端设计软件深度打通,可基于文本描述直接生成边端零件的 3D 模型,适配高端制造、建筑设计等场景,设计效率提升 5 倍以上。

端侧多模态小模型的规模化应用:针对边缘场景的端侧多模态模型,实现了 “视觉 - 语音 - 文本” 的端侧实时推理,在巡检机器人、车载终端等设备上实现了规模化落地,无需云端交互即可完成现场缺陷识别、语音指令交互、实时预警,解决了边端场景网络受限的核心痛点。

5. 安全与合规:从 “事后补丁” 到 “原生融入” 的全生命周期管控

针对企业、政务等强合规场景,2026 年大模型的安全技术,已经从 “事后内容审核” 升级为数据安全 - 模型安全 - 输出安全 - 合规审计的全生命周期管控体系,成为大模型落地的前置条件。

隐私计算与大模型的深度融合:联邦学习、同态加密与大模型的结合技术完全成熟,实现了 “数据不出域、模型共迭代” 的合规方案。针对集团企业多子公司、多板块的特点,可通过联邦微调,在各子公司数据不离开本地的前提下,联合训练集团级的行业大模型,完全符合《数据安全法》《个人信息保护法》的要求。

模型可解释性的突破性进展:针对边端生产、风控审计等关键场景,黑盒模型的归因分析技术实现了边端化落地,可精准追溯模型输出的决策依据,定位关键输入特征,解决了 “模型为什么这么输出” 的核心问题,为关键场景的模型应用提供了可解释性支撑。

合规对齐的原生融入:将行业合规规则、安全生产规范、企业管理制度,通过规则注入、偏好对齐、可控生成等技术,原生融入模型的训练与推理过程,实现了模型输出的事前管控,而非事后审核,合规输出率达到 99.9% 以上,满足企业等强监管场景的需求。

二、2026 年大模型落地的核心范式:从 POC 到规模化复制

2026 年,大模型的落地已经从 “单点 POC 验证” 进入了 “规模化、标准化复制” 的阶段,尤其是在能源、交通、制造、农业等省属企业核心赛道,已经形成了可复制、高价值的落地范式。

1. 行业垂类大模型的边端化生产范式

当前行业落地的核心共识是:通用大模型无法直接解决行业核心痛点,垂类大模型才是规模化落地的核心载体。2026 年,行业垂类大模型已经形成了标准化的生产范式:

1)基座选型:基于行业场景的需求,选择适配的开源 / 商用基座,边端场景优先选择混合架构、长上下文、多模态能力强的基座,办公场景优先选择指令遵循、合规对齐能力强的基座;

2)领域预训练:基于行业积累的海量文档、规程、案例、数据,进行领域自适应持续预训练,注入行业知识,解决通用大模型 “行业知识不足、专业输出错误” 的痛点;

3)场景微调:针对具体业务场景(如锅炉燃烧优化、设备缺陷识别、合规风控),用场景化的指令数据进行微调,让模型适配具体的业务流程与输出要求;

4)合规对齐:针对企业的合规要求、管理制度,进行对齐优化,确保模型输出的合规性、安全性;

5)部署与迭代:基于场景需求,选择云端 / 端侧 / 端云协同的部署方案,搭建持续迭代的闭环体系,基于业务反馈持续优化模型。

2. 端云协同的部署范式:兼顾能力与实时性

2026 年,端云协同已经成为边端场景大模型部署的绝对主流范式,完美解决了 “云端模型能力强但实时性不足,端侧模型实时性强但能力有限” 的矛盾:

云端大模型:负责模型训练、复杂推理、根因分析、决策优化、全局调度,比如能源集团的总部云端,部署千亿级 MoE 行业大模型,负责全集团的设备数据分析、生产策略优化、风险全局预警;

边缘 / 端侧小模型:负责实时数据采集、现场推理、实时预警、本地控制,比如场站的巡检机器人、车间的边缘网关,部署轻量化多模态小模型,实现现场设备缺陷的实时识别、异常工况的即时预警,无需云端交互即可完成闭环处置;

云边端一体化协同:云端大模型持续基于全集团的数据迭代优化,定期将能力蒸馏到端侧小模型,实现端侧模型的持续升级;端侧采集的现场数据,同步回传云端,为大模型迭代提供数据支撑,形成 “数据 - 模型 - 应用 - 反馈” 的全闭环。

3. 企业级 AI Agent:从 “玩具” 到 “生产系统核心中枢”

2026 年,AI Agent 彻底告别了 “聊天机器人” 的定位,成为企业级生产系统的核心中枢,多智能体协同的范式已经在企业的办公、生产、风控等场景实现了规模化落地。

办公场景:企业内部的智能办公 Agent,可实现公文起草、合同审核、会议纪要生成、档案检索、流程审批的全流程自动化,同时对接企业的 ERP、OA、财务系统,实现跨系统的任务执行,综合办公效率提升 60% 以上;

生产场景:多智能体协同系统,覆盖生产管控 Agent、设备运维 Agent、安全管控 Agent、环保排放 Agent,各 Agent 之间实现信息共享、协同决策,实现生产全流程的智能管控。比如垃圾焚烧厂的多 Agent 系统,可实现燃烧优化、设备巡检、环保排放、应急处置的全流程自主协同,无需人工干预,实现少人化值守;

风控场景:合规风控 Agent,可实时对接企业的采购、投资、财务、贸易系统,7×24 小时监测风险点,自动识别违规采购、利益输送、财务异常、贸易风险,实现风控从 “事后审计” 向 “事前预警、事中管控” 的升级。

4. 全栈国产化落地范式:合规优先,自主可控

针对国有企业、政务等强合规场景,2026 年已经形成了“国产算力 - 国产框架 - 国产大模型 - 国产应用”的全栈国产化落地范式,彻底解决了 “卡脖子” 与合规风险问题。

全栈国产化方案,从底层的昇腾 / 海光/后摩/此芯等算力芯片,到中间层的飞腾 / 鲲鹏服务器、麒麟操作系统,再到框架层的 MindSpore/PaddlePaddle 深度学习框架,再到模型层的国产开源 / 商用大模型,最后到应用层的行业场景解决方案,实现了全链路的自主可控,完全满足企业的等保 2.0、数据安全、合规管理的要求,已经成为政府与央企 AI 应用落地的首选方案。

三、2026 年大模型技术的深水区与核心挑战

尽管大模型技术逐步在边端化场景落地,但我们必须清醒地认识到,行业仍面临着多个核心挑战,这些也是未来技术突破的核心方向。

1. 边端场景的 “确定性” 需求与大模型 “概率性输出” 的核心矛盾

边端生产、安全生产、风控审计等核心场景,对模型输出的确定性、可靠性、可重复性要求极高,而大模型的概率性生成特性,导致其存在 “幻觉”、输出不稳定的原生问题。尽管通过对齐优化、规则约束可以大幅降低幻觉率,但无法 100% 消除,这也是大模型无法进入核心生产控制环节的核心障碍。

2. 行业高质量数据的稀缺性,制约垂类模型的效果上限

大模型的效果上限,最终由数据的质量决定。当前企业等传统行业,普遍存在数据治理薄弱的问题:行业数据分散在各个子公司、各个系统,数据标准不统一,结构化数据占比低,高质量标注数据稀缺,大量的行业知识沉淀在老师傅的经验里,无法转化为模型可学习的数字化资产。数据治理的成本高、周期长,已经成为制约垂类大模型规模化落地的核心瓶颈。

3. 算力成本与落地价值的平衡难题

尽管大模型的训练与推理成本已经大幅降低,但千亿级模型的训练、长上下文多模态模型的推理,仍需要极高的算力投入。对于很多传统企业而言,算力投入的 ROI(投资回报率)仍不清晰,很多场景的 POC 验证效果很好,但规模化落地后,算力成本远超人工替代的成本,导致无法持续运营。如何进一步降低算力成本,提升大模型的落地价值,仍是行业需要解决的核心问题。

4. 模型的持续迭代与运维体系的缺失

大模型不是 “一次训练、终身使用” 的产品,而是需要基于业务数据的变化、场景的拓展,持续迭代优化。当前很多企业的大模型应用,仍停留在 “一次部署、一劳永逸” 的误区,缺乏完善的模型迭代、运维、监控体系,导致模型上线后,效果随着业务变化持续下降,最终沦为 “摆设”。如何构建企业级的大模型 Ops 体系,实现模型的全生命周期管理,是规模化落地必须解决的问题。

四、未来3年大模型技术的演进预判

基于 2026 年的技术现状与行业需求,未来3年,大模型技术将沿着“更高效、更确定、更普惠、更自主可控” 的方向持续演进,核心突破将集中在以下几个方向:

1、架构创新将持续突破,混合架构成为绝对主流:Transformer 与 SSM 的混合架构将彻底替代纯 Transformer 架构,成为基座模型的标配;针对端侧场景的原生轻量化架构将迎来爆发,端侧模型的能力将不断逼近当前云端部分模型的水平,实现 “端侧即可用” 的普惠化。

2、全栈国产化将全面成熟,实现对国外方案的替代:国产算力、国产框架、国产大模型的协同优化将持续深化,未来3年,国产方案的性能将全面追赶国外主流方案,在企业、政务、边端等关键场景,实现对国外方案的全面替代,自主可控成为大模型落地的核心前提。

3、物理世界建模将成为核心赛道,大模型与边端场景深度融合:多模态大模型将突破数字内容的边界,实现对物理世界的精准建模,与数字孪生、边端仿真、机器人技术深度融合,成为边端生产、智能制造的核心中枢,真正实现 “AI 驱动的智能制造”。

4、AI Agent 将实现全场景渗透,多智能体协同成为常态:企业级 AI Agent 将从单一任务执行,升级为多智能体的全域协同,覆盖企业的生产、办公、风控、供应链等全流程,大模型将从 “工具” 变成 “企业数字化系统的核心操作系统”。

5、模型的确定性与可解释性将实现突破性进展:针对边端场景的确定性需求,可解释 AI、因果推理与大模型的融合将实现突破,解决大模型的幻觉与黑盒问题,让大模型真正进入核心生产控制环节,实现从 “辅助决策” 到 “自主控制” 的跃迁。

五、AI数字化方案落地建议

作为身处技术浪潮中的数字化转型企业,面对大模型技术的快速迭代,我们需要跳出 “算法调参” 的局限,构建更全面的能力体系,抓住行业落地的核心机遇:

1、深耕行业场景,理解业务本质:大模型的价值最终要通过业务落地来体现,只懂算法不懂业务,永远只能做 “demo 工程师”。建议大家聚焦 1-2 个自己行业的业务场景,深入理解行业的业务流程、核心痛点、合规要求,把算法技术与行业需求深度结合。

2、聚焦工程化能力,构建全链路技术视野:大模型已经从算法研究阶段进入工程化落地阶段,只会模型训练与微调远远不够。建议有条件的企业全面掌握数据治理、模型训练、推理优化、硬件适配、部署落地、运维监控的全链路技术,尤其是国产算力平台的适配与优化能力,这将是未来3-5年行业最稀缺的核心能力。

3、重视安全与合规,守住技术落地的底线:尤其是在企业、政务、边端等强监管场景,安全与合规是大模型落地的前置条件。建议大家深入学习数据安全、隐私保护、行业合规的相关要求,把安全合规融入到模型开发的全流程,而不是事后补补丁。

4、保持技术敏感度,但拒绝盲目追新:大模型技术迭代速度极快,每天都有新的论文、新的模型出现。我们需要保持对新技术的敏感度,但更要学会区分 “论文噱头” 与 “可落地的技术”,聚焦能真正解决行业痛点、实现边端化落地的技术,不要陷入 “为了追新而追新” 的误区。

2026 年,大模型行业已经进入了 “深水区”,不再有一夜暴富的神话,只有脚踏实地的技术深耕与业务落地。我们既是技术的创造者,也是行业落地的践行者,唯有扎根场景、深耕技术、坚守合规,才能在这一波技术浪潮中,创造真正的长期价值。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)