AI自动化工具Midscene重要更新:鸿蒙、PC端全覆盖,新增模型、Skills及报告解析能力

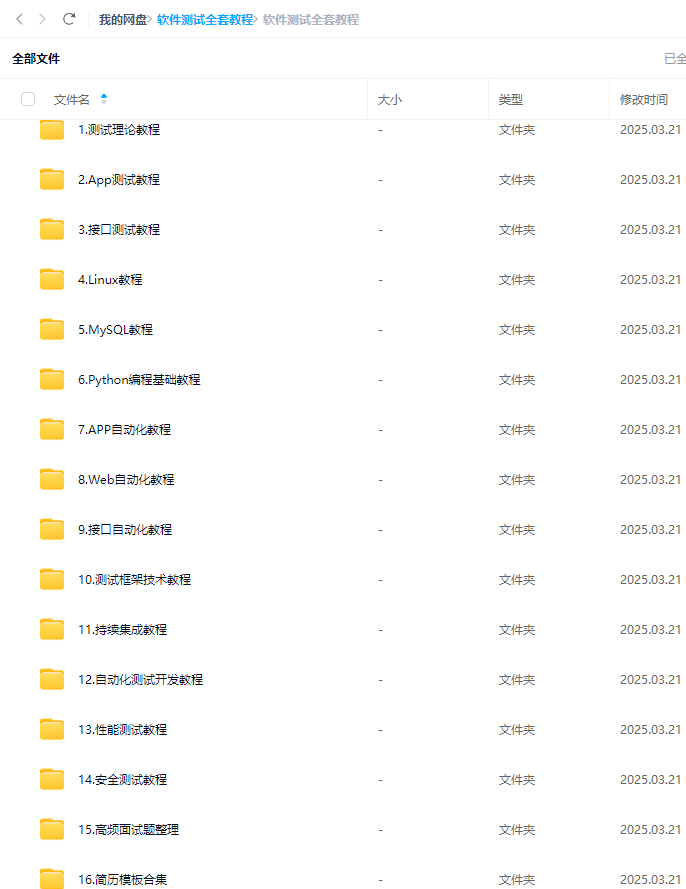

下方这份完整的软件测试视频教程已经整理上传完成,需要的朋友们可以自行领取。

📝 面试求职: 「面试试题小程序」 ,内容涵盖 测试基础、Linux操作系统、MySQL数据库、Web功能测试、接口测试、APPium移动端测试、Python知识、Selenium自动化测试相关、性能测试、性能测试、计算机网络知识、Jmeter、HR面试,命中率杠杠的。(大家刷起来…)

📝 职场经验干货:

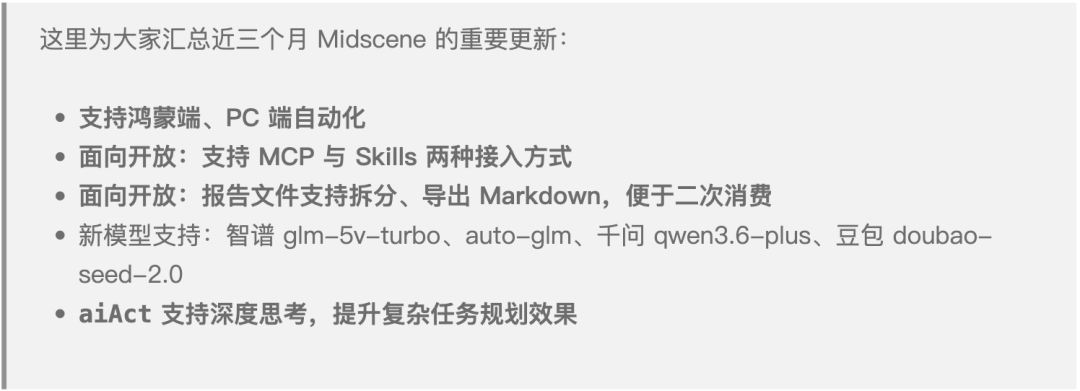

2026年4月16日,字节跳动 Web Infra 团队开源的AI视觉驱动跨端UI自动化工具 Midscene发布近三月核心更新,正式实现桌面端、HarmonyOS(鸿蒙)、iOS、Android全设备统一自动化覆盖,并同步开放 MCP/Skills 双生态接入、升级报告解析能力、扩充主流视觉大模型支持、强化aiAct深度思考能力,全面破解传统跨端自动化设备割裂、适配繁琐、生态封闭、复杂任务难落地的行业痛点。

PC+鸿蒙正式接入,统一接口覆盖多系统

本次更新最核心突破是新增 PC 桌面端与鸿蒙(HarmonyOS)端自动化支持,结合已有的 iOS、Android 能力,Midscene 已经形成一套覆盖桌面端与多移动平台的统一自动化路径。

PC自动化:自动发推

鸿蒙自动化:查看电池健康

1. PC 端自动化:全面支持三大系统,零代码+脚本双模式

系统覆盖:支持 Windows、macOS、Linux 三大桌面操作系统,可以驱动原生键盘与鼠标,操作任意桌面应用,适配桌面应用自动化测试。

开发者可以:

-

零代码验证:通过

@midscene/computer-playground快速可视化验证自动化流程; -

脚本开发:基于

@midscene/computer编写 JavaScript 脚本,支持在 Linux CI 环境中通过 Xvfb 运行无头桌面自动化。

import { agentFromComputer } from '@midscene/computer';

const agent = await agentFromComputer({

aiActionContext: '你正在控制一台桌面计算机',

});

await agent.aiAct('将鼠标移动到屏幕中心');

await agent.aiAssert('屏幕有可见内容');

2. 鸿蒙端自动化:填补生态空白,标准接入兼容统一

-

连接方式:Midscene 提供 @midscene/harmony,依托 HDC 连接鸿蒙设备,将鸿蒙纳入统一自动化体系;

-

接口复用:直接沿用aiAct/aiQuery/aiAssert等核心统一接口,无需重新学习;

-

报告能力:执行后输出 HTML 报告,支持回放与调试,完美适配鸿蒙应用开发测试需求。

await agent.launch('com.huawei.hmos.settings');

await agent.aiAct('scroll down one screen');

const items = await agent.aiQuery('string[], 列表中可见的所有设置项名称');

至此,Midscene 实现一次开发、全端运行,彻底消除多设备重复适配成本。

详情参考:PC 桌面入门指南[1]、HarmonyOS 开始使用[2]、iOS 开始使用[3]、Android 开始使用[4]

面向开放:MCP+Skills双路径,融入AI Agent生态

Midscene 从 “自研自用工具” 转向开放式能力平台,提供两种标准化接入方式,支持上层 Agent、研发平台、AI 助手直接调用。

1. MCP(Midscene Control Protocol):设备能力服务化

能力封装:将浏览器、Android、iOS、PC 设备能力封装为标准化 MCP 服务,提供官方封装包:

-

@midscene/android-mcp

-

@midscene/ios-mcp

-

@midscene/computer-mcp

-

@midscene/web-bridge-mcp

自定义扩展:开发者可基于 mcpKitForAgent 搭建专属 MCP Server,将截图、点击、滚动等原子操作接入自有 Agent 体系。

2. Skills:AI 编程助手直连调用

借助 Skills 能力,Claude Code、OpenClaw 等 AI 编程助手能够直接调用 Midscene CLI,实现浏览器、桌面、Android、iOS 与 HarmonyOS 设备的操控。

安装方式例如:

npx skills add web-infra-dev/midscene-skills -a claude-code

安装后,AI 助手就可以通过自然语言直接触发设备操作,示例指令:

Open photo app, see what is the first photo in the album.

详情参考:MCP[7]、Skills[8]

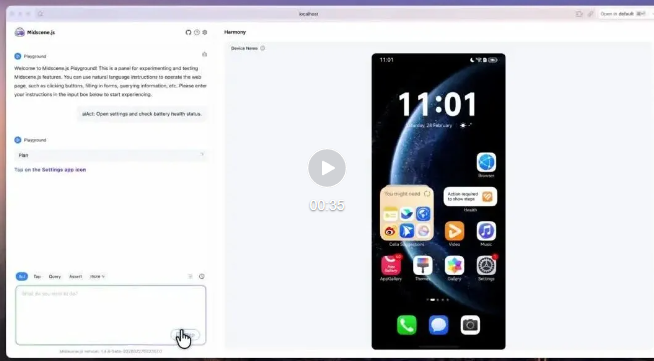

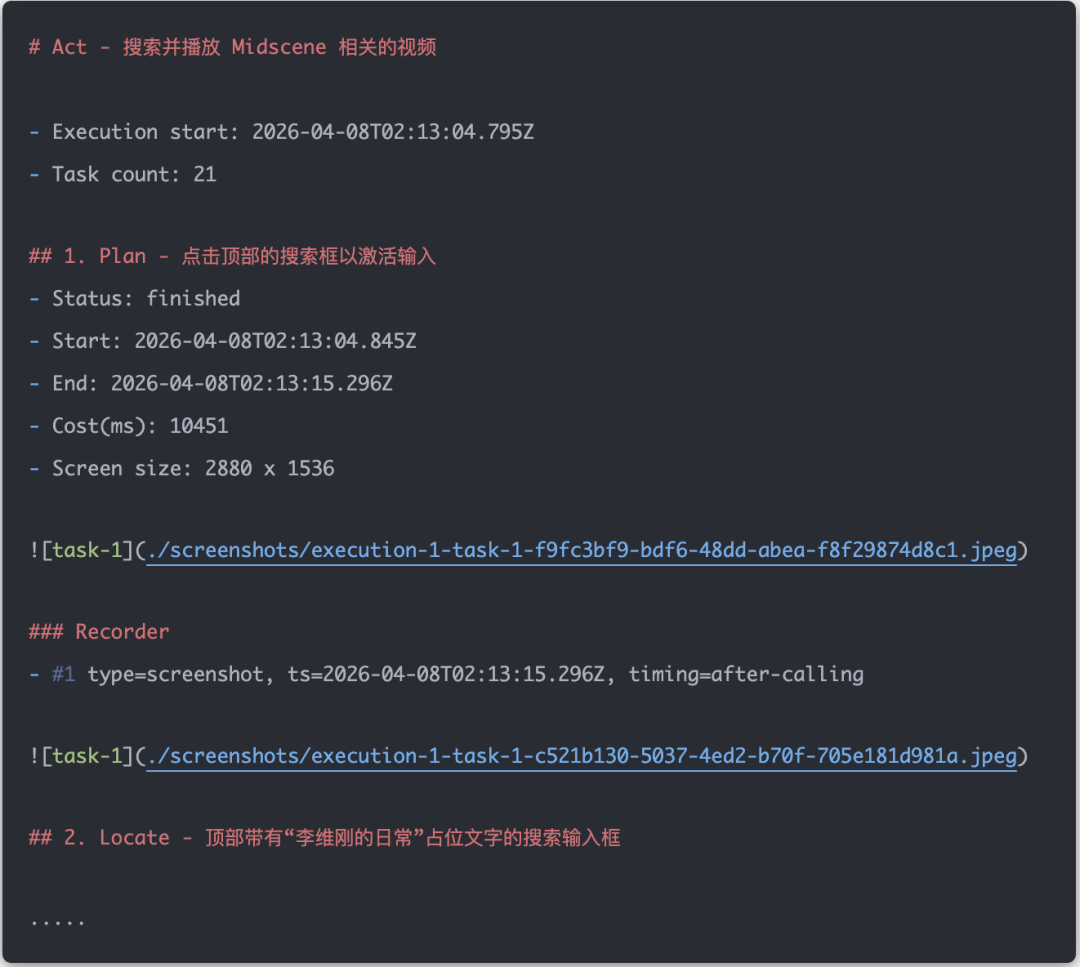

报告能力升级:从 “人工查看” 到 “工具可消费”,支持拆分与Markdown导出

Midscene 将报告从仅用于人工调试的 HTML 页面,升级为可被二次处理的标准化数据产物,打自动化结果全链路复用。

核心能力

-

数据提取:支持导出报告内原始截图、JSON 结构化数据;

-

格式转换:可直接将 HTML 报告转换为 Markdown 格式,适配文档系统、知识库、测试归档;

-

生态联动:转换后的 Markdown 可结合 Remotion Skill 生成自动化执行回放视频。

报告示例

开发者可以把 HTML 报告文件解析为这样一份 Markdown 文件:

在此基础上,还可结合 Remotion Skill 对该 Markdown 文件进行解析,进而生成个性化的回放视频。

视频生成结果如下:

以下视频来源于

详情参考:解析报告文件[9]

新模式支持:兼容智谱、千问、豆包多款视觉大模型

Midscene 持续完善模型适配,新增 4 款高性能视觉大模型,支持操作与理解模型分离配置,满足不同精度、成本需求。

新增支持模型包括:

-

智谱 GLM-V 系列 glm-5v-turbo,glm-4.6v

-

智谱开源手机自动化模型 auto-glm

-

千问qwen3.6-plus

-

豆包doubao-seed-2.0

配置方式(以智谱 GLM-V 为例)

通过环境变量快速配置,需注意区分 MIDSCENE_MODEL_FAMILY 字段:glm-4.6vglm-5v-turbo都应配置为 :glm-v

MIDSCENE_MODEL_BASE_URL="https://open.bigmodel.cn/api/paas/v4"MIDSCENE_MODEL_API_KEY="..."MIDSCENE_MODEL_NAME="glm-4.6v"MIDSCENE_MODEL_FAMILY="glm-v"

灵活拆分:可单独配置 Insight 模型,将 “设备操作” 与 “页面理解” 任务分离,提升执行效率。

详情参考:模型策略[5]、常用模型配置[6]

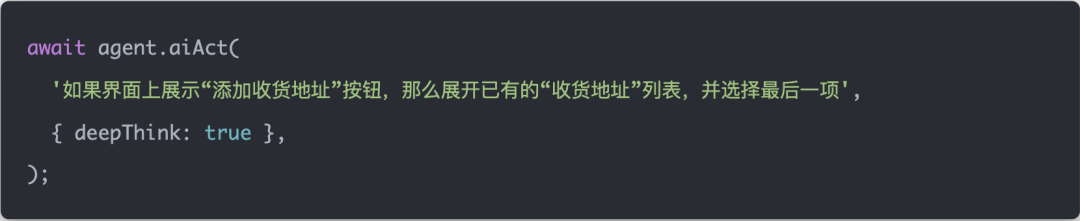

核心能力强化:aiAct 支持深度思考,复杂任务规划准确率跃升

Midscene 为核心接口aiAct新增 deepThink(深度思考) 能力,针对复杂场景优化任务规划逻辑。

适用场景:

目标驱动任务、复杂表单填写、多步骤流程执行、条件分支判断等传统自动化难以处理的场景。

使用方式:

通过deepThink: true参数开启,模型在规划阶段完成充分推理:

特性说明:开启后可显著提升规划准确率,会小幅增加执行耗时,建议在关键核心流程中按需启用。

详情参考:关于-aiact-方法的-deepthink-参数[10]

其他新增特性

-

文件上传支持:完善文件操作能力,适配含上传流程的自动化场景;

-

CDP 浏览器连接模式:新增 YAML 脚本运行器的 CDP 连接方式,提升浏览器自动化稳定性;

-

deepLocate 深度定位:强化界面元素定位能力,进一步降低识别误差,提升执行成功率。

官方参考资料

本次更新所有功能均提供完整官方文档,开发者可快速上手:

[1] PC 桌面入门指南:

https://midscenejs.com/zh/computer-getting-started

[2] HarmonyOS 开始使用:

https://midscenejs.com/zh/harmony-getting-started

[3] iOS 开始使用:

https://midscenejs.com/zh/ios-getting-started

[4] Android 开始使用:

https://midscenejs.com/zh/android-getting-started

[5] 模型策略:

https://midscenejs.com/zh/model-strategy

[6] 常用模型配置:

https://midscenejs.com/zh/model-common-config

[7] MCP:

https://midscenejs.com/zh/mcp

[8] Skills:

https://midscenejs.com/zh/skills

[9] 解析报告文件:

https://midscenejs.com/zh/consume-report-file

[10] 关于-aiact-方法的-deepthink-参数:

https://midscenejs.com/zh/model-strategy#关于-aiact-方法的-deepthink-参数

[11] 文件上传支持:

https://midscenejs.com/zh/api#agentaitap

[12] CDP 浏览器连接模式:

https://midscenejs.com/zh/yaml-script-runner#使用-cdp-连接模式

[13] deepLocate 深度定位:

https://midscenejs.com/zh/api#深度定位deeplocate

行业价值与未来展望

本次迭代让 Midscene 实现三大突破:

-

国产化适配:填补鸿蒙生态标准化自动化工具空白,助力国产化应用开发测试;

-

效率革命:全端统一接口 + 自然语言驱动,大幅降低脚本开发与维护成本;

-

生态融合:MCP+Skills 开放接入,让自动化能力深度融入 AI Agent、企业工作流、RPA 等多元场景。

作为 AI 驱动的跨端自动化工具,Midscene 正从研发测试工具,向全场景智能自动化基础设施演进,未来有望拓展物联网、车机等更多设备场景,重新定义 AI 自动化的技术标准与使用边界。

最后: 下方这份完整的软件测试视频教程已经整理上传完成,需要的朋友们可以自行领取【保证100%免费】

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)