DeepSeek 崩了 13 小时,不是故障,是 V4 在换引擎

DeepSeek V4 定了 4 月下旬发布,但这次最大的看点不是万亿参数——而是推理跑在华为昇腾芯片上,推理不再依赖英伟达。三次跳票换来的是从 CUDA 到 CANN 的全栈迁移,开源 + 国产算力的组合在国内独一份。

正文

3月29号晚上十点半,我正让 DeepSeek 帮我改一段代码,对话框突然弹出"服务器繁忙"。以为是高峰期卡了,等几分钟就好——结果一等就是一整夜。

第二天早上七点才恢复。整整13个小时,网页端、App、API 全线变灰。微博热搜热度冲到95万+,海外 Reddit 上讨论帖热度也炸了,外媒专门发稿报道这次"Major Outage"。

当时大家都在骂服务器不稳定。但恢复之后,第一批抢着登录的人发现了蹊跷——代码输出结构变了,推理过程比之前更完整,连 SVG 图形生成都跟之前判若两人。有人拿"鹈鹕骑自行车"的经典测试题跑了一遍,效果比一周前好了一大截。

我当时就一个念头:这不是故障,这是换引擎。

4 月下旬,终于定了

4月10号,《创智记》从多位知情人士处拿到消息:梁文锋在内部沟通中确认,DeepSeek V4 将于4月下旬正式发布。新浪科技也跟进了这条消息,截至发稿 DeepSeek 方面未回应。

这条信息的分量在于——V4 的发布时间已经变成了一部连载悬疑剧。原计划2月中旬春节前后发,推迟到3月,再推迟到4月。三次跳票,每次都有人喊"狼来了",每次都落空。这次不一样,是内部确认,不是路边社。

更凑巧的是,4月7号深夜 DeepSeek 网页端悄悄上线了"快速模式"和"专家模式"。快速模式适合日常对话、即时响应,支持图片和文件识别;专家模式擅长复杂问题,编码、数理推理能力明显更强,就是高峰期得排队等。

有网友直接问了句"你是V4吗",专家模式居然回答了"是的"。当然这可能只是模型幻觉,但配合之前13小时宕机和各种蛛丝马迹,V4 的雏形已经在跑了,基本没跑。

万亿参数,百万上下文

那 V4 到底升级了什么?综合多方信源和泄露信息:

V4 延续 MoE 架构——混合专家模型,简单说就是模型虽然总参数大,但每次推理只激活一小部分"专家",所以不贵。总参数约 1万亿,推理激活约 370亿。上下文窗口从 V3 的 128K 直接拉到了 100万 token。

100万 token 什么概念?你把一整个中型项目的源码全扔进去,它一次读完,不用分批。

架构上最大的创新是内存层。1月份梁文锋参与发表的 Engram 论文,核心思路是把"记住东西"和"思考问题"拆开——以前模型每次回答都要重新算一遍已知信息,大量算力浪费在重复检索上。Engram 把静态知识存到外部内存,用的时候直接查表,不用重新算。论文数据显示,1000亿参数的查找表放到主机内存,吞吐量损失不到3%。

这技术对国内算力环境特别关键:用便宜的 CPU 内存替代昂贵的 GPU 显存来存知识,等于给算力受限的团队开了条新路。

泄露的基准测试数据(未经官方确认):HumanEval 90%,SWE-bench 超 80%。如果属实,代码能力追上了目前市面上的大部分竞品。不过自己报的分和第三方独立跑出来的经常是两回事,先打个问号,等正式发布看真功夫。

真正的杀手锏:跑在华为芯片上

V4 这回最值得关注的,是它跑在谁的芯片上。

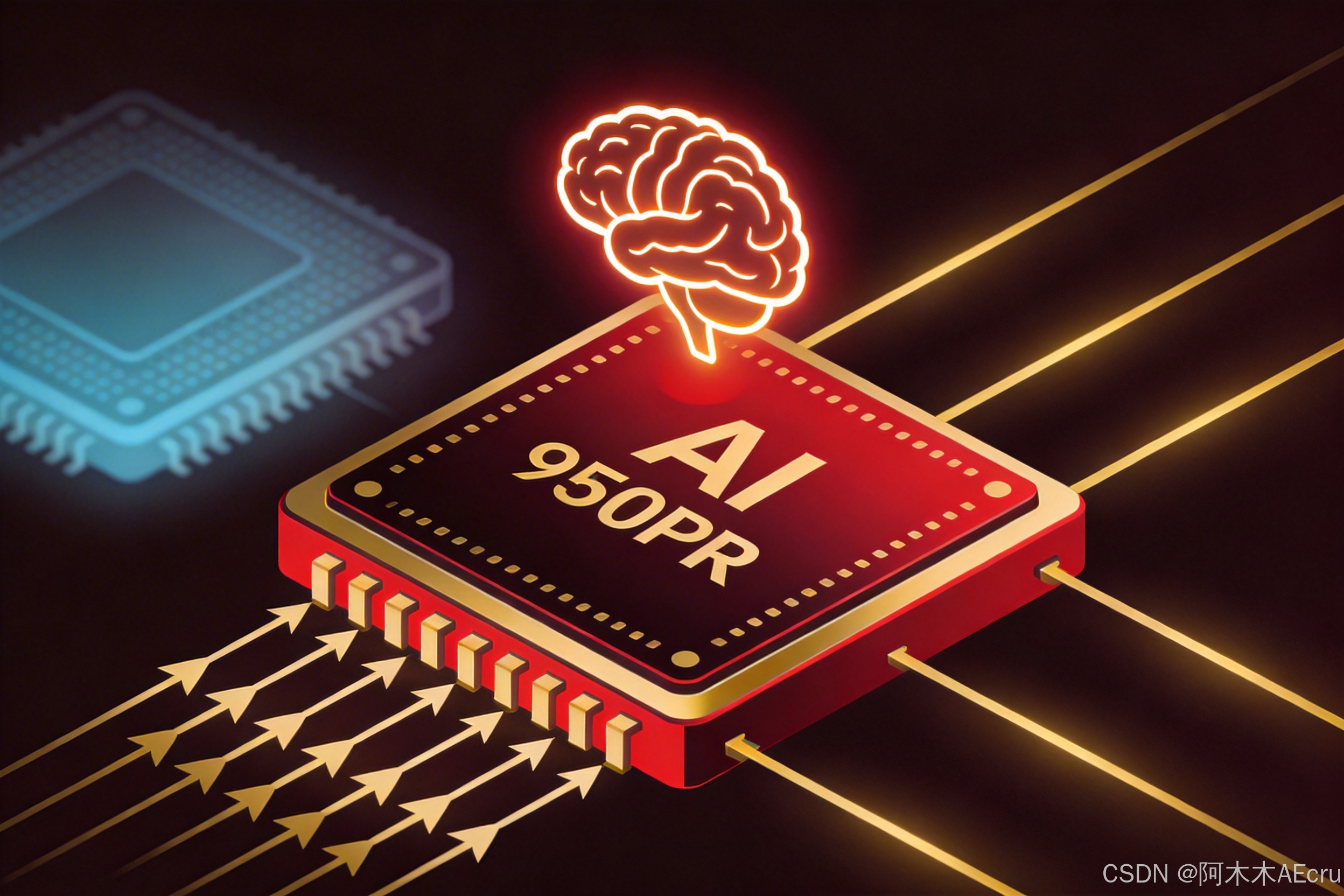

据路透社4月3日报道和 The Information 的跟进,V4 的推理将运行在华为昇腾 950PR 芯片上。这颗芯片今年一季度刚量产,是华为专门为推理场景设计的。FP4 精度算力 1.56 PFLOPS,片上内存 112GB,单卡算力是英伟达 H20 的 2.87 倍。

对,V4 推理不用英伟达了。

更狠的是 DeepSeek 这次打破行业惯例:以前大模型发布前都会先跟英伟达联调优化,V4 直接跳过了,没有向任何美国芯片厂商开放测试,优先跟华为和寒武纪合作。

软件层面,华为的 CANN Next 新增了 SIMT 编程模型,可以直接兼容英伟达 CUDA 代码。简单说就是:以前写的 CUDA 程序,迁移到昇腾上改动不大就能跑。不是完全无缝,第三方库支持还有空白,调试工具链也还不够成熟,但对 DeepSeek 这种有专业团队的项目来说,迁移已经跑通了。

这件事的意义比"又一个新模型"大得多。DeepSeek 是目前中国最有影响力的开源大模型,它主动适配国产芯片,等于给整条国产算力供应链做了信用背书。每一个基于 DeepSeek 开源版本做应用的开发者,都会把算力需求导向国产硬件。对华为昇腾、寒武纪、海光、摩尔线程这些厂商来说,这波客户来得比任何广告都实在。

有报道称,阿里、字节、腾讯已经向华为预订了数十万颗新一代 AI 芯片,准备通过云服务部署 V4 模型。受此影响,AI 芯片价格近期涨了约 20%。

不过要实事求是:V4 的训练目前仍然依赖英伟达 GPU。推理跑在昇腾上已经是重要一步了,但"完全脱离 CUDA"还需要编译器、算子、分布式训练框架等全栈能力的成熟。业内预计至少还要一两年。

为什么跳票三次?

说了这么多好消息,V4 为什么拖了三个月才定档?从2月拖到4月,不是梁文锋拖延症犯了,是三件事卡在了一起。

首先是芯片。昇腾 950PR 今年3月才量产,V4 等的就是这颗芯片。模型从 CUDA 全栈迁移到 CANN Next,编译器、算子、通信库、推理框架全得重写,这不是一两周的活。

架构重构也是个硬骨头。Engram 条件记忆、mHC 流形约束超连接、DeepSeek Sparse Attention 三项技术要整合进同一个模型,稳定性需要时间打磨。据《晚点》报道,梁文锋对效果不满意,宁可推迟也不凑合发布。

还有一层压力来自外部。2025年初 V3 出来的时候,国内大模型还是蓝海。现在智谱刚发了 GLM-5.1,编程定价直接对标 Claude;MiniMax M2.7 号称支持 Agent 自我进化;腾讯混元 3.0 姚顺雨带队,也定在4月发布。迟到三个月的 V4 必须足够惊艳,否则就是白跳票。

行业格局:从价格战到质量战

聊完 V4 本身,说说大环境。过去一年国产大模型市场的竞争逻辑变了。2025年各家还在疯狂压 API 价格,用"白菜价"抢用户。到了2026年,竞争焦点已经转到模型真正解决问题的能力上了。

智谱 GLM-5.1 的定价就是信号:年内涨价超八成后再度提价10%,核心场景价格接近 Claude Sonnet 4.6。这是国产模型第一次不再靠"便宜"打仗,而是用性能溢价打入了国际模型的定价区间。

从这个角度看,V4 的定价策略会很有意思。Apache 2.0 开源,企业可以自主部署,这个底牌已经亮了——成本控制不是靠压 API 价,是靠国产算力把推理成本打下来。

我的看法

V4 能不能复刻去年 V3 的炸场效应?

我觉得很难,但也不需要复刻。去年 V3 的震撼来自两个:模型能力确实强,加上成本比同行低一个数量级,直接把英伟达股价打下来了一截。现在同行都追上来了,"便宜且强"不再是 DeepSeek 的独门绝技。

V4 真正的筹码在算力生态。 当中国最火的开源大模型完全跑在国产芯片上,这件事对产业链的影响比任何一组基准测试数据都实在。

如果你想用国产算力跑自己的 AI 服务,V4 + 昇腾 950PR 是目前最成熟的开源组合,没有之一。

至于"要不要等 V4"——做 AI 应用开发的,值得等。开源加上国产算力再加上成本可控,这个组合在国内市场上找不出第二家。

评论区押注:你觉得 V4 能在 SWE-bench 上超 80% 吗?超了的扣 1,没超的扣 2,最离谱的答案我请你喝咖啡(虽然不一定兑现)。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)