MindSpore 环境配置完全指南

深度学习框架的环境配置是每一位开发者入门的第一道门槛,也是后续项目开发的基础保障。一个配置完善的环境不仅能避免后续开发中的诸多麻烦,还能显著提升开发效率与模型训练性能。MindSpore 作为华为开源的全场景 AI 框架,凭借其端云协同的架构设计和昇腾 NPU 深度优化的特性,在学术研究和工业落地两端均取得了广泛应用。然而,不少开发者在初次接触 MindSpore 时,常常被环境配置的种种细节所困

MindSpore 环境配置完全指南

作者:whitea133

邮箱:1309848726@qq.com

GitHub:https://github.com/whitea133

Gitee:https://gitee.com/whitea133

前言

深度学习框架的环境配置是每一位开发者入门的第一道门槛,也是后续项目开发的基础保障。一个配置完善的环境不仅能避免后续开发中的诸多麻烦,还能显著提升开发效率与模型训练性能。MindSpore 作为华为开源的全场景 AI 框架,凭借其端云协同的架构设计和昇腾 NPU 深度优化的特性,在学术研究和工业落地两端均取得了广泛应用。然而,不少开发者在初次接触 MindSpore 时,常常被环境配置的种种细节所困扰:如何在不同硬件平台上正确安装?Windows、Linux、macOS 系统各有何注意事项?如何在华为云昇腾服务器上快速部署?遇到兼容性问题如何排查?本文将系统性地解答上述所有问题,从最基础的 pip 安装到进阶的昇腾 NPU 配置,从开发工具链的搭建到常见问题的排查自救,辅以大量可直接运行的代码示例,帮助你在最短时间内搭建起一个稳定、高效的 MindSpore 开发环境。

硬件与系统要求全面解析

处理器与硬件加速器

MindSpore 支持多种硬件后端,不同硬件平台对安装包和配置流程有显著影响:

CPU 版本适合入门学习、小规模数据实验和算法验证。CPU 版本安装最简单,对硬件无特殊要求,任何支持 AVX2 指令集的 x86_64 处理器均可运行。需要注意的是,CPU 版本在大规模矩阵运算上性能有限,训练大型模型会非常缓慢,不建议用于正式的项目开发。使用 CPU 版本的主要场景包括:学习 MindSpore 基本 API、验证算法逻辑的正确性、处理小型数据集(如 MNIST、CIFAR-10 等)、进行代码调试和单元测试等。

GPU 版本支持 NVIDIA CUDA 加速,适合有 NVIDIA 显卡的个人开发者和工作站环境。MindSpore GPU 版本需要 CUDA 和 cuDNN 库的支持,不同 MindSpore 版本对 CUDA 版本有明确的兼容性要求。例如,MindSpore 2.3.x 需要 CUDA 11.8 和 cuDNN 8.5 以上版本,同时 NVIDIA 驱动需要达到 525 以上。使用 GPU 版本可以显著加速模型训练和推理过程,适合中大规模的深度学习项目。

昇腾 NPU 版本是 MindSpore 的主场优势所在。昇腾 910 和昇腾 310 是华为自研的 AI 处理器,MindSpore 在这些硬件上进行了深度优化,性能表现优异。NPU 版本需要安装 CANN(Compute Architecture for Neural Networks)算子库,这是华为为昇腾系列处理器提供的底层计算架构。昇腾 910 主要用于数据中心的大规模训练场景,而昇腾 310 则更适合边缘推理部署。

从性价比角度来说,如果你在华为云或其他支持昇腾的云平台上开发,强烈推荐使用 NPU 版本——不仅性能更强,价格也通常比同等算力的 GPU 实例更具竞争力。在昇腾 NPU 上,MindSpore 的图算融合技术可以自动将多个算子融合为更高效的算子,减少内存访问开销,从而获得更好的训练效率。

操作系统兼容性

| 操作系统 | CPU | GPU | NPU | 推荐程度 |

|---|---|---|---|---|

| Ubuntu 20.04/22.04 | 是 | 是 | 是 | 首选 |

| CentOS 7/8 | 是 | 是 | 是 | 良好 |

| Windows 10/11 (WSL2) | 是 | 是 | 否 | 备选 |

| Windows 原生 | 是 | 是 | 否 | 不推荐 |

| macOS | 是 | 否 | 否 | 仅学习用 |

从实际开发体验来看,Linux(尤其是 Ubuntu)是 MindSpore 开发的首选平台。Ubuntu 22.04 LTS 版本拥有较新的 glibc 版本和长期支持保障,是最推荐的操作系统选择。CentOS 用户可以考虑迁移到 Rocky Linux 或 AlmaLinux,这些系统与 CentOS 7/8 保持 API 兼容,同时获得了持续的更新支持。

Windows 用户建议通过 WSL2(Windows Subsystem for Linux 2)来获得接近原生 Linux 的体验。WSL2 基于 Hyper-V 虚拟化技术,提供了真正的 Linux 内核,性能远超 WSL1。需要注意的是,昇腾 NPU 驱动目前无法在 WSL2 中使用,因此如果你需要使用昇腾 NPU,只能选择原生 Linux 或华为云服务器。

存储与内存需求

MindSpore 框架本身安装包约 200-500MB,但考虑到后续模型文件、数据集缓存和 CANN 驱动等依赖,建议预留至少 20GB 的可用磁盘空间。CANN 算子库本身约占 2-5GB,昇腾驱动约 1GB,MindSpore 及相关依赖约 500MB。在实际项目中,模型检查点(checkpoint)文件可能非常大,例如 ResNet-50 的检查点约 100MB,而更大的模型如 BERT-Large 可能超过 1GB。

内存方面,入门级实验建议 8GB 以上,正式开发建议 16GB 及以上。如果进行大规模分布式训练或使用超大模型,可能需要 32GB 或更多的内存。对于使用 GPU 的用户,需要同时考虑显存(VRAM)需求:简单的 CNN 模型通常需要 4-8GB 显存,而大型 Transformer 模型可能需要 16GB 以上。

安装前准备:依赖环境检查

Python 版本要求

MindSpore 2.x 系列要求 Python 版本 >= 3.9:

python3 --version

python --versionpip 版本升级

pip install --upgrade pip

pip --version系统级依赖(Linux)

# Ubuntu/Debian 系统

sudo apt update

sudo apt install -y build-essential git wget libgl1-mesa-glx libglib2.0-0

# CentOS/RHEL 系统

sudo yum groupinstall -y "Development Tools"

sudo yum install -y git wget mesa-libGL glib2-devel虚拟环境隔离

# 使用 conda 创建 MindSpore 环境

conda create -n mindspore_env python=3.9 -y

conda activate mindspore_env

# 或使用 venv

python -m venv mindspore_venv

source mindspore_venv/bin/activatepip 安装:最简单快速的方案

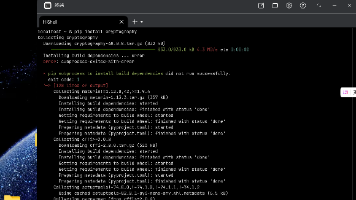

pip 安装是最推荐的入门方式,适合大多数开发者快速上手。整个过程通常不超过 10 分钟。

CPU 版本安装

# 安装最新稳定版

pip install mindspore

# 指定版本

pip install mindspore==2.3.1

# 华为云镜像加速

pip install mindspore -i https://repo.huaweicloud.com/repository/pypi/simple/

# 清华镜像

pip install mindspore -i https://pypi.tuna.tsinghua.edu.cn/simple/GPU 版本安装

| MindSpore 版本 | CUDA 版本 | 最低驱动版本 |

|---|---|---|

| 2.3.x | CUDA 11.8 | NVIDIA Driver 525+ |

| 2.2.x | CUDA 11.7 | NVIDIA Driver 518+ |

| 2.1.x | CUDA 11.6 | NVIDIA Driver 510+ |

# 确认 CUDA 版本

nvcc --version

# 安装 GPU 版本

pip install mindspore-gpu==2.3.1 -i https://repo.huaweicloud.com/repository/pypi/simple/完整安装脚本

以下是一个封装好的安装脚本,可自动检测环境并完成安装:

import subprocess

import sys

import platform

import re

def run_command(cmd, description):

print(f"Running: {description}")

try:

result = subprocess.run(

cmd, shell=True, capture_output=True, text=True, timeout=300

)

if result.returncode == 0:

print(" Success")

return result.stdout.strip()

else:

print(f" Failed: {result.stderr}")

return None

except subprocess.TimeoutExpired:

print(" Timeout")

return None

def check_python_version():

version = sys.version_info

print(f"Python: {version.major}.{version.minor}.{version.micro}")

if version.major == 3 and version.minor >= 9:

print(" OK")

return True

else:

print(" Too low, need >= 3.9")

return False

def check_cuda():

result = run_command("nvcc --version", "Check CUDA")

if result:

match = re.search(r"release (\d+\.\d+)", result)

if match:

print(f" CUDA {match.group(1)} detected")

return match.group(1)

print(" No CUDA, CPU version will be installed")

return None

def install_mindspore(cuda_version=None):

mirror = "https://repo.huaweicloud.com/repository/pypi/simple/"

if cuda_version:

major, minor = cuda_version.split(".")

if float(f"{major}.{minor}") >= 11.8:

cmd = f"pip install mindspore-gpu==2.3.1 -i {mirror}"

elif float(f"{major}.{minor}") >= 11.7:

cmd = f"pip install mindspore-gpu==2.2.0 -i {mirror}"

else:

cmd = f"pip install mindspore-gpu==2.1.0 -i {mirror}"

print(" Installing GPU version...")

else:

cmd = f"pip install mindspore -i {mirror}"

print(" Installing CPU version...")

return run_command(cmd, "Install MindSpore")

def verify_installation():

code = 'import mindspore as ms; print(f"Version: {ms.__version__}"); ms.set_context(device_target="CPU"); print("CPU OK"); x = ms.tensor([[1,2],[3,4]]); print(f"Tensor: {x.shape}")'

return run_command(f'python -c "{code}"', "Verify")

def main():

print("=" * 50)

print("MindSpore Auto Install Script")

print("=" * 50)

if not check_python_version():

sys.exit(1)

run_command("pip install --upgrade pip", "Upgrade pip")

cuda = check_cuda()

if install_mindspore(cuda):

verify_installation()

print("=" * 50)

print("Done!")

if __name__ == "__main__":

main()运行:python install_mindspore.py

conda 安装:环境隔离的最佳实践

对于需要同时管理多个深度学习项目、不同框架版本共存于同一台机器上的开发者,conda 环境管理是更优的选择。conda 不仅能管理 Python 包,还能管理非 Python 的系统依赖,具有更强的环境隔离能力。使用 conda 的另一个重要优势是可以轻松切换不同版本的 Python 和各种深度学习框架,避免版本冲突带来的困扰。

安装 Miniconda

Miniconda 是 Anaconda 的精简版本,只包含 conda 和必要的依赖包,推荐用于深度学习环境配置:

# 下载 Miniconda 安装脚本

wget https://repo.anaconda.com/miniconda/Miniconda3-latest-Linux-x86_64.sh

# 运行安装脚本

bash Miniconda3-latest-Linux-x86_64.sh

# 安装过程中按提示操作,推荐选择"yes"将 conda 初始化

# 这会自动在 ~/.bashrc 中添加 conda 初始化代码

# 重启终端使配置生效使用 conda 创建 MindSpore 环境

创建独立的环境可以避免不同项目之间的依赖冲突:

# 创建独立的 Python 3.9 环境

conda create -n mindspore_env python=3.9 -y

# 激活环境

conda activate mindspore_env

# 在 conda 环境中安装 MindSpore(使用华为云镜像加速)

pip install mindspore -i https://repo.huaweicloud.com/repository/pypi/simple/conda 环境管理技巧

熟练掌握 conda 环境管理可以大大提高开发效率:

# 查看所有 conda 环境

conda env list

# 导出环境配置(方便在其他机器上复现)

conda env export -n mindspore_env > mindspore_env.yaml

# 通过 yaml 文件创建相同的环境

conda env create -f mindspore_env.yaml

# 克隆已有环境(适合需要并行实验的场景)

conda create --name mindspore_exp2 --clone mindspore_env

# 删除不再需要的环境

conda env remove -n mindspore_env --yes

# 查看环境中已安装的包

conda list -n mindspore_env导出的 mindspore_env.yaml 示例:

name: mindspore_env

channels:

- defaults

- https://repo.huaweicloud.com/repository/pypi/simple/

dependencies:

- python=3.9

- pip>=21.0

- pip:

- mindspore==2.3.1

- mindvision>=0.9.0

- mindspore-dataset>=2.3.0源码编译安装:追求极致性能

源码编译的系统依赖

sudo apt install -y \

gcc-9 g++-9 \

cmake ninja-build \

libblas-dev liblapack-dev \

python3-dev \

wget zip unzip \

autoconf automake libtool curl make gawk git \

libncurses5-dev zlib1g-dev libbz2-dev libsqlite3-dev

sudo update-alternatives --install /usr/bin/gcc gcc /usr/bin/gcc-9 100

sudo update-alternatives --install /usr/bin/g++ g++ /usr/bin/g++-9 100编译安装 MindSpore

# 克隆源码

git clone https://github.com/mindspore-ai/mindspore.git

cd mindspore

git checkout r2.3.1

# 创建 build 目录

mkdir build && cd build

# CPU 版本配置

cmake .. \

-DENABLE_CPU=ON \

-DENABLE_GPU=OFF \

-DENABLE_NPU=OFF \

-DPYTHON_VERSION=3.9 \

-DCMAKE_BUILD_TYPE=Release

# GPU 版本配置

cmake .. \

-DENABLE_CPU=OFF \

-DENABLE_GPU=ON \

-DENABLE_NPU=OFF \

-DCUDA_ARCH_BIN="8.6;8.9" \

-DPYTHON_VERSION=3.9 \

-DCMAKE_BUILD_TYPE=Release

# 编译

make -j$(nproc)

make install昇腾 NPU 环境配置详解

昇腾 NPU 是 MindSpore 的主场硬件,在昇腾上运行需要配置完整的软件栈。相比 CPU/GPU 版本,NPU 版本的配置要复杂得多,但性能收益也最为显著。在实际测试中,昇腾 910 在 BERT-Large 训练任务上可以达到接近 V100 GPU 的性能,而功耗和成本更低。

昇腾软件栈架构

昇腾 NPU 的软件栈分为三层,每一层都有其独特的功能和配置要求:

驱动层(Driver):操作系统内核模块,负责与 NPU 硬件通信。驱动需要在 Linux 内核中加载,通常由华为提供 .run 安装包进行安装。驱动版本需要与 CANN 版本匹配,同时也需要适配当前运行的内核版本。如果你在使用过程中遇到驱动加载失败的问题,首先应该检查驱动版本与内核版本的兼容性。

CANN 层(Compute Architecture for Neural Networks):这是昇腾的核心软件层,提供了神经网络算子的硬件级实现。CANN 相当于 NVIDIA 的 CUDA + cuDNN 的结合体,包含了算子开发工具 TBE(Tensor Boost Engine)和图编译优化工具 GE(Graph Engine)。CANN 的版本需要与 MindSpore 版本严格匹配,不兼容的版本组合可能导致算子找不到或性能下降。

MindSpore 框架层:深度学习框架本身,通过 CANN 提供的算子接口调度 NPU 进行计算。MindSpore 在昇腾上进行了深度优化,包括算子融合、自动并行、梯度累积等技术,可以充分利用昇腾的硬件特性。

安装昇腾驱动

wget https://download.huaweicloud.com/ascend/ascend-driver驱动的实际文件名.run

chmod +x ascend-driver驱动的实际文件名.run

sudo ./ascend-driver驱动的实际文件名.run --full

# 验证

ls /usr/local/Ascend/driver/

cat /proc/driver/ascend/version安装 CANN 算子库

wget https://ascend-repo.obs.cn-south-1.myhuaweicloud.com/CANN/7.1/Ascend-cann-community_7.1.0_linux.run

bash Ascend-cann-community_7.1.0_linux.run --full

# 配置环境变量

export ASCEND_HOME=/usr/local/Ascend

export PATH=$ASCEND_HOME/ascend-toolkit/latest/bin:$ASCEND_HOME/driver/latest/driver/tools:$PATH

export LD_LIBRARY_PATH=$ASCEND_HOME/ascend-toolkit/latest/lib64:$ASCEND_HOME/driver/latest/driver/lib64:$LD_LIBRARY_PATH

export ASCEND_OPP_PATH=$ASCEND_HOME/ascend-toolkit/latest/opp

source ~/.bashrc

ascend-toolkit-version安装 MindSpore NPU 版本

conda activate mindspore_env

pip install mindspore -i https://repo.huaweicloud.com/repository/pypi/simple/

python -c "import mindspore as ms; ms.set_context(device_target='Ascend')"多 NPU 分布式配置

import mindspore as ms

from mindspore.communication import init, get_rank, get_group_size

# 初始化分布式通信

init()

rank_id = get_rank()

group_size = get_group_size()

print(f"Rank ID: {rank_id}, Total devices: {group_size}")

ms.set_auto_parallel_context(parallel_mode=ms.ParallelMode.DATA_PARALLEL, gradients_mean=True)启动多 NPU 训练:

export RANK_SIZE=8

export RANK_TABLE_FILE=/path/to/rank_table_8p.json

python train.py华为云昇腾服务器快速部署

使用华为云镜像市场

# 使用预装镜像创建实例

pip install mindspore -i https://repo.huaweicloud.com/repository/pypi/simple/

python -c "import mindspore as ms; print(ms.__version__); ms.set_context(device_target='Ascend')"使用 ModelArts Pro 云端开发环境

华为云 ModelArts 提供了无需配置即可使用的 MindSpore 开发环境,支持免费算力体验。

华为云存储(OBS)数据对接

import os

from obs import ObsClient

class OBSManager:

def __init__(self, ak, sk, server="obs.cn-south-1.myhuaweicloud.com"):

self.obs = ObsClient(access_key_id=ak, secret_access_key=sk, server=server)

def upload_file(self, bucket_name, object_key, local_file_path):

resp = self.obs.putFile(bucket_name, object_key, local_file_path)

if resp.status < 300:

print(f"Uploaded: obs://{bucket_name}/{object_key}")

return resp

def download_file(self, bucket_name, object_key, local_file_path):

resp = self.obs.getObject(bucket_name, object_key, downloadPath=local_file_path)

if resp.status < 300:

print(f"Downloaded: {local_file_path}")

return resp

def list_files(self, bucket_name, prefix=""):

resp = self.obs.listObjects(bucket_name, prefix=prefix)

if resp.status < 300:

return [obj.key for obj in resp.body.contents]

return []

def presigned_url(self, bucket_name, object_key, expires=3600):

resp = self.obs.createSignedUrl("GET", bucket_name, object_key, expires=expires)

if resp.status < 300:

return resp.signedUrl

return None

if __name__ == "__main__":

ak = os.environ.get("HUAWEI_CLOUD_AK", "your-ak")

sk = os.environ.get("HUAWEI_CLOUD_SK", "your-sk")

manager = OBSManager(ak, sk)安装 SDK:pip install esdk-obs-python -i https://repo.huaweicloud.com/repository/pypi/simple/

开发工具链:MindStudio 完整配置

MindStudio 安装(Linux)

wget https://download.huaweicloud.com/mindstudio/MindStudio_3.1.0_linux.tar.gz

sudo tar -xzf MindStudio_3.1.0_linux.tar.gz -C /opt/

cd /opt/MindStudio/bin

chmod +x mindstudio.sh

./mindstudio.shPyCharm 配置 MindSpore

# 1. File -> Settings -> Python Interpreter

# 2. Add -> Existing environment

# 3. 浏览到 conda 环境路径

# 4. 安装 MindSpore 插件安装验证与基础功能测试

import sys

def test_all():

print("=" * 50)

print("MindSpore Environment Verification")

print("=" * 50)

# 1. 导入测试

try:

import mindspore as ms

print(f"Version: {ms.__version__}")

except ImportError as e:

print(f"Import failed: {e}")

sys.exit(1)

# 2. 张量运算

try:

a = ms.Tensor([[1, 2, 3], [4, 5, 6]], dtype=ms.float32)

b = ms.Tensor([[7, 8, 9], [10, 11, 12]], dtype=ms.float32)

c = ms.matmul(a, b.T)

print(f"Tensor ops: shape={c.shape}")

except Exception as e:

print(f"Tensor ops failed: {e}")

# 3. 后端测试

for target in ["CPU", "GPU", "Ascend"]:

try:

ms.set_context(device_target=target)

x = ms.Tensor([1, 2, 3])

_ = x * 2

print(f"{target}: OK")

except:

print(f"{target}: N/A")

# 4. 自动微分

try:

from mindspore import nn

net = nn.Dense(10, 1)

x = ms.Tensor([[float(i) for i in range(10)]], dtype=ms.float32)

grad_fn = ms.grad(net)

grad = grad_fn(x)

print(f"Autograd: shape={grad.shape}")

except Exception as e:

print(f"Autograd failed: {e}")

# 5. 数据集

try:

from mindspore.dataset import GeneratorDataset

import numpy as np

def gen():

for i in range(10):

yield np.random.randn(3, 32, 32), i

ds = GeneratorDataset(source=gen, column_names=["img", "label"])

print(f"Dataset: {ds.get_dataset_size()} samples")

except Exception as e:

print(f"Dataset failed: {e}")

# 6. 训练

try:

import numpy as np

from mindspore import nn

net = nn.Dense(10, 10)

opt = nn.Adam(net.trainable_params(), 0.01)

train_net = nn.TrainOneStepCell(net, opt)

x = ms.Tensor(np.random.randn(4, 10).astype(np.float32))

y = ms.Tensor(np.random.randint(0, 10, 4).astype(np.int32))

for _ in range(3):

loss = train_net(x, y)

print("Training: OK")

except Exception as e:

print(f"Training failed: {e}")

print("=" * 50)

print("Verification Complete")

if __name__ == "__main__":

test_all()常见问题与解决方案

Q1: pip 安装报 unsupported platform

Windows 原生支持有限,使用 WSL2:

wsl --install -d Ubuntu-20.04

wsl -d Ubuntu-20.04

pip install mindspore -i https://repo.huaweicloud.com/repository/pypi/simple/Q2: GPU 版本找不到 CUDA

nvcc --version

export LD_LIBRARY_PATH=/usr/local/cuda/lib64:$LD_LIBRARY_PATH

export PATH=/usr/local/cuda/bin:$PATH

pip uninstall mindspore-gpu -y

pip install mindspore-gpu==2.3.1 -i https://repo.huaweicloud.com/repository/pypi/simple/Q3: 昇腾 NPU 运行时 Device not found

cat /proc/driver/ascend/version

ls $ASCEND_HOME/ascend-toolkit/latest/

sudo ./驱动安装包.run --full

rebootQ4: conda 环境中安装失败

which pip

$(which pip) install mindspore -i https://repo.huaweicloud.com/repository/pypi/simple/Q5: 编译时 CMake 找不到 Python

cmake .. \

-DPYTHON_EXECUTABLE=$(which python) \

-DPYTHON_INCLUDE_DIR=$(python -c "import sysconfig; print(sysconfig.get_path('include'))")Q6: NPU 版本算子不存在

检查 CANN 与 MindSpore 版本兼容性:

ascend-toolkit-version

python -c "import mindspore as ms; print(ms.__version__)"Q7: 训练时显存溢出

减小 batch_size,启用混合精度:

from mindspore.amp import auto_mixed_precision

auto_mixed_precision(model, 'O3')Q8: WSL2 中 NPU 不可用

WSL2 目前不支持昇腾 NPU,请使用原生 Linux 或华为云服务器。

Q9: 多 NPU 训练失败

确保 RANK_TABLE_FILE 正确配置:

export RANK_SIZE=8

export RANK_TABLE_FILE=/path/to/rank_table_8p.jsonQ10: 安装后 import 报错

pip cache purge

pip uninstall mindspore -y

pip install mindspore -i https://repo.huaweicloud.com/repository/pypi/simple/性能调优与环境维护

1. 启用混合精度

from mindspore.amp import auto_mixed_precision

auto_mixed_precision(net, 'O3')2. 数据预处理优化

# 使用 num_parallel_workers 加速

dataset = dataset.batch(batch_size=32)

dataset = dataset.repeat(count=5)3. 环境维护

# 定期更新

pip install --upgrade mindspore

# 查看已安装版本

pip list | grep mindspore总结

本文全面介绍了 MindSpore 环境配置的各个方面:

-

硬件选择:根据需求选择 CPU/GPU/NPU 版本。CPU 版本适合入门学习,GPU 版本适合有 NVIDIA 显卡的开发者,昇腾 NPU 版本则是华为云用户的最佳选择。

-

安装方式:pip(推荐)、conda、源码编译三种方案。pip 适合大多数场景,conda 适合需要隔离多环境的项目,源码编译适合追求极致性能的开发者。

-

昇腾 NPU:三层软件栈(驱动层、CANN 层、MindSpore 框架层)配置详解。昇腾 NPU 是 MindSpore 的主场优势,在性能与成本上都有竞争力。

-

华为云:快速部署方案和 OBS 对接。通过华为云镜像市场和 ModelArts,可以零配置开始 MindSpore 开发。

-

开发工具:MindStudio 和 PyCharm 配置。MindStudio 是华为官方 IDE,提供了完整的昇腾 NPU 调试能力;PyCharm 则是广受欢迎的通用 Python IDE。

-

验证测试:完整的环境验证脚本,涵盖导入、张量运算、后端选择、自动微分、数据集加载、模型训练等 6 个关键环节。

-

常见问题:10 个常见问题的解决方案,覆盖了 Windows 安装、CUDA 配置、NPU 驱动、conda 环境、源码编译等各个方面的典型问题。

环境配置虽然是深度学习开发的"基础设施",但掌握好这些知识可以为后续的开发工作节省大量时间。希望本文能帮助你顺利完成 MindSpore 环境配置,开启深度学习之旅!

配置检查清单:

- Python 版本 >= 3.9

- pip 已升级到最新版本

- 选择了合适的硬件后端(CPU/GPU/NPU)

- 使用了国内镜像源加速下载

- 环境验证脚本全部通过

- 掌握了常见问题的解决方法

作者:whitea133

邮箱:1309848726@qq.com

GitHub:https://github.com/whitea133

Gitee:https://gitee.com/whitea133

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)