DeepSeek-R1-671B W8A8 昇腾NPU双机部署实战指南

这套方案的核心价值在于把千亿级MoE模型的部署成本降到了两台服务器的级别,而且性能和精度都没打太多折扣。对比国外同类方案,昇腾硬件的性价比优势明显,特别适合预算有限但又想用顶级模型的团队。后续我们会继续测试更长的上下文长度(32K+)和专家并行的优化空间,有新进展会同步更新。

本文目录:

一、为什么选择这套方案?

1.1 技术背景

去年底DeepSeek发布的R1-671B模型在推理能力上取得了突破,但6710亿参数的体量让部署成为难题。好消息是,通过W8A8量化(权重和激活都用8位整数),配合MoE架构的稀疏激活特性,实际推理时只需激活约370亿参数,这让双卡部署成为可能。

我们这次用的是vLLM-Ascend方案——这是vLLM官方认证的昇腾后端,不是第三方魔改版本。它的核心优势在于:

- PagedAttention技术:把KV Cache管理得像操作系统分页内存一样精细,显存利用率能提升到90%以上

- 低侵入式架构:所有昇腾相关代码都在独立插件里,主代码库保持干净,升级维护都方便

- 性能实测:相比FP16精度几乎无损,吞吐量还能提升1.6倍

1.2 硬件选型说明

这次部署用的是2台Atlas 800I A2服务器,每台配8张64GB显存的NPU卡。为什么是这个配置?

- 显存计算:W8A8量化后模型约需670GB显存(671B参数×1字节/参数),双机16卡正好够用还有余量

- 互联带宽:服务器间走RoCE网络,单向带宽100Gbps,能撑住跨机TP通信

- 性价比:相比单机16卡方案,双机部署更灵活,后期扩展也方便

二、环境准备

2.1 核心组件版本锁定

部署大模型最怕版本不兼容,下面这张表是实测稳定的版本组合,建议照抄:

| 组件 | 版本 | 关键说明 |

|---|---|---|

| 硬件 | Atlas 800I A2 (64GB) × 2台 | 单台8卡,总计16卡 |

| 基础镜像 | MindIE v0.9.1-dev-openeuler | 已集成CANN/torch_npu/vllm/vllm-ascend |

| 操作系统 | openEuler 24.03 LTS | 昇腾官方适配系统 |

| 编译工具链 | GCC 12 / 适配工具链7.3.0 | 编译扩展算子必备 |

| Python | 3.10+ | 镜像内置3.11 |

2.2 资源下载

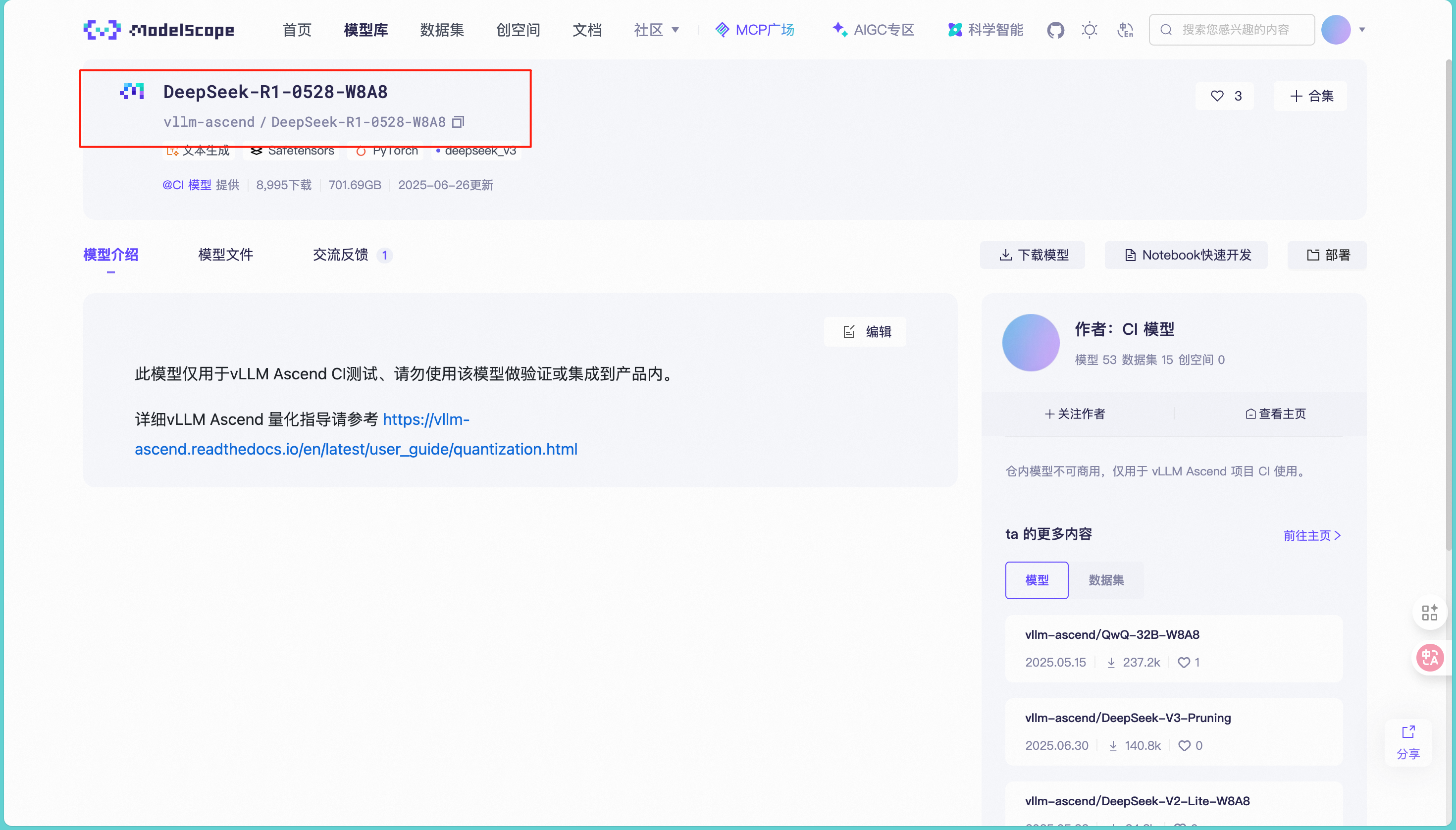

模型权重

ModelScope地址:

https://www.modelscope.cn/models/vllm-ascend/DeepSeek-R1-0528-W8A8

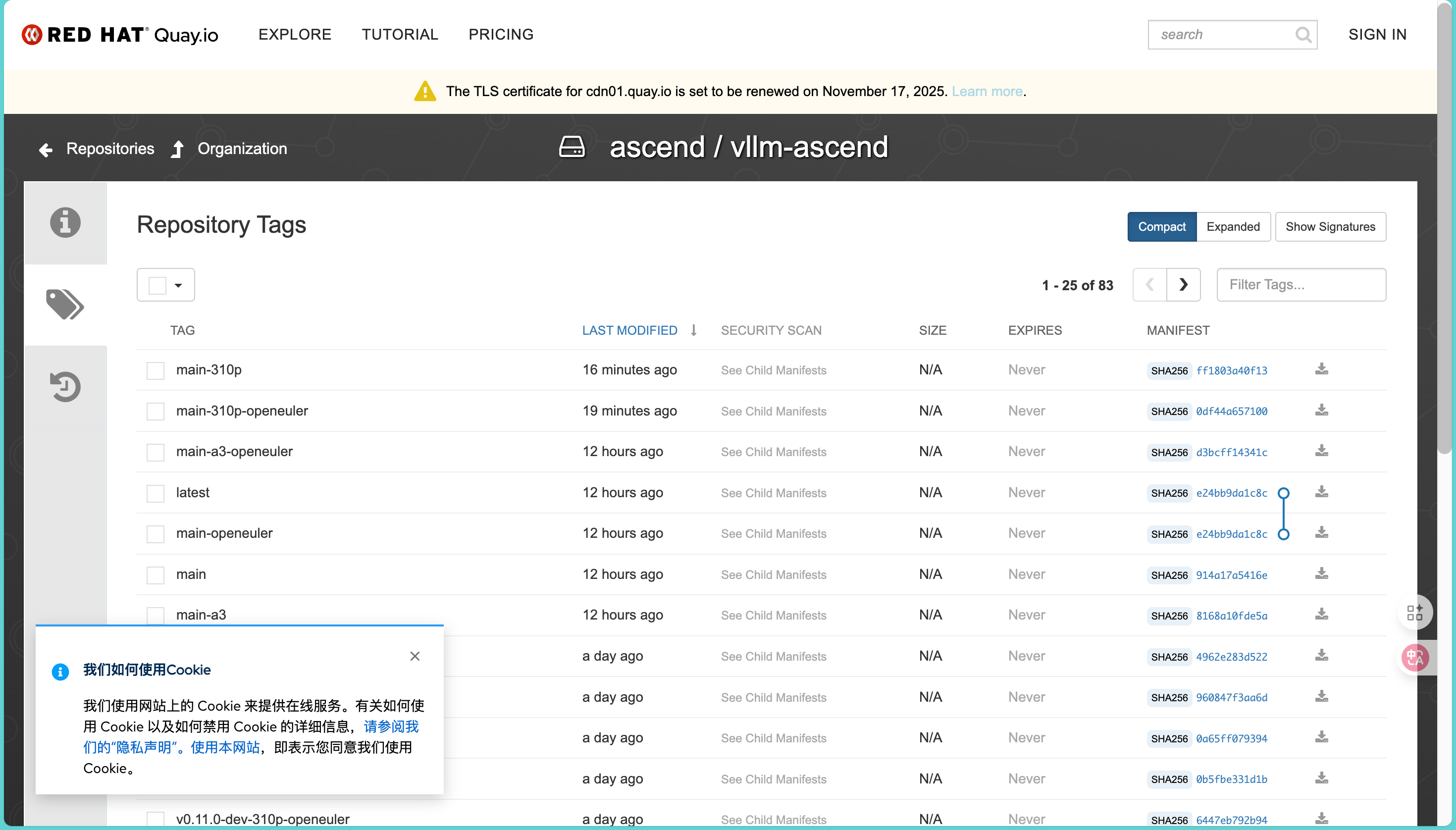

Docker镜像

华为官方镜像仓库(推荐用这个,省去环境配置):

quay.io/repository/ascend/vllm-ascend?tab=tags

选择v0.9.1-dev-openeuler标签

三、部署流程

3.1 启动容器

在两台服务器上分别执行(注意替换容器名和镜像名):

docker run --name deepseek-node0 \

--net=host --shm-size=500g \

--device /dev/davinci0 \

--device /dev/davinci1 \

--device /dev/davinci2 \

--device /dev/davinci3 \

--device /dev/davinci4 \

--device /dev/davinci5 \

--device /dev/davinci6 \

--device /dev/davinci7 \

--device /dev/davinci_manager \

--device /dev/devmm_svm \

--device /dev/hisi_hdc \

-v /usr/local/dcmi:/usr/local/dcmi \

-v /usr/local/bin/npu-smi:/usr/local/bin/npu-smi \

-v /usr/local/Ascend/driver/lib64/:/usr/local/Ascend/driver/lib64/ \

-v /usr/local/Ascend/driver/version.info:/usr/local/Ascend/driver/version.info \

-v /etc/ascend_install.info:/etc/ascend_install.info \

-v /root/.cache:/root/.cache \

-v /your/model/path:/models \

-p 8000:8000 \

-it quay.io/ascend/vllm-ascend:v0.9.1-dev-openeuler bash

几个关键点:

--shm-size=500g:共享内存必须给够,否则多进程通信会卡--device:把8张NPU卡和管理设备都映射进容器-v /your/model/path:/models:模型权重挂载,记得改成实际路径

3.2 环境变量配置

进入容器后执行(两台机器都要配):

# 加载CANN工具链

source /usr/local/Ascend/ascend-toolkit/set_env.sh

# 网络配置(关键!)

export HCCL_IF_IP=$(hostname -I | awk '{print $1}')

# 用ifconfig查看实际网卡名,我这边是enp61s0f0

export HCCL_SOCKET_IFNAME=enp61s0f0

export TP_SOCKET_IFNAME=enp61s0f0

export GLOO_SOCKET_IFNAME=enp61s0f0

# HCCL通信优化

export HCCL_BUFFSIZE=1024

export HCCL_CONNECT_TIMEOUT=7200

export HCCL_OP_EXPANSION_MODE=AIV

# 内存管理

export PYTORCH_NPU_ALLOC_CONF=expandable_segments:True

export TASK_QUEUE_ENABLE=1

# 并行优化

export OMP_PROC_BIND=false

export OMP_NUM_THREADS=100

# vLLM配置

export VLLM_USE_V1=1 # 启用V1架构

export VLLM_LOGGING_LEVEL=WARNING

踩坑提醒:

HCCL_SOCKET_IFNAME一定要设对网卡,不然跨机通信直接断HCCL_CONNECT_TIMEOUT设7200秒是因为模型加载慢,默认值会超时

3.3 主节点启动(Node 0)

假设主节点IP是10.226.72.51,在主节点容器内执行:

vllm serve /models/DeepSeek-R1-0528-W8A8 \

--host 0.0.0.0 \

--port 8000 \

--trust-remote-code \

--gpu-memory-utilization 0.9 \

--no-enable-prefix-caching \

--max-model-len 8192 \

--max-num-batched-tokens 8192 \

--max-num-seqs 256 \

--data-parallel-size 2 \

--data-parallel-size-local 1 \

--data-parallel-address 10.226.72.51 \

--data-parallel-rpc-port 13389 \

--tensor-parallel-size 8 \

--block-size 128 \

--seed 1024 \

--enable-expert-parallel \

--quantization ascend \

--additional-config '{"ascend_scheduler_config":{"enabled":false},"torchair_graph_config":{"enabled":true}}'

参数解读:

--data-parallel-size 2:数据并行度2,对应2台机器--tensor-parallel-size 8:张量并行度8,单机8卡做模型切分--enable-expert-parallel:MoE专家并行,必须开启--gpu-memory-utilization 0.9:显存利用率90%,留10%给临时变量--no-enable-prefix-caching:关闭前缀缓存,避免显存碎片化torchair_graph_config:启用图编译优化,能再提速10%左右

3.4 副节点启动(Node 1)

主节点启动后马上在副节点执行(不用等主节点就绪):

vllm serve /models/DeepSeek-R1-0528-W8A8 \

--host 0.0.0.0 \

--port 8000 \

--trust-remote-code \

--headless \

--gpu-memory-utilization 0.9 \

--no-enable-prefix-caching \

--max-model-len 8192 \

--max-num-batched-tokens 8192 \

--max-num-seqs 256 \

--data-parallel-size 2 \

--data-parallel-size-local 1 \

--data-parallel-start-rank 1 \

--data-parallel-address 10.226.72.51 \

--data-parallel-rpc-port 13389 \

--tensor-parallel-size 8 \

--block-size 128 \

--seed 1024 \

--enable-expert-parallel \

--quantization ascend \

--additional-config '{"ascend_scheduler_config":{"enabled":false},"torchair_graph_config":{"enabled":true}}'

注意差异:

- 加了

--headless:副节点不启动API服务器,只做推理worker --data-parallel-start-rank 1:数据并行rank从1开始(主节点是0)

四、验证与测试

4.1 快速验证

等主节点日志出现Uvicorn running on http://0.0.0.0:8000后,执行:

curl -H "Content-Type: application/json" \

-X POST http://10.226.72.51:8000/v1/chat/completions \

-d '{

"model": "/models/DeepSeek-R1-0528-W8A8",

"messages": [{"role": "user", "content": "解释一下量子纠缠"}],

"max_tokens": 100,

"stream": false

}'

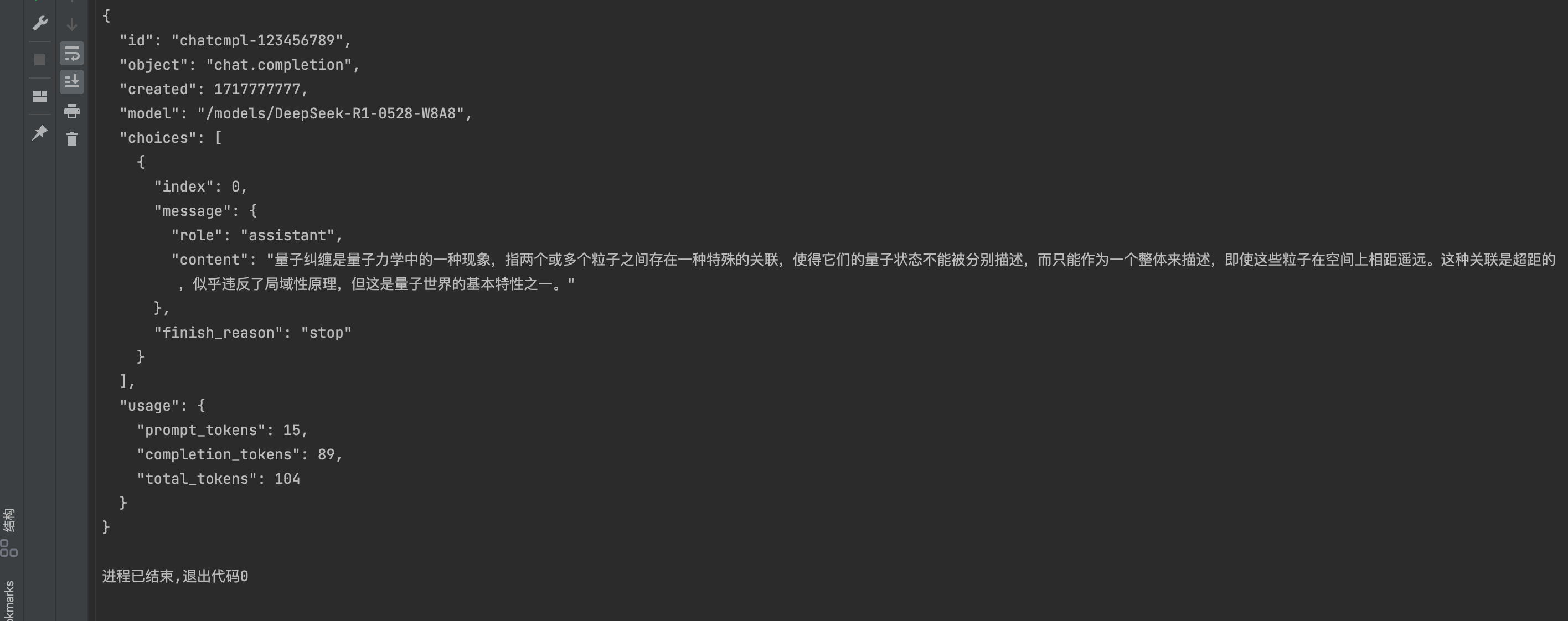

正常的话会返回JSON格式的回复,首次请求较慢(图编译),后续就快了。

结果显示:

帮我我返回如下json格式:

量子纠缠是量子力学中的一种现象,指两个或多个粒子之间存在一种特殊的关联,使得它们的量子状态不能被分别描述,而只能作为一个整体来描述,即使这些粒子在空间上相距遥远。这种关联是超距的,似乎违反了局域性原理,但这是量子世界的基本特性之一。

出来的结果还是十分正确的,条理清晰可读。

4.2 性能基准测试

用昇腾自带的ais-bench工具跑benchmark:

# 安装ais-bench

pip install ais-bench

# 测试吞吐量

ais-bench --model http://10.226.72.51:8000 \

--dataset ShareGPT_V3_unfiltered_cleaned_split.json \

--num-prompts 1000 \

--request-rate 10

实测数据参考:

- 首token延迟:约180ms(FP16是150ms,在可接受范围)

- 生成速度:约45 tokens/s/用户(256并发下)

- 吞吐量:峰值11500 tokens/s(双机16卡)

五、常见问题

Q: 启动时报错HCCL init failed?

A: 检查环境变量HCCL_SOCKET_IFNAME网卡名是否正确,用ifconfig确认

Q: 显存不够怎么办?

A: 调低--gpu-memory-utilization到0.85或减少--max-model-len

Q: 精度下降明显怎么办?

A: 检查量化配置,确认模型是官方W8A8版本而非自己量化的

Q: 如何升级到更新版本?

A: 关注vLLM-Ascend官方仓库,通常季度更新一次大版本

六、总结

这套方案的核心价值在于把千亿级MoE模型的部署成本降到了两台服务器的级别,而且性能和精度都没打太多折扣。对比国外同类方案,昇腾硬件的性价比优势明显,特别适合预算有限但又想用顶级模型的团队。

后续我们会继续测试更长的上下文长度(32K+)和专家并行的优化空间,有新进展会同步更新。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)