边缘AI算力临界点:深度解析176TOPS香橙派AI Station的产业价值

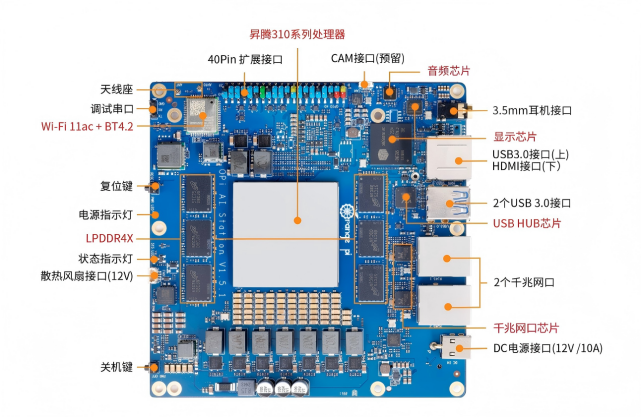

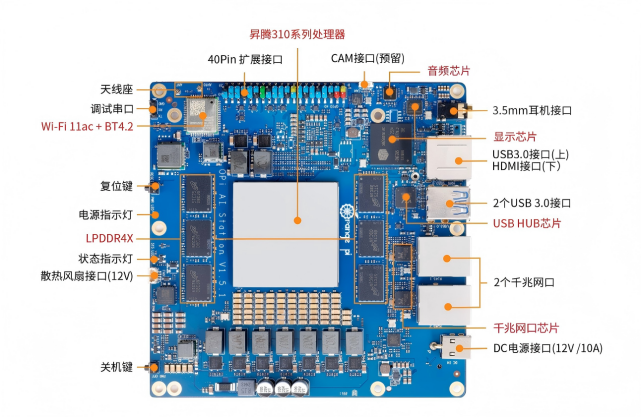

《边缘AI算力临界点:176TOPS香橙派AIStation的产业价值解析》摘要 文章聚焦边缘AI算力新标杆OrangePi AIStation的技术突破与产业价值。该设备搭载昇腾310P芯片,具备176TOPS(INT8)异构算力、48/96GB LPDDR4X内存及专业级工业接口,突破了边缘设备运行7B-13B参数大模型的内存瓶颈。通过PCIE4.0×4、双千兆网口和40Pin扩展接口等设计,

在过去几年中,人工智能的基础设施部署重心正经历一场深刻的转移。如果说2020年的关键词是“大模型训练”,2023年的关键词是“推理下沉”,那么2025-2026年的关键词无疑是 “边缘原生” 。

随着DeepSeek、LLaMA等开源模型的轻量化演进,以及具身智能、工业质检对实时性的严苛要求,AI计算正在从云数据中心扩散到离数据源头最近的物理世界。在这一背景下,AI Mini Server(迷你AI服务器) 这一形态应运而生。它需要在极小体积内,提供接近服务器级的AI吞吐能力,同时具备工业级的接口扩展性。

OrangePi AI Station 正是这一产业浪潮中的典型代表。本文将基于昇腾310P芯片的底层架构,深度剖析这款产品的技术细节、算力门槛及其在实际产业落地中的真实价值。

一、176TOPS的产业门槛:为何这是边缘算力的新起点?

AI硬件的核心指标始终是算力,但不同层级的算力决定了设备在产业分工中的身位。OrangePi AI Station采用的昇腾310P处理器,构建了一套完整的异构计算体系:

1、16核CPU (ARM架构,主频1.9GHz):负责复杂逻辑调度与操作系统运行。

2、10个AI Core (达芬奇架构,1.08GHz):专为高密度的矩阵运算设计,承担神经网络推理。

3、8个Vector Core (1GHz):辅助进行数据预处理和向量检索。

这一组合带来了高达176TOPS的整型AI算力(INT8)。在AI硬件行业中,算力决定了应用的天花板:

|

算力区间 |

典型应用场景 |

设备形态 |

|

10-40 TOPS |

单路视觉识别、轻量级语音控制 |

物联网摄像头、智能音箱 |

|

40-80 TOPS |

多路视频结构化、ADAS辅助驾驶 |

边缘NVR、Jetson Orin NX |

|

80-150TOPS |

复杂场景理解、实时多路视频分析 |

高端边缘盒子、Jetson AGX Orin |

|

150 TOPS+ |

本地大模型推理、具身智能控制、多模态实时交互 |

迷你AI服务器 |

176TOPS 意味着OrangePi AI Station正式迈入 高端边缘AI计算平台门槛。它不仅能处理单纯的视觉任务,更具备了运行实时多模态应用的能力。例如,在智慧工厂场景中,它可以同时运行:1路工业缺陷检测(高分辨率)、4路安防监控(行为识别)以及1套基于RAG的本地知识库问答系统。

二、内存革命:48GB/96GB LPDDR4X 背后的带宽博弈

很多开发者容易陷入唯算力论的误区,但在实际部署大模型时,内存容量和带宽往往是真正的性能瓶颈。OrangePi AI Station提供了48GB / 96GB LPDDR4X的选项,速率高达4266MHz。这一配置在同尺寸设备中不多见,其产业价值体现在三个层面:

1. 大模型的“内存墙”突破

运行一个70亿参数(7B)的模型(如DeepSeek-7B/LLaMA2-7B),仅模型权重加载就需要约14GB内存(FP16)。如果加上KV Cache、中间激活层和系统开销,流畅运行通常需要24GB-32GB内存。48GB版本可以完美覆盖7B-13B参数级别的模型,而96GB版本甚至可以为本地部署更高精度的模型或同时加载多个模型提供充裕空间。

2. 被忽视的带宽(4266MHz)

LPDDR4X 4266MHz提供了约68.1GB/s的理论带宽(基于64-bit总线估算,实际受SoC限制可能略有差异)。虽然相比HBM(高带宽内存)有差距,但在边缘设备中,这一带宽足以支撑流式多模态输入。例如,在实时视频分析中,高带宽可以确保视频帧数据不被阻塞,快速喂给NPU,实现真正的实时而非准实时分析。

3. 向量数据库的本地化

RAG是目前大模型落地的核心技术。AI Station的大内存允许在内存中建立较大规模的向量索引,避免频繁查盘,这对于构建私有知识库问答系统至关重要。

三、接口的深度解析:不止是“有”,更是“专业”

相比于普通PC,开发者更关注接口背后的协议与潜力。OrangePi AI Station的接口配置展现了其面向工业嵌入式和专业开发者的野心。

1、M.2 插槽 (PCIE4.0 X4):这不仅是插硬盘的。PCIE4.0 X4提供了高达8GB/s的带宽(单向)。这意味着它不仅支持NVMe SSD(如1TB/2TB选项)实现快速读写,未来还可以通过转接卡扩展更高的带宽外设,如高速采集卡或另一块NPU模块。

2、双千兆网口:在工业场景中,双网口通常用于数据隔离。例如,一个网口连接工业相机或PLC(可编程逻辑控制器)内网,另一个网口连接上层管理系统或云端,实现物理级别的网络冗余和安全隔离。

3、40Pin扩展接口:这是开发板的灵魂。AI Station完整引出了 I2C, SPI, PWM, UART, GPIO。这意味着开发者可以直接驱动伺服电机(通过PWM)、连接激光雷达(通过UART/SPI)、读取各类传感器数据。这使得AI Station不仅是一台电脑,更是一个机器人主控板。它可以在内部直接运行ROS/ROS2系统,通过40Pin接口与底盘电机、机械臂关节驱动器和各类IMU(惯性测量单元)传感器进行低延迟通信。

4、USB3.0(限流1A):细节见真章。明确标注“限流1A”意味着该接口在设计时考虑到了对外接设备(如移动硬盘、散热风扇、USB摄像头)的供电稳定性,这是工业设计的严谨体现。

5、调试串口(3Pin排针):对于底层系统开发者和BSP工程师来说,板载调试串口是救命稻草。当系统无法正常启动时,这是唯一的交互窗口。

四、软件生态与实测:从“能用”到“好用”

硬件只是躯壳,软件才是灵魂。AI Station选择了openEuler 22.03作为首发出厂系统。openEuler作为华为主导的服务器操作系统,在ARM生态、内核优化和实时性方面有深厚积累,这对于将AI Station作为服务器或工业控制器使用至关重要。

真实的开发者案例:ACT模型部署(具身智能)

根据昇腾社区开发者分享的实战经验,OrangePi AI Station已被用于部署具身智能领域的ACT (Action Chunking with Transformers) 模型。在这一案例中,开发者利用AI Station的176TOPS算力,在机器人平台上运行模仿学习策略,控制机械臂完成精细操作。

实测数据如下:

平台:OrangePi AI Station (Ascend 310P RC模式)

推理耗时:约200ms(端到端,包含图像渲染和模型推理)

对比:在同等精度下,该耗时虽与NVIDIA Orin开启TensorRT后的80ms仍有差距,但考虑到AI Station的体积和功耗,以及这是早期的社区移植版本,其潜力巨大。开发者指出,纯模型推理在EP环境下仅需10ms,表明当前200ms的瓶颈在于数据预处理和流水线优化,而非NPU本身算力不足。

这一案例极具价值,它证明了AI Station在资源受限的机器人平台上,有能力处理Transformer架构的复杂模型,为双臂机器人、移动抓取等复杂任务提供了除Jetson之外的国产算力选择。

五、产业定位与横向对比

在当前的AI硬件版图中,OrangePi AI Station的定位非常清晰:填补了“AI PC”与“工业边缘站”之间的空白。

|

平台 |

AI算力 |

内存 |

接口扩展性 |

核心定位 |

|

NVIDIA Jetson Orin NX |

100 TOPS |

8-16GB LPDDR5 |

中等 (GPIO, CSI) |

自主机器视觉 |

|

NVIDIA Jetson AGX Orin |

200-275 TOPS |

32-64GB LPDDR5 |

强 (PCIE, 万兆网) |

高阶机器人、工业AI |

|

Intel Core Ultra (AI PC) |

~120 TOPS (NPU+GPU) |

16-32GB LPDDR5/X |

丰富 (PCIe,雷电) |

AI办公、端侧创作 |

|

OrangePi AI Station |

176 TOPS |

48/96GB LPDDR4X |

极强(PCIE4.0+40Pin+双网口) |

AI Mini Server / 具身智能主控 |

从上表可以看出,AI Station的独特性在于:它拥有接近AGX Orin的算力,但内存容量远超同级别产品;它拥有PC级的存储扩展,又保留了嵌入式开发所需的底层引脚。这种 “跨界” 属性使其在智慧交通、工业自动化、具身智能等需要兼顾算法复杂度和硬件耦合度的场景中,具备了独特的竞争优势。

六、结语:边缘AI的新形态

OrangePi AI Station的出现,标志着边缘AI算力不再仅仅是“云端的缩水版”,而是具备独立生命周期的 “边缘原生”节点。它不仅能在本地完成推理,还能通过丰富的接口控制物理世界,通过大内存加载复杂的决策模型。

随着DeepSeek等开源模型的推理成本进一步降低,像AI Station这样的设备将成为构建未来具身智能、全息工厂和智慧城市末梢的核心算力单元。对于开发者而言,这不仅是一块开发板,更是一把打开物理世界与数字智能大门的钥匙。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)