GLM-Image 上线 AtomGit,国产芯片训练的多模态开源模型开放使用

混合设计,融合 9B 规模自回归模型与 7B 大小的 DiT 扩散解码器,前者负责指令理解与全局构图,后者搭配 Glyph Encoder 文本编码器,提升图像细节与文字生成的准确性,有效改善传统模型文字错漏问题。的 SOTA 多模态产品,依托昇腾硬件与昇思框架构建,在文字生成、多场景适配等方面表现突出,为开发者提供了可靠的开源技术方案。,生成文字与目标内容的一致性较高;在生成电商图、漫画等多格图

2026 年 1 月 4 日,智谱联合华为研发的多模态模型 GLM-Image 正式上线 AtomGit 开源平台。该模型是首个基于国产芯片完成全流程训练的 SOTA 多模态产品,依托昇腾硬件与昇思框架构建,在文字生成、多场景适配等方面表现突出,为开发者提供了可靠的开源技术方案。

👉 模型仓库:https://ai.gitcode.com/zai-org/GLM-Image

👉 代码仓库:https://atomgit.com/zai-org/GLM-Image-code

模型核心特性:架构创新与国产化适配

🪧 GLM-Image 技术报告:https://z.ai/blog/glm-image

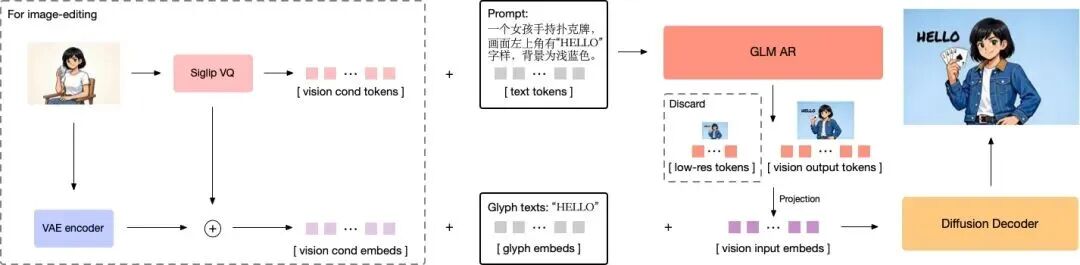

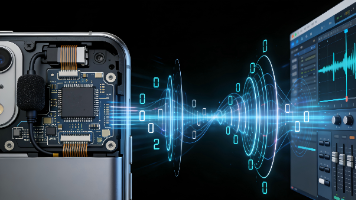

GLM-Image 的核心优势集中在技术架构与训练部署的双重突破。架构层面,采用 “自回归 + 扩散解码器” 混合设计,融合 9B 规模自回归模型与 7B 大小的 DiT 扩散解码器,前者负责指令理解与全局构图,后者搭配 Glyph Encoder 文本编码器,提升图像细节与文字生成的准确性,有效改善传统模型文字错漏问题。

训练部署方面,模型从数据预处理到大规模预训练,全流程基于昇腾 Atlas 800T A2 设备与昇思 MindSpore AI 框架完成,验证了国产全栈算力底座支持前沿多模态模型训练的可行性。同时,通过改进 Tokenizer 策略,模型可自适应 1024×1024 至 2048×2048 尺寸的任意比例图像生成,无需额外训练,适配更多使用场景。

通用 pipeline

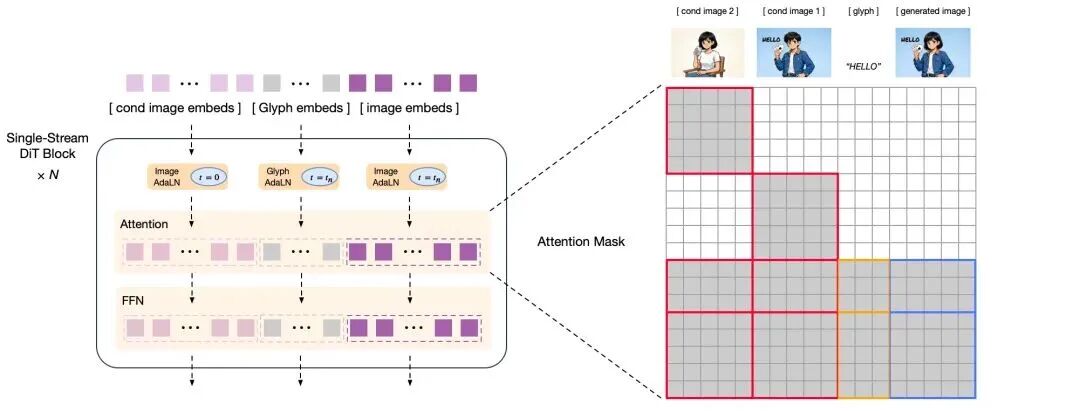

解码器结构示意图

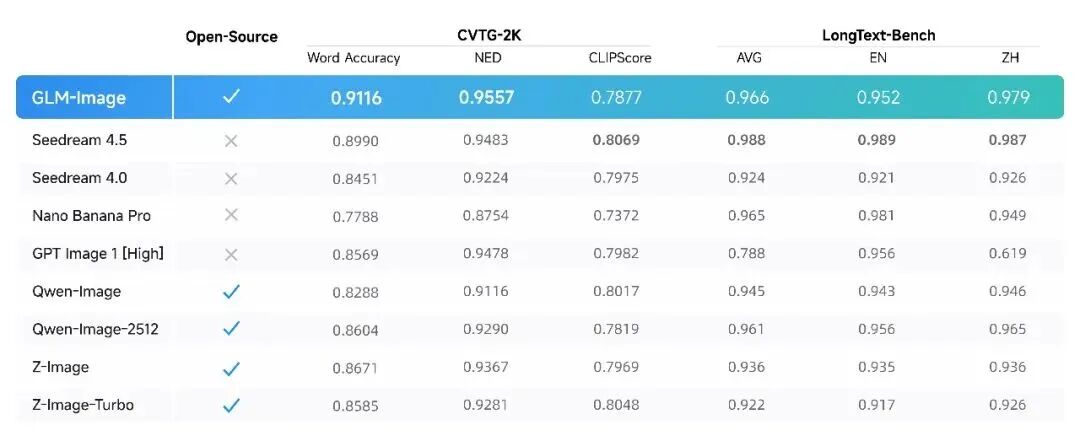

权威榜单认证:文字生成能力达开源领先水平

在专业测评中,GLM-Image 的文字生成表现处于开源模型前列。CVTG-2K(复杂视觉文字生成)榜单中,其文字准确率达 0.9116,归一化编辑距离为 0.9557,生成文字与目标内容的一致性较高;LongText-Bench(长文本渲染)榜单覆盖 8 类文字密集场景,其中中文生成准确率 0.979、英文 0.952,在开源模型中排名第一,适用于海报、PPT、科普图等场景的文字呈现需求。

GLM-Image 实测案例参考

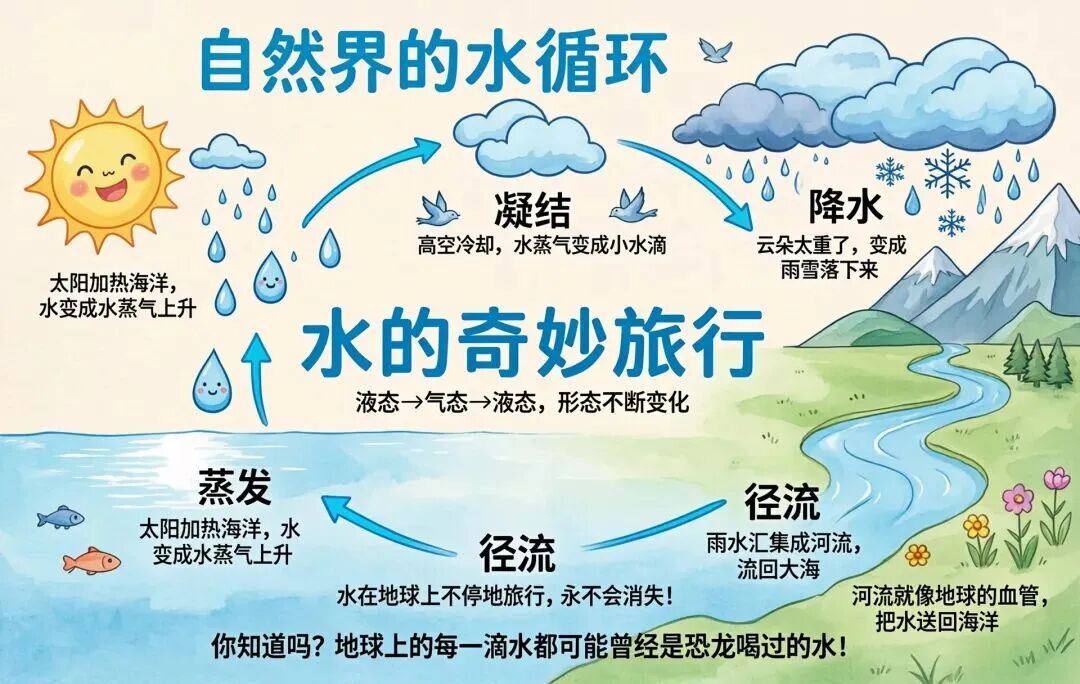

1|场景一:科普插画

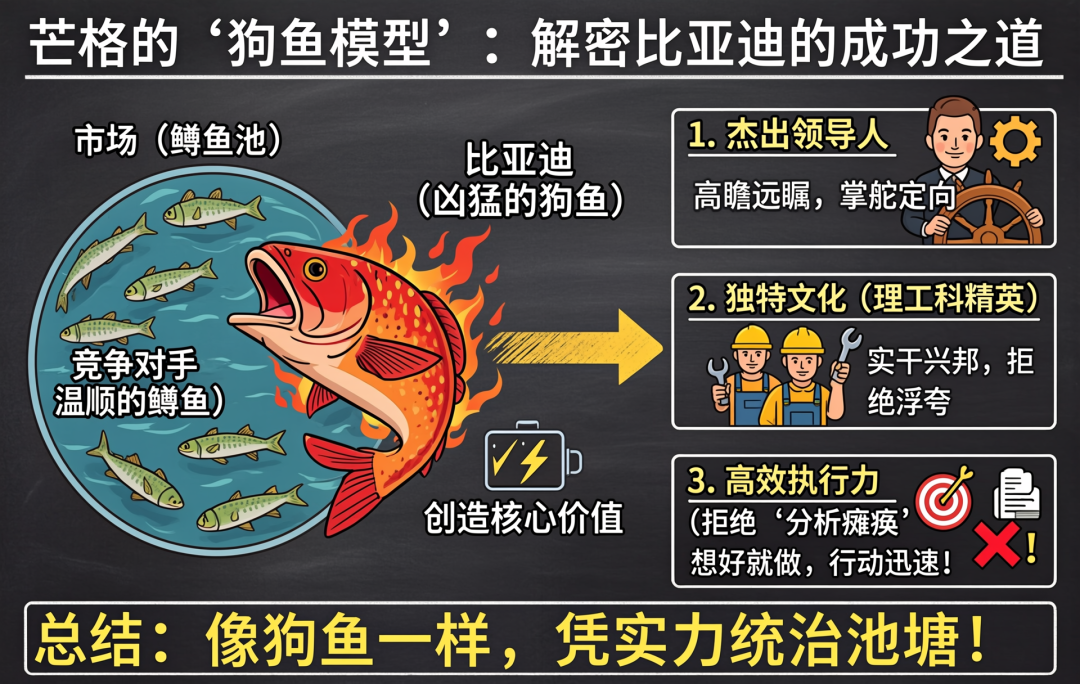

GLM-Image 更擅长绘制包含复杂逻辑流程与文字说明的科普插画及原理示意图。

2|场景二:多格图画

在生成电商图、漫画等多格图画时,GLM-Image能够保持风格和主体的一致性,并保障多处文字生成的准确率。

3|场景三:社交媒体图文封面

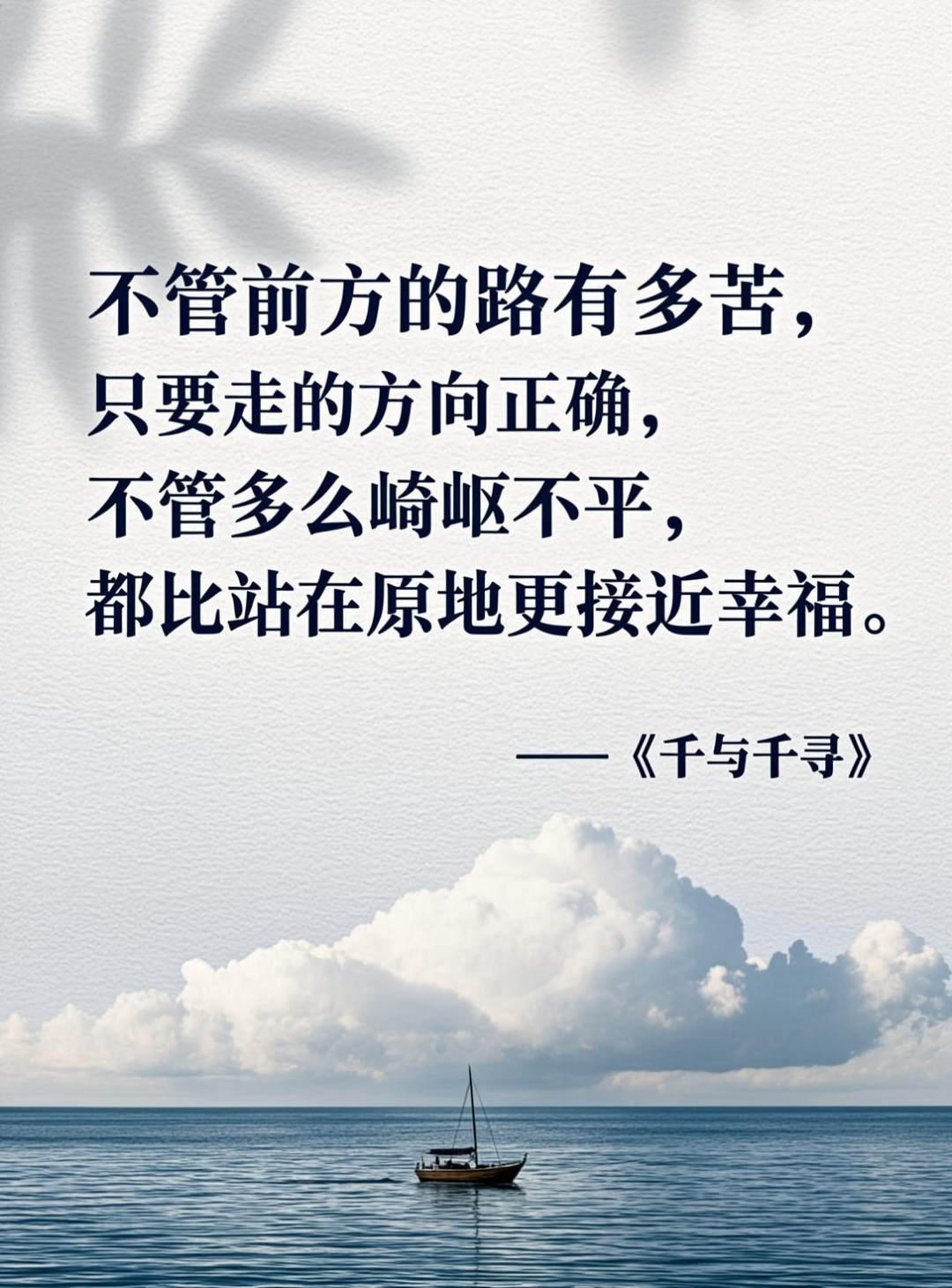

GLM-Image 适用于制作社交媒体封面及内容等排版复杂的图片,让您的创作更自由丰富。

4|场景四:商业海报

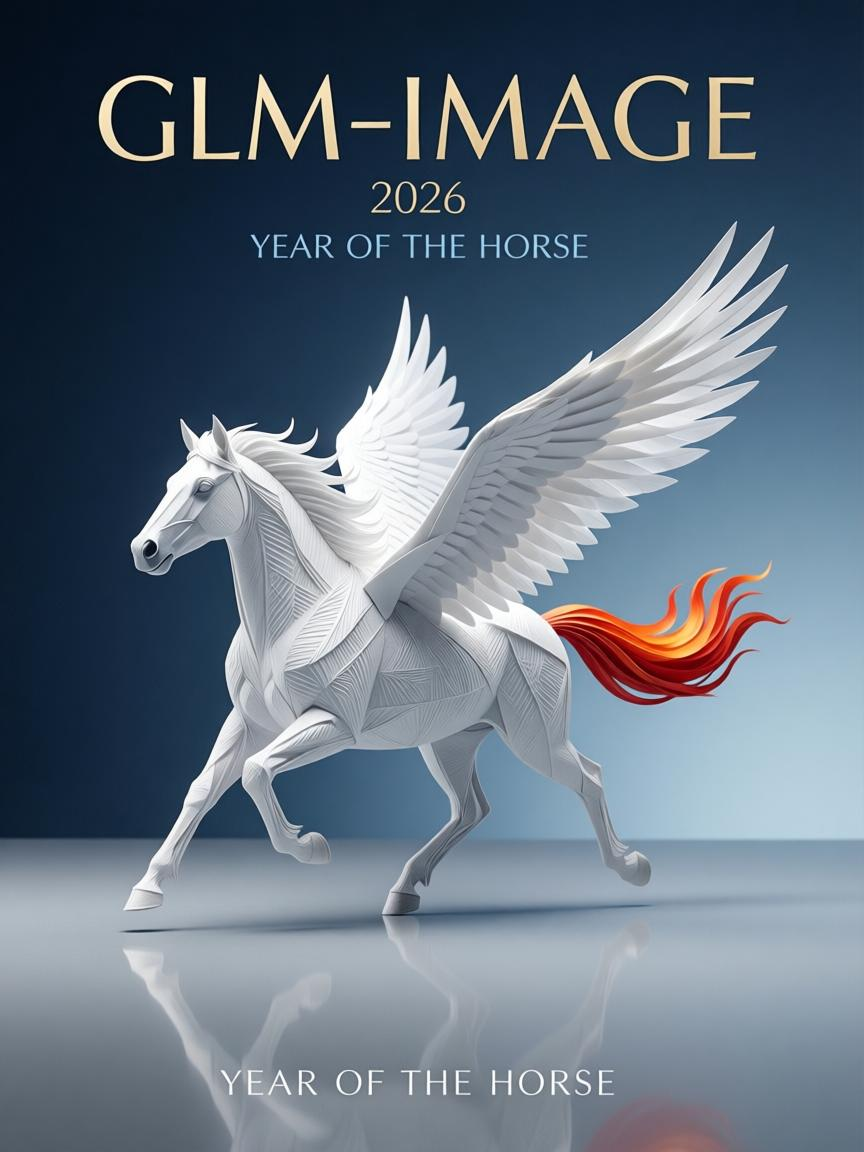

GLM-Image 能够生成构图富有设计感、文字嵌入准确的节日海报与商业宣传图。

5|场景五:写实摄影

在文字渲染以外,GLM-Image也同样擅长生成各种景别和尺寸的人像、宠物、风景、静物。

AtomGit 平台获取与使用指南

👉 模型仓库:https://ai.gitcode.com/zai-org/GLM-Image

👉 代码仓库:https://atomgit.com/zai-org/GLM-Image-code

目前,GLM-Image 的完整开源资源已同步至 AtomGit,开发者可通过以下方式快速上手:

-

项目获取:进入 “GLM-Image”代码仓库,即可克隆源码、查看技术文档,文档包含架构解析、部署步骤等详细内容,助力快速搭建运行环境;

-

应用参考:平台收录科普插画、多格电商图、社交媒体封面、商业海报、写实摄影等 5 类实测案例,提供 Prompt 设计与参数配置参考,降低场景化应用门槛;

-

社区交流:开发者在讨论区可分享使用经验、反馈问题,与技术团队及同行共同优化模型效果。

此外,该模型 API 调用模式下生成单张图片仅需 0.1 元,后续将推出速度优化版本,兼顾成本与效率,适用于个人开发实践与企业级项目落地。

开源意义:推动国产 AI 生态协同发展

GLM-Image 的开源不仅分享了 “认知型生成” 技术路径,更为国产算力与 AI 模型的协同优化提供了实践参考。作为首个国产芯片全流程训练的 SOTA 多模态模型,其在 AtomGit 的上线,为开发者提供了低成本接入前沿技术的渠道,也为国产开源 AI 生态的完善注入新动力。

如需获取模型源码及相关资源,可访问 AtomGit 项目页面。欢迎开发者参与项目交流与二次开发,共同探索多模态生成技术的应用边界。

👉 立即访问 AtomGit 获取 GLM-Image:

更多推荐

已为社区贡献16条内容

已为社区贡献16条内容

所有评论(0)