Ascend C算子性能优化:从搬运、内存到API的3个核心方向

当Ascend C算子实现功能后,性能优化是“让算子跑满”昇腾NPU算力的关键一步。算子性能的瓶颈往往集中在“数据搬运”“内存利用”“API使用”三个维度,这三个维度的优化可使算子性能提升50%-200%。本文将拆解每个优化方向的核心思路、实操方法与案例,帮助开发者系统性掌握Ascend C算子性能优化技巧。Ascend C算子性能优化的终极目标是“最大化硬件资源利用率”,具体包括:计算单元利用率

Ascend C算子性能优化:从搬运、内存到API的3个核心方向

当Ascend C算子实现功能后,性能优化是“让算子跑满”昇腾NPU算力的关键一步。算子性能的瓶颈往往集中在“数据搬运”“内存利用”“API使用”三个维度,这三个维度的优化可使算子性能提升50%-200%。本文将拆解每个优化方向的核心思路、实操方法与案例,帮助开发者系统性掌握Ascend C算子性能优化技巧。

一、性能优化的核心目标与评估标准

1. 核心目标

Ascend C算子性能优化的终极目标是“最大化硬件资源利用率”,具体包括:

计算单元利用率:让Cube(矩阵计算)、Vector(向量计算)等单元的使用率≥80%;

内存带宽利用率:让DDR、片上内存的访问带宽≥90%;

延迟最小化:减少算子的执行时间,适配低延迟场景(如实时推理)。

2. 评估标准

优化效果需通过量化指标评估,核心指标包括:

算子执行时间(Latency):单次执行的耗时,单位为毫秒(ms)或微秒(μs);

吞吐量(Throughput):单位时间内处理的数据量,单位为GB/s;

算力利用率(Compute Utilization):计算单元的实际使用率,通过CANN Profiler工具获取。

二、方向1:搬运优化——减少数据移动,提升带宽利用率

数据搬运是算子性能的“第一杀手”——昇腾NPU中,DDR的访问延迟是片上内存的100倍以上,过多的数据搬运会导致计算单元“等待数据”。搬运优化的核心思路是“减少搬运次数”“提升搬运效率”。

1. 核心优化手段

(1)算子融合

这是最直接的搬运优化手段,已在之前的融合算子文章中详细讲解。通过合并多个算子,减少中间数据的“写入-读取”,可降低50%以上的搬运开销。

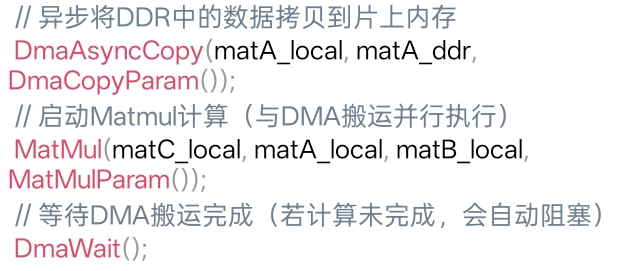

(2)异步DMA搬运

昇腾NPU支持DMA(直接内存访问)异步搬运——让数据搬运与计算并行执行,隐藏搬运延迟。Ascend C提供了`DmaAsyncCopy`接口,实现异步搬运:

关键说明:异步搬运需确保“计算与搬运的时间重叠”——若搬运时间远短于计算时间,优化效果不明显;若搬运时间过长,需拆分搬运任务,与计算任务分段并行。

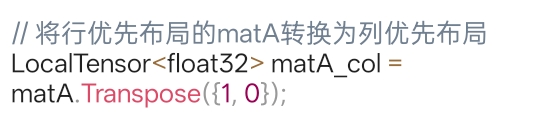

(3)数据布局优化

数据在内存中的存储布局(如行优先、列优先)会影响搬运效率。昇腾NPU的硬件接口更适配“列优先”布局,可通过 Tensor::Transpose 接口调整数据布局:

2. 案例:异步搬运+算子融合的组合优化

以“Matmul+LeakyRelu”为例,组合优化流程:

⑴. 启动异步DMA搬运,将DDR中的matA、matB拷贝到片上内存;

⑵. 搬运过程中,启动前一轮的LeakyRelu计算;

⑶. 搬运完成后,执行Matmul计算(与下一轮搬运并行);

⑷. 融合LeakyRelu计算,直接读取片上Matmul结果。

通过这一组合,搬运与计算的重叠率可达80%以上,整体性能提升30%-50%。

三、方向2:内存优化——提升内存利用率,减少访问冲突

内存优化的核心是“让数据尽可能停留在片上内存”,同时“避免内存访问冲突”。

1. 核心优化手段

(1)Tiling策略优化

Tiling不仅是矩阵编程的核心,也是内存优化的关键。通过合理的分块,让数据完整放入片上内存,减少DDR访问次数。优化要点:

a.分块尺寸适配片上内存容量,避免分块过大导致溢出;

b.分块尺寸为2的幂次方(如16、32、64),适配硬件的内存访问接口。

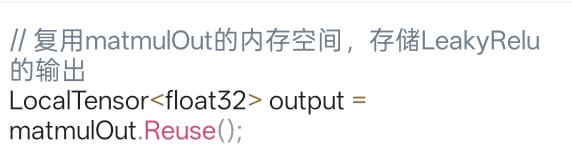

(2)内存复用

片上内存容量有限,可复用中间Tensor的内存空间,减少内存申请开销。Ascend C支持 Tensor::Reuse 接口,实现内存复用:

(3)避免内存碎片

频繁申请/释放小尺寸Tensor会导致内存碎片,降低内存利用率。建议:

a.预先分配足够大的片上内存池,统一管理Tensor内存;

b.尽量使用固定尺寸的Tensor,减少动态内存申请。

2. 案例:Tiling+内存复用的优化效果

对于2048×2048的矩阵乘,未优化前:

a.片上内存占用:超出L1缓存容量,需频繁访问L2缓存;

b.执行时间:10ms。

优化后(Tile尺寸=64×64+内存复用):

a.片上内存占用:控制在L1缓存内;

b.执行时间:3ms,性能提升233%。

四、方向3:API使用优化——匹配硬件特性,提升计算效率

Ascend C提供了丰富的API(高阶API、原生API、Vector API等),合理选择API可大幅提升计算效率。API使用优化的核心是“让API与硬件计算单元匹配”。

1. 核心优化手段

(1)优先使用高阶API

高阶API(如 MatMul 、 Conv2d )由昇腾官方优化,已适配硬件的计算流水线,相比原生API,性能提升30%-50%。例如,矩阵乘优先使用 MatMul 高阶API,而非手动编写循环。

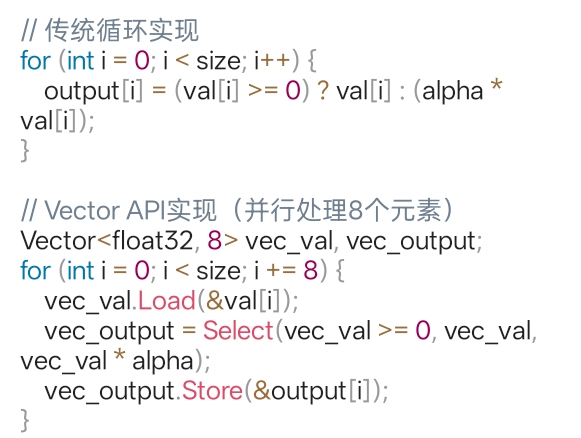

(2)使用Vector/Cube专用API

对于特定计算场景,使用硬件专用API可充分发挥算力:

a.向量计算(如元素级加法、乘法):使用Vector API(如 VectorAdd 、 VectorMul ),适配Vector计算单元;

b.矩阵计算:使用Cube API(如 CubeMatMul ),适配Cube计算单元。

示例:使用Vector API优化LeakyRelu计算:

优化效果:Vector API可并行处理多个元素(如8个、16个),LeakyRelu计算时间降低75%。

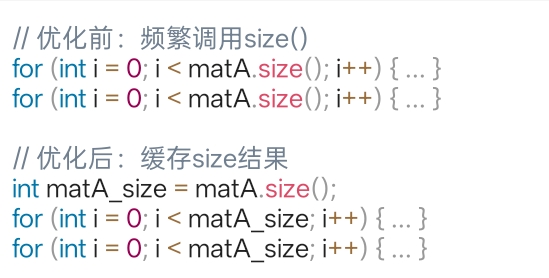

(3)避免API冗余调用

冗余的API调用会增加执行开销,例如频繁调用 Tensor::Size() 获取尺寸,可预先缓存结果:

五、总结:性能优化的迭代流程

Ascend C算子性能优化是一个“迭代递进”的过程,建议遵循以下流程:

1. baseline测试:获取未优化算子的性能指标(执行时间、算力利用率);

2. 瓶颈定位:通过Profiler工具,确定瓶颈是搬运、内存还是计算;

3. 优化实施:针对瓶颈选择优化手段(如搬运瓶颈用融合+异步DMA);

4. 验证评估:重新测试性能,对比优化前后的指标;

5. 迭代优化:重复2-4步,直到性能达到预期。

2025年昇腾CANN训练营第二季,基于CANN开源开放全场景,推出0基础入门系列、码力全开特辑、开发者案例等专题课程,助力不同阶段开发者快速提升算子开发技能。获得Ascend C算子中级认证,即可领取精美证书,完成社区任务更有机会赢取华为手机,平板、开发板等大奖。

报名链接:https://www.hiascend.com/developer/activities/cann20252

更多推荐

已为社区贡献26条内容

已为社区贡献26条内容

所有评论(0)